Neu aufgelegt: „Von einem Jugendstraftäter, der mit dem besten Klimaexperten der Welt verwechselt wurde – Ein IPCC-Exposé“,

Die kanadische Journalistin und Bloggerin Donna Laframboise hat vor einigen Jahren die Korruption im IPCC – dem sogenannten „Weltklimarat“ – akribisch analysiert („Von einem Jugendstraftäter, der mit dem besten Klimaexperten der Welt verwechselt wurde – Ein IPCC-Exposé“, ISBN 978-3-940431-33-2, 220 S., 19,90 EUR (D)). Dieses Buch erschien 2012/13 als zweiter Band der EIKE-Schriftenreihe auf Deutsch und war lange vergriffen. Jetzt ist es aufgrund der hohen Nachfrage in einer überarbeiteten Version wieder erhältlich.

Denn das IPCC genießt noch immer ein viel zu großes Ansehen. Ständig heißt es, dessen Veröffentlichungen entsprächen höchsten wissenschaftlichen Standards. Von den IPCC-Autoren als den besten Fachleuten der Welt ist die Rede. Donna Laframboise hat gezeigt, dass das keineswegs der Fall ist. Deshalb verglich sie das Gremium mit einem unerziehbaren Jugendstraftäter. Einer der interessantesten Abschnitte des Buches ist die akribische Untersuchung aller 18.531 Quellen des 4. IPCC-Sachstandsberichts durch die Autorin und ihr Team. Im folgenden veröffentlichen wir exklusiv einige Abschnitte des Buches, das übrigens direkt über den Link auf der rechten Seite dieser Webseite (und überall im Buchhandel) bestellt werden kann.

(Kapitel 3) Weltklassewissenschaftler und Spitzenfachleute?

Die Autoren der IPCC-Berichte sind die Crème de la Crème. Jeder sagt das. Auch Rajendra Pachauri, IPCC-Vorsitzender seit 2002. 2007 erklärte er gegenüber einer Zeitung, wie seine Organisation die Menschen auswählt, die an der Klimabibel mitschreiben: „Das sind Menschen, die aufgrund ihrer wissenschaftlichen Laufbahn ausgewählt wurden, aufgrund ihrer Publikationsliste, aufgrund ihrer Forschungen. […] Das sind die Spitzen ihres Fachs.“[1]

Zwei Jahre später sagte er vor einem Ausschuss des US-Senats aus, dass „alle vernunftbegabten Menschen“ von den IPCC-Schluss-folgerungen überzeugt sein sollten, weil seine Organisation die „besten Talente aus der ganzen Welt“ mobilisiert.[2]

Ob er nun in Österreich oder in Australien ein Interview gibt oder über sich selbst spricht, Pachauri meint stets, er „kann sich keine bessere Kombination qualifizierter Menschen“ für das Verfassen der IPCC-Berichte vorstellen.[3] Bei diversen Gelegenheiten äußerte er, das IPCC bestehe aus:

- Tausenden der besten Wissenschaftler,[4]

- dem weltweit besten wissenschaftlichen Sachverstand,[5]

- fast viertausend der besten Spezialisten der Welt.[6]

Damit steht er nicht allein. Auch Robert Watson, fünf Jahre lang Pachauris Vorgänger im Amt, behauptete, das IPCC würde „Tausende von Spitzenfachleuten aus der ganzen Welt“ beschäftigen.[7] Die Medien haben es immer wieder nachgeplappert.

Solche Behauptungen sind dumme Sprüche. Denn eines gleich zu Beginn: Einige der weltweit erfahrensten Fachleute blieben außen vor. So erklärte William Gray, ein Atmosphärenwissenschaftler der Colorado State University, 2005 einem Ausschuss des US-Senats: „Trotz meiner 50-jährigen wissenschaftlichen Erfahrung mit Meteorologie und meiner langjährigen Befassung mit saisonalen Orkan- und Klimavorhersagen wurde ich nie um einen Beitrag zu einem der [IPCC-] Berichte gebeten.“ Warum wurde er nicht zur Party eingeladen? Als Grund gab er seine Überzeugung an, der Klimawandel würde keineswegs mehr (oder stärkere) Wirbelstürme verursachen: „Die kennen meine Ansichten und wollen sich nicht damit auseinandersetzen.“ [8]

Sechs Monate vor Grays Aussage hatte ein Experte von der anderen Seite des Atlantiks seine Bedenken vor einem Ausschuss des britischen Oberhauses geäußert.

Paul Reiter weiß wenig über Atmosphärenwissenschaft. Doch womit er sich auskennt, ist ein Fachgebiet, auf das er sich seit über 40 Jahren spezialisiert hat – von Moskitos übertragbare Krankheiten. Ihm zufolge sind die Autoren, die über diese Krankheiten in der Klimabibel geschrieben haben, keine Experten.

Obwohl ein großer Teil des Gesundheits-Kapitels der Ausgabe von 1995 der Malaria gewidmet war, machte Reiter deutlich, dass „keiner der Leitautoren jemals eine Forschungsarbeit zu diesem Thema veröffentlicht hatte!“ Nur jemand mit begrenztem Fachwissen hätte seiner Meinung nach eine solche „amateurhafte“ Arbeit abliefern können.

So behauptete die Klimabibel, dass die Moskitos, die Malaria übertragen, normalerweise nicht in Gebieten überleben, wo die Wintertemperaturen unter 16 °C fallen. Das, so Prof. Reiter, ist Unsinn. Heute verbinden wir Malaria mit den Tropen, doch sind Armut und das Fehlen medizinischer Versorgung wichtigere Faktoren. Hawaii, Aruba und Barbados sind allesamt tropische Gebiete, doch Malaria ist dort kein Problem. Andererseits sind im 19. Jahrhundert in Nordamerika, Europa und sogar Sibirien Tausende an Malaria gestorben.[9]

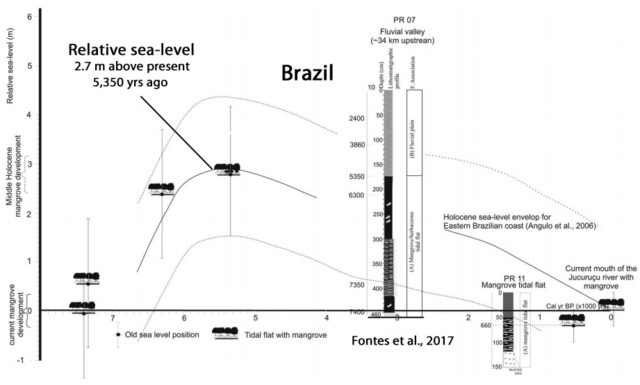

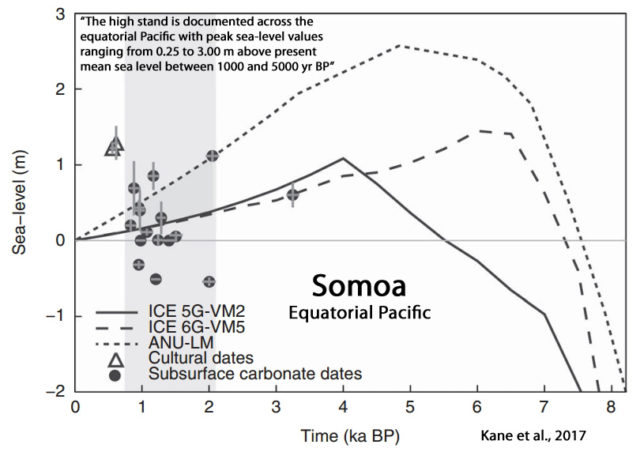

Das gleiche spielte sich bei den Meeresspiegelhöhen ab. Der ehemalige Vorsitzende der Kommission über die Veränderung des Meeresspiegels, Prof. Nils-Axel Mörner, sagte ebenfalls vor dem britischen Oberhaus aus. Mörner, der eine 40jährige Erfahrung auf diesem Fachgebiet vorweisen kann, wies auf die Unterschiede in den Auffassungen zwischen den Fachleuten zum Thema Meeresspiegel und den IPPC-Autoren hin. Letztere, sagte er, besäßen über keinerlei greifbare Erfahrung. Stattdessen versuchten sie, die Zukunft mit Hilfe von mathematischen Formeln und Computern vorherzusagen (Computer-Modellierung).

Mörner berichtete dem Oberhaus, dass zwischen 1999 und 2003 fünf internationale Tagungen von echten Meeresspiegel-Experten stattgefunden hätten, auf denen die verfügbaren weltweiten Belege diskutiert worden wären. Das Ergebnis war die Schlussfolgerung, dass der Meeresspiegel bis 2010 um kaum mehr als 10 Zentimeter steigen würde. Mörner meinte, die Behauptungen vom raschen Anstieg des Meeresspiegels und von der unmittelbaren Gefahr einer Überflutung ganzer Inselstaaten wären einfach unwahr.

Der Hurrikan-Experte Prof. Gray lebt in Amerika. Der Malaria-Experte Prof. Reiter wirkt am Pasteur-Institut in Paris. Bei Prof. Mörner handelt es sich um den ehemaligen Leiter des Fachbereichs Geodynamik an der Universität Stockholm.

Alle drei besitzen hoch spezialisiertes Wissen. Alle drei sind echte Fachleute mit langjähriger Erfahrung auf ihrem Fachgebiet. Sie sind mit anderen Worten genau die Sorte von Menschen, die man im Zentrum einer Organisation von Weltklasse-Wissenschaftlern, die sich mit einer der wichtigsten Fragen zur Zukunft unseres Planeten beschäftigt, erwarten würde.

Doch sie gehören nicht zum IPCC. Es liegt also nahe, dass das IPCC unter „Spitzenwissenschaftlern“ und „besten Fachleuten“ etwas anderes versteht als die meisten von uns.

(Kapitel 4) Wissenschaftler-Nachwuchs unter Dreißig

Wenn also Malaria-Experten nicht den Malaria-Teil und weltbekannte Meeresspiegel-Experten nicht den Meeresspiegelteil der Klimabibel schreiben, wer schreibt dann die IPCC-Berichte?

Eine Gruppe sind graduierte Studenten (Doktoranden und MA-Studenten), vom Lebensalter her typischerweise Mittzwanziger. Deren Welterfahrung ist weder breit noch tiefgehend. Wenn sie nur Verwaltungsaufgaben übernehmen würden, ginge das in Ordnung. Doch das IPCC verlässt sich seit langem auch auf ihr fachliches Urteilsvermögen.

Richard Klein, heute Professor für Geografie in den Niederlanden, ist ein gutes Beispiel. 1992 wurde Klein 23 Jahre alt, machte sein Diplom und tat sich als Greenpeace-Aktivist hervor. Zwei Jahre später, im zarten Alter von 25 Jahren, befand er sich bereits unter den IPCC-Leitautoren.

Was bedeutet das? Das IPCC kennt dreierlei Autoren: Koordinierende Leitautoren sind für ein ganzes Kapitel zuständig und stehen rangmäßig am höchsten. Für jedes Kapitel gibt es davon normalerweise zwei. Von den Leitautoren (ohne Attribut!) wird hingegen erwartet, dass sie große Teile des Textes schreiben. Deren Anzahl schwankt zwischen einer Handvoll und mehreren Dutzend. Beitragende Autoren stellen ihr Wissen ergänzend zur Verfügung. Sie nehmen normalerweise nicht an den Besprechungen der beiden anderen Autorenkategorien teil. Sie werden nur gebeten, kurze Beiträge zu einem eng gefassten spezifischen Thema zu liefern. Die einzelnen Kapitel hatten zwischen null und 20 Beitragende Autoren.

Kleins Online-Biografie können wir entnehmen, dass er seit 1994 bei sechs IPCC-Berichten Leitautor war. Dreimal seit 1997 war er Koordinierender Leitautor. Das bedeutet, dass Klein bereits mit 28 Jahren in die ranghöchste Autorenkategorie des IPCC befördert worden war, sechs Jahre vor der Erlangung seines Doktorgrades. Weder seine Jugend noch seine geringen akademischen Meriten hinderten das IPCC, ihn als einen Experten von Weltrang zu betrachten.[10]

Das ist keinesfalls ein Einzelfall. Laurens Bouwer arbeitet derzeit am Institut für Umweltstudien der Freien Universität Amsterdam. Von 1999 bis 2000 war er IPCC-Leitautor, noch bevor er 2001 seinen Master-Grad erwarb.

Wie kann ein junger Mann ohne Master beim IPCC Leitautor sein? Gute Frage, aber nicht die einzige. Bouwers fachliche Qualifikation liegt auf dem Gebiet des Klimawandels und der Wasservorräte. Doch das Kapitel, für das er als erstes als Leitautor tätig war, hatte den Titel „Versicherungen und andere Finanzdienstleistungen“.

Es stellt sich heraus, dass Bouwer 2000 für ein paar Monate Trainee bei der Münchener Rückversicherung war. Das bedeutet, dass das IPCC als Leitautor jemanden ausgewählte, der a) Trainee war, b) noch keinen Master hatte und c) noch ein ganzes Jahrzehnt von seiner Promotion (2010) entfernt war.

Wer fällt noch in diese Kategorie?

Da ist zum Beispiel Lisa Alexander. Noch 2008 war diese Frau Forschungsassistentin an der Monash-Universität in Australien. Nach ihrer Promotion 2009 erhielt sie an einer anderen australischen Universität eine Anstellung. Diese Universität erwähnte in der Ankündigung der Anstellung, dass sie bereits eine „Schlüsselrolle“ bei den Ausgaben der Klimabibel 2001 und 2007 gespielt hätte. (Sie war 2001 Beitragende Autorin und 2007 Leitautorin.)

Das IPCC wählte die 2001er Autoren bereits 1999 aus. Daraus ergibt sich, dass die IPCC-Führung auch Lisa Alexander bereits 10 Jahre vor ihrer Promotion als Weltklasse-Expertin ansah.

Sari Kovats ist derzeit Dozentin an der „London School of Hygiene and Tropical Medicine“. Sie ist ein noch extremeres Beispiel. Erst 2010 wurde sie promoviert. Doch bereits 1994 – 16 Jahre vorher und drei Jahre vor der Veröffentlichung ihres ersten Forschungspapiers – befand sich Kovats bereits unter jenen 21, die weltweit ausgewählt worden waren, um das erste IPCC-Kapitel auszuarbeiten, das sich die möglichen Auswirkungen des Klimawandels auf die menschliche Gesundheit untersuchte. Insgesamt war Frau Kovats zweimal Leitautorin beim IPCC und einmal Beitragende Autorin – lange, bevor sie ihre Dissertation abgeschlossen hatte.

Einer ihrer amerikanischen Kollegen beim Verfassen des Gesundheitskapitels war Jonathan Patz. Seinen Master in „Öffentliches Gesundheitswesen“ erlangte er 1992. Seine erste Fachveröffentlichung erfolgte 1995. Doch bereits 1994 hielt das IPPC seine akademischen Würden für so beeindruckend, dass er zum Leitautor ernannt wurde.

Wenn man sich die Beteiligung von Frau Kovats und Herrn Patz vorstellt, macht Paul Reiters Beschreibung des 1995er Gesundheitskapitels als „amateurhaft“ Sinn. Anstatt wirkliche Experten wie Reiter einzuladen, hat das IPCC junge, unerfahrene Nichtexperten eingestellt.

Seit Mitte der 1990er Jahre geht das so. Doch 2011 berichteten Zeitungen noch immer, dass im IPCC die „weltbesten Wissenschaftler“ versammelt sind.

Das Buch kann direkt beim TvR Medien-Verlag, über den Buchhandel oder zB. hier bei Amazon bestellt werden

[1] „The science is absolutely first rate“, Rediff-Interview mit Rajendra Pachauri, 5. 6. 2007, http://www.webcitation.org/5wYGqL431 [6. 6. 2012].

[2] Testimony before the US Senate Committee on Environment and Public Works, submitted by Dr. R K Pachauri, Chairman, Intergovernmental Panel on Climate Change (IPCC), 25. 2. 2009, Washington, DC, http://epw.senate.gov/public/index.cfm?FuseAction=Files.View& FileStore_id=d8c3fda8-d987-4d98-be99-c2c06395dfc4 [6. 6. 2012].

[3] Interview, wie Fn. 15.

[4] Rajendra Pachauri, Rede in Poznan, 1. 12. 2008, S. 1.

[5] R K Pachauri, Interview, in: The Progressive, Mai 2009.

[6] R K Pachauri, UN Summit on Climate Change, Rede, 22. 9. 2009, S. 1.

[7] Robert Watson, The public has been swindled, The Guardian, 21. 7. 2008, http://www.guardian.co.uk/commentisfree/2008/jul/21/ofcom.channel4 [7. 7. 2012].

[8] U.S. Senate Committee on Environment & Public Works, Hearing Statements, Date: 09/ 28/ 2005, Statement of Dr. William Gray, Department of Atmospheric Science, Colorado State University, The Role of Science in Environmental Policy-Making.

[9] Der volle Text des 1995er IPCC-Gesundheitskapitels findet sich hier:

http://www.webcitation.org/623qFqtAB [6. 6. 2012].

Unten auf Seite 571 (Seite 11 in der PDF-Version) heißt es: „Although anopheline mosquito species that transmit malaria do not usually survive where the mean winter temperature drops below 16-18 °C, some higher-latitude species are able to hibernate in sheltered sites.“ Zu Malaria im historischen Kontext vgl. die folgenden Links aus „The Lancet“, zu einem Vortrag von Paul Reiter, einer Rezension von Paul Reiter im Malaria Journal (2008) und zur Situation in Nairobi (ebd., 2011): www.webcitation.org/61BPoHDZF [6. 10. 2012],

www.ncbi.nlm.nih.gov/pmc/articles/PMC2627969/pdf/10653562.pdf [6. 10. 2012],

www.webcitation.org/6242mPfWj [6. 10. 2012], www.malariajournal.com/content/10/1/138 [6. 10. 2012]. Vgl. Auch http://www.malariajournal.com/content/7/S1/S3 [6. 10. 2012].

[10] Große IPCC-Berichte sind als Sachstandsberichte (assessment reports) bekannt. Bisher erschienen vier: 1990, 1995, 2001 und 2007. In diesem Buch werden sie als Klimabibel bezeichnet. Das IPCC produzierte auch eine Anzahl kleinerer Berichte zu spezifischen Themen. Klein arbeitete bei beiden Berichtsarten mit und bezieht beide in seine Zählung ein.