Katrin Göring-Eckardt erzählt die ältesten, aufgewärmten Klimawandel-Kamellen und lässt sogar wieder den deutschen Hopfen sterben

Bei den Grünen wird jemandem, der auf der Rede-Kanzel steht, nicht widersprochen, sonst bekommt er „was auf die Fresse“:

Ruhrkultour: Grünes Milljöh – “Einfach mal die Fresse halten” Wer nicht pariert, wird niedergemacht,

wie es auf dem Parteitag sogar der GRÜNE Tübinger OC, Boris Palmer erfahren musste.

Das muss die durch den Abbruch ihres Theologiestudiums für Kanzelpredigten prädestinierte K. G. Eckardt motiviert haben, auch eine Kanzelpredigt zu halten. Diese wäre im Nirwana der Geschichte verschwunden, wenn Frau Eckardt nicht noch der Meinung gewesen wäre, auch über den Klimawandel etwas sagen zu müssen.

Liebe Frau Katrin Göring-Eckardt. Wenn das Ihre Belege sind, dann haben Sie belegt, dass es keinen Klimawandel gibt

Video ab 13:28: Katrin Göring-Eckardt … Dass entlang von Rhein und Ruhr und Elbe die Unwettergefahr steigt und Köln und Dresden immer wieder überflutet werden, oder dass selbst der deutsche Hopfen krank wird, weil es zu warm wird – ich meine, das Bier ist sogar in Gefahr – das ist relevant, liebe Freundinnen und Freunde …

Dass von diesen „Belegen“ nichts übrig bleibt, wenn man nur ein wenig nachsieht und nicht nur blind von irgendjemandem nachplappert, sei anbei gezeigt.

… entlang von Rhein und Ruhr und Elbe (steigt) die Unwettergefahr …

Unwettergefahren

Es ist schwierig, den Status von Unwettergefahren und seine Veränderung zu analysieren. Grund ist, dass die „amtlichen“ Informationsberichte, zum Beispiel des Umweltbundesamtes, zwar „Unwetter“ kennen, aber keine Daten dazu angeben. Der Grund ist einfach: Die Daten geben keinen Anstieg her, und da verzichten die amtlichen „Studien“ lieber auf „nicht klimawandelgerechte“ Darstellungen.

Im UBA Bericht mit 621 Seiten Umfang: [2] 24/2015 CLIMATE CHANGE Vulnerabilität Deutschlands gegenüber dem Klimawandel steht zum Beispiel Folgendes:

Nennung Unwetter: Zwei Mal, jedoch ohne Datenbezug

Nennung Unwettergefahr: Kein Eintrag

Angaben zu Extremereignissen sind nur in Möglichkeitsform gelistet und es wird zugegeben, dass auch diese nur auf unsichere Simulationen hin getroffen wurden: … Generell sind Aussagen zur zukünftigen Entwicklung von Extremereignissen mit hohen Unsicherheiten behaftet. Neben einer Zunahme von Temperaturextremen wird im Falle eines starken Wandels auch mit einer Zunahme von Starkregenereignissen und Hochwasserereignissen gerechnet. Für Hagel und Starkwind können dagegen keine belastbaren Aussagen getroffen werden. … Da jedoch zukünftige Klimawirkungen und das Auftreten von Extremereignissen aufgrund unsicherer Klimaprojektionen nur schwer abzuschätzen sind …

Das Wort „könnte“ steht im Bericht 533 Mal,

das Wort „unsicher“ 137 Mal.

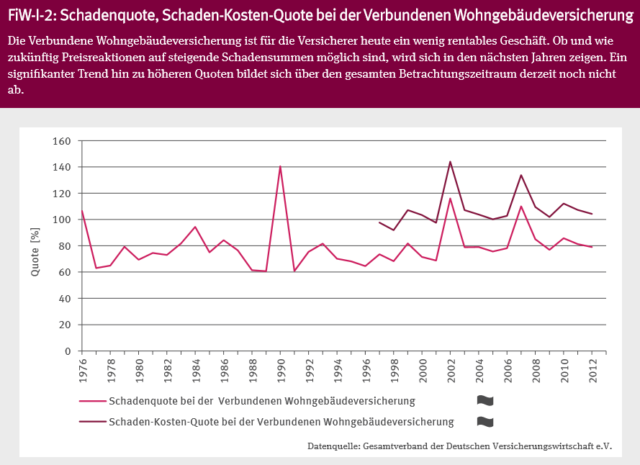

Die nächste, umfangreiche, öffentliche Studie des Umweltbundesamtes: [3] 2015 Monitoringbericht Klimawandel, gibt gleich zu, dass es nichts (negatives) darüber sagen kann. Deshalb bringt es gar keine Daten dazu, sondern eine Statistik der Versicherungswirtschaft und ansonsten die „üblichen“ Vermutungen, dass es schlimm werden könnte, weil Simulationen es zeigen.

UBA 2015: [3] Der Zusammenhang zwischen Klimawandel und steigenden Schäden durch Unwetter gilt noch nicht als gesichert, allerdings sprechen viele Indizien dafür. So wird für die Zukunft von häufigeren und extremeren Starkniederschlagsereignissen ausgegangen, die Überschwemmungen zur Folge haben können. Für die Entwicklung der Häufigkeit und Intensität von Stürmen lässt sich derzeit in Deutschland allerdings noch kein klarer Trend erkennen. Auch Projektionen in die Zukunft sind im Gegensatz zu Temperaturvorhersagen schwierig

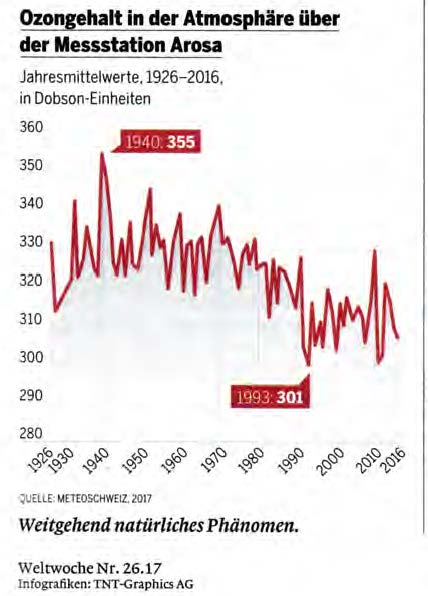

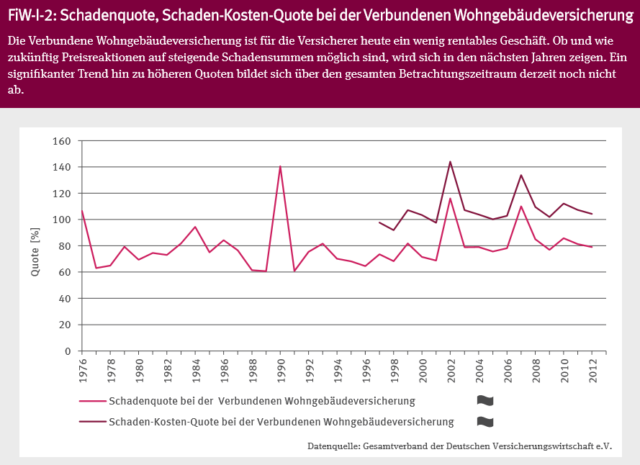

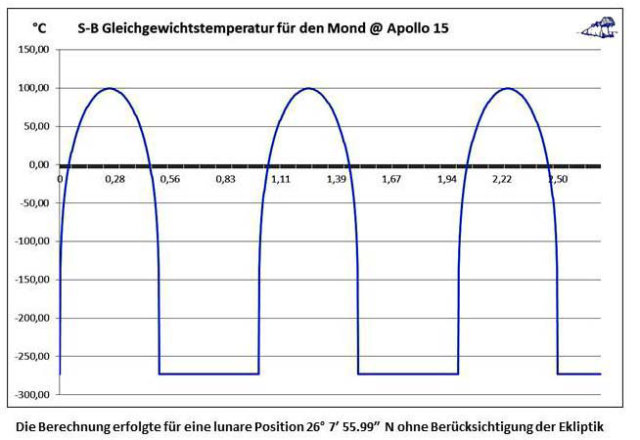

Bild 1 Schadensquoten Deutschland 1976 – 2012. Quelle: UBA [3]

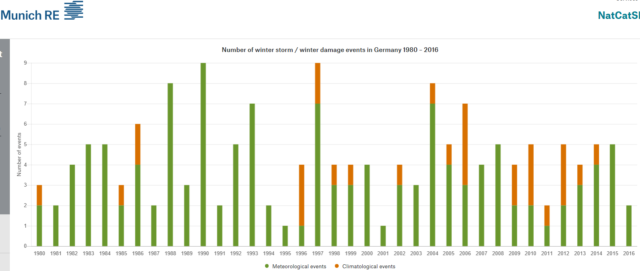

Auch in der Datenbank des weltgrößten Rückversicherers findet sich keine negative Hinterlegung,

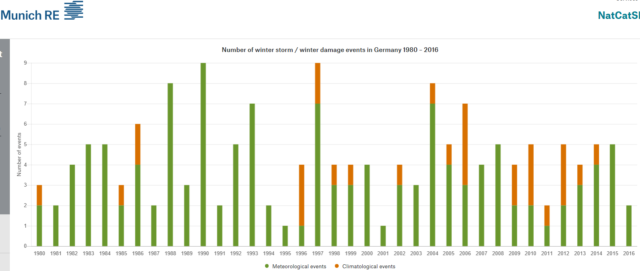

Bild 2 Anzahl Winterstürme in Deutschland seit 1980 (leider gibt es keine Daten zu Sommerstürmen). Quelle: MuRe NatCat-Viewer

und andere, amtliche Daten weisen auch nichts aus, was die Aussagen von Frau Eckardt bestätigen könnte.

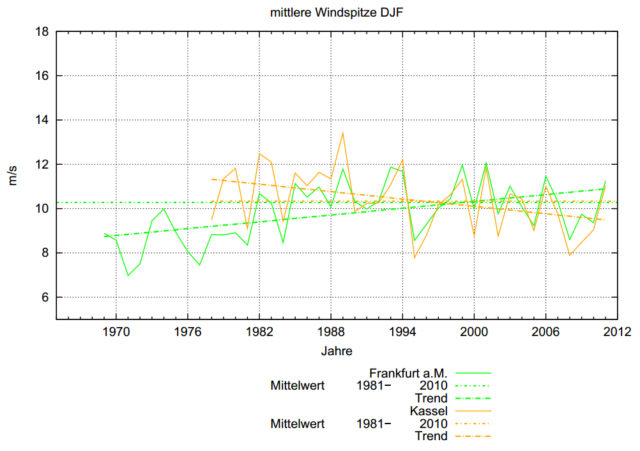

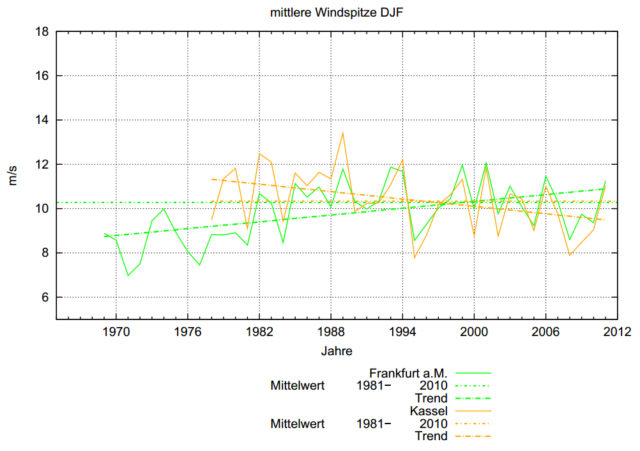

Bild 3 Mittlere Windspitzen in FfM und Kassel seit 1970. Quelle: [5] Hessisches Landesamt für Umwelt und Geologie (Wiesbaden, 2012)

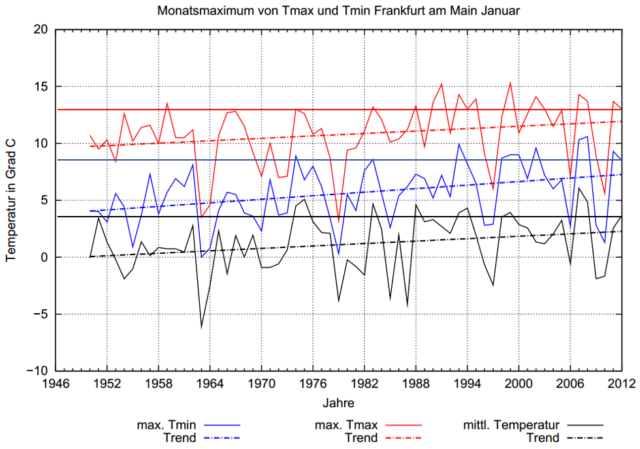

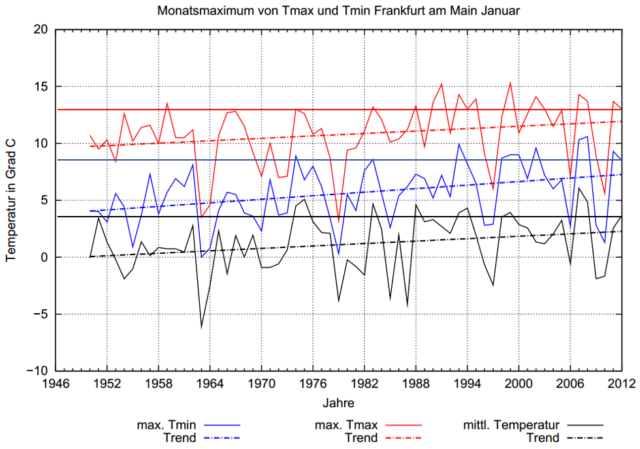

Bild 4 Monatliche Extremtemperaturen FfM seit 1950 (horizontale Linien vom Autor ergänzt). Quelle: [5] Hessisches Landesamt für Umwelt und Geologie (Wiesbaden, 2012)

Amtliche Dokumente zeigen für Deutschland keinen Anstieg von „Unwettern“ an.

Niederschlag

Ein Bestandteil von „Unwetter“ ist häufig extremer Niederschlag. Deshalb die Nachschau, ob dieser negative Anzeichen eines Klimawandels zeigt.

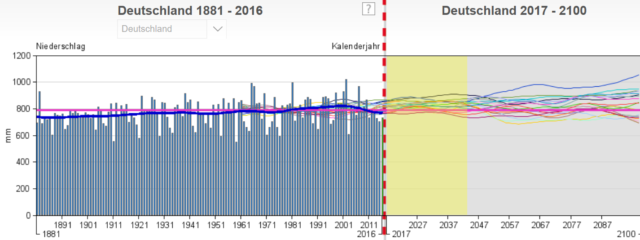

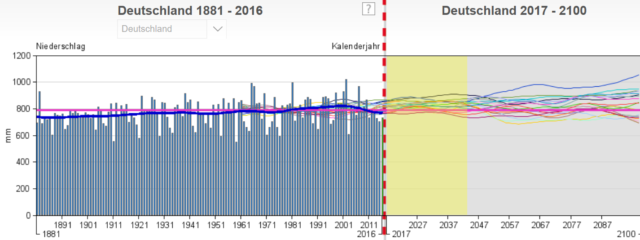

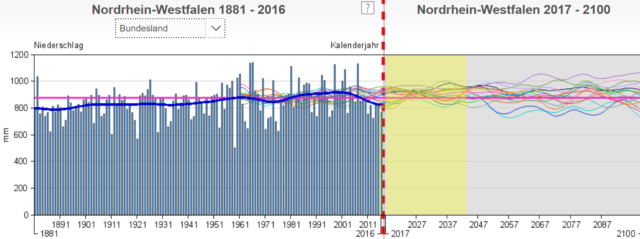

Der vom DWD veröffentlichte Klimaatlas Deutschland zeigt nichts Negatives. Weder aktuell, noch in der Projektion für die Zukunft. Im Jahr 2016 wies der Niederschlag genau den Stand zu Beginn der Messreihe (1881) aus.

Bild 5 Niederschlagsverlauf Deutschland 1881 – 2016 Monatsauflösung mit Projektionen bis 2100. Quelle: DWD Klimaatlas Deutschland

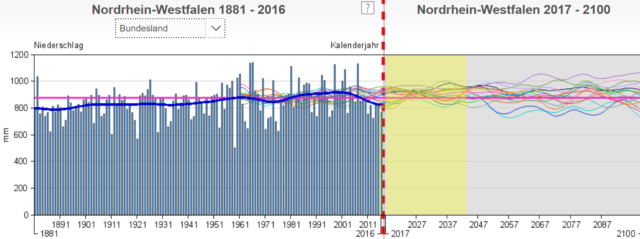

Aufgelöst auf Nordrhein-Westfahlen, wozu das speziell genannte Köln und das Ruhrgebiet gehören, findet der DWD-Klimaatlas ebenfalls nichts Ungewöhnliches. Ausgerechnet in diesem – laut Frau Eckardt besonders betroffenem Bundesland – ist die Zukunftsprojektion zum Jahr 2100 noch langweiliger geradlinig, als für das gesamte Deutschland.

Bild 6 Niederschlagsverlauf Nordrhein-Westfalen von 1991 – 2016. Quelle: DWD Klimaatlas Deutschland

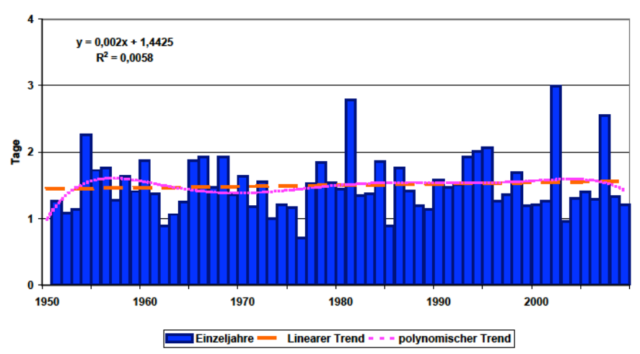

Der DWD geht in seinem „Nationaler Klimareport Deutschland 2016“ direkt auf Tage mit hohen Niederschlägen ein und berichtet auch dazu nichts Negatives, weder für Deutschland, noch für die ganze Welt:

Report: … Wird die Anzahl der Tage von mindestens 10 mm Niederschlag ausgezählt, so werden bei gleichzeitig großen jährlichen Schwankungen im Mittel über ganz Deutschland 21 Tage beobachtet. Diese Zahl hat sich in den letzten 135 Jahren kaum verändert.

Für Niederschlagsmengen von mehr als 20 mm pro Tag ist keine Änderung der Anzahl seit den 1950erJahren festzustellen.

Dem niederschlagsärmsten Winter mit 69 mm im Jahr 1890/91 steht der niederschlagsreichste Winter mit 304 mm im Jahr 1947/48 gegenüber. Normal sind 181 mm (Mittel 1961–1990).

Analysen der höchsten Tagesniederschläge je Jahr zeigen weltweit an vielen Stationen minimale Anstiege der extremen Niederschlagssummen. Bei nur wenigen Stationen (< 10 %) sind diese Trends signifikant.

Eine Detailrecherche des CLI zu Extremniederschlägen fand auch nichts davon:

Climate Service Center, Daniela Jacob at al.: Ergebnisse und Auswertungen der Recherche zur Entwicklung von Extremwetterereignissen in Deutschland

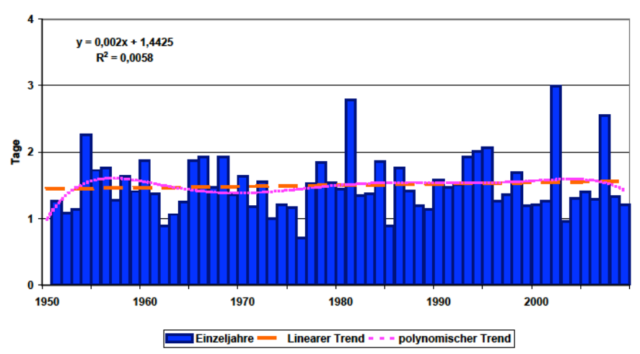

Bild 7 Anzahl der Tage mit mindestens 30 mm Niederschlag pro Jahr: Es gibt keinen langfristigen Trend; die Anzahl der Tage bleibt konstant.

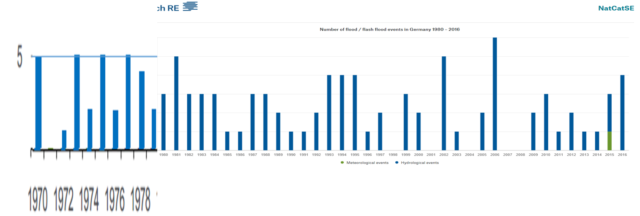

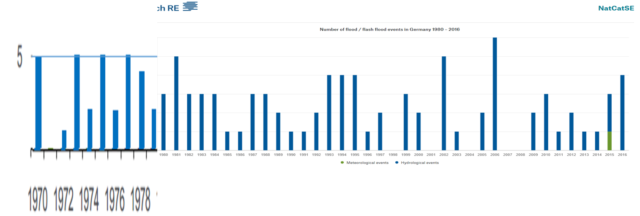

Und wieder weist auch die so gerne angezogene Datenbank der Münchner Rückversicherung keinen negativen Klimawandeleinfluss aus.

Es gibt starke Schwankungen, aber keine erkennbare Zunahme solcher Ereignisse. Im Datenbank-Viewer der MuRe kann man die Daten nur noch bis 1980 zurück anzeigen. Zufällig hatte der Autor noch eine Kopie vor dieser Umstellung ab 1970. Damit ergänzt, verschwindet jeglicher, auch nur denkbare – negative – Klimawandeleinfluss mindestens für den Zeitraum ab 1970 völlig.

Bild 8 Daten der Münchner Rückversicherungsgesellschaft zu hydrologischen und meteorologischen Ereignissen in Deutschland seit 1970. Vom Autor aus zwei Zeitspannen des NatCat-Viewer zusammengesetzt.

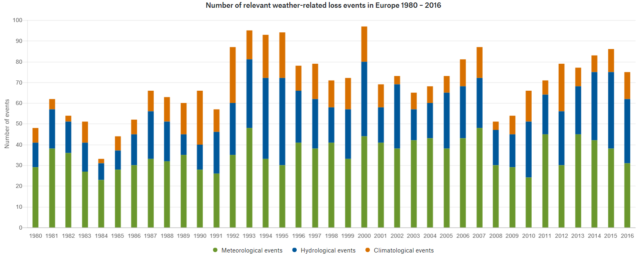

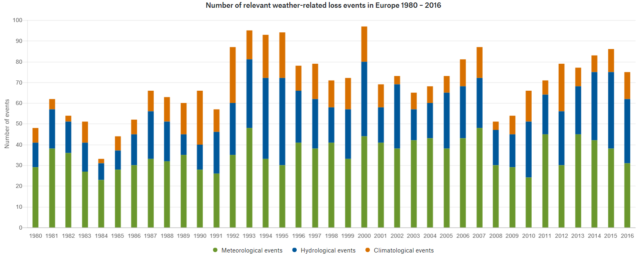

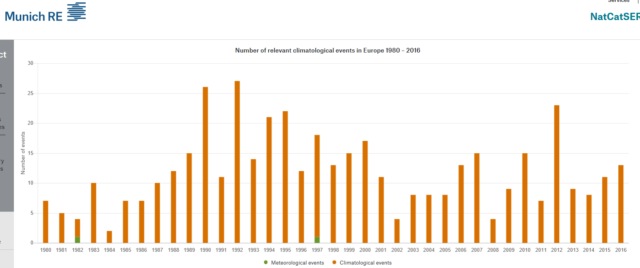

Bild 9 Daten der Münchner Rückversicherungsgesellschaft zu Wetter-bedingten Ereignissen in Europa seit 1980

Fazit

Diese nochmals ganz aktuell recherchierten Daten zeigen, dass in Deutschland beim Niederschlag und Unwettern ein AGW-Klimawandel-bedingter, negativer Trend anhand der Messdaten in keinem Fall belegbar, eher sogar ausgeschlossen ist und man dies sogar für ganz Europa annehmen kann.

Es bestätigen sich damit wieder die schon oft durchgeführten Analysen:

EIKE 14.06.2017: Fake News: Diesmal Pfingstunwetter um Hildesheim – neue Einschläge des Klimawandels?

IKE 24.01.2017: Jahrtausendhochwasser am 01.06.2016 in Simbach – so entstehen Menetekel des Klimawandels

Einzig Computersimulationen und darauf basierende Vermutungen behaupten anderes – und denen wird geglaubt.

... und Köln und Dresden immer wieder überflutet werden

Köln und Dresden werden immer wieder überflutet. Das geschieht seit Beginn menschlicher Aufzeichnungen im Mittelalter. Von daher ist die Aussage der Frau Eckard immer richtig.

Frau Eckardt sagte es aber so, dass als würden sich diese regelmäßigen Überflutungen durch einen AGW-Klimawandel verstärken – und das ist eindeutig falsch!

Dresden und die Elbe

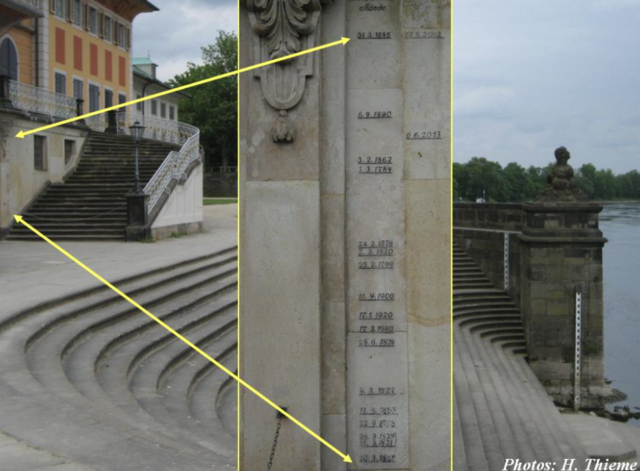

Ein Jeder wird sich an die Meldungen der letzten großen Überschwemmung von Dresen im Jahr 2002 erinnern. Kaum jemand aber daran, dass diese zwar ein selteneres, aber bei Weitem nicht einmaliges Ereignis war. So etwas kommt dort alle 50 … 100 Jahre vor.

Es kann also passieren, dass eine „Zwischengeneration“ davon verschont blieb und die inzwischen anstelle von Datenrecherchen übliche Befragung von Einheimischen [6] ergibt, dass so etwas (wie ein aktuelles Hochwasser) „noch nie in der Geschichte gewesen ist“.

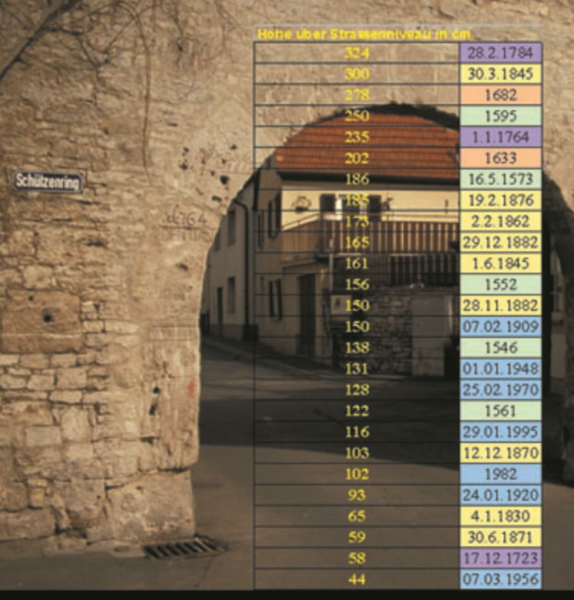

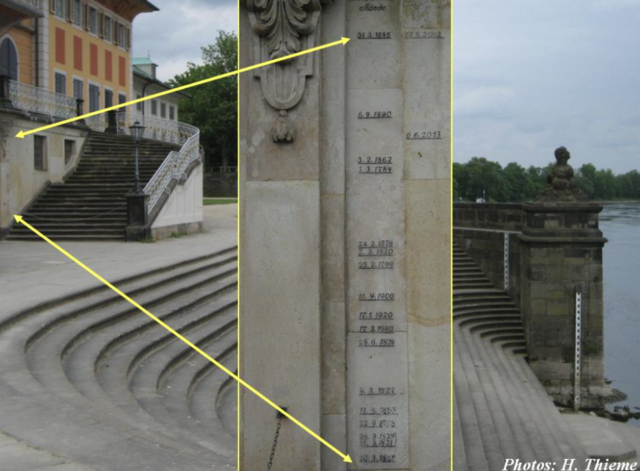

Bild 10 Hochwassermarken der Elbe bei Meißen (27 km unterhalb von Dresden), Stadtmuseum. Quelle: [1]

Bild 11 Hochwassermarken der Elbe bei Pilnitz (ca. 14 km oberhalb von Dresden). Quelle: [1]

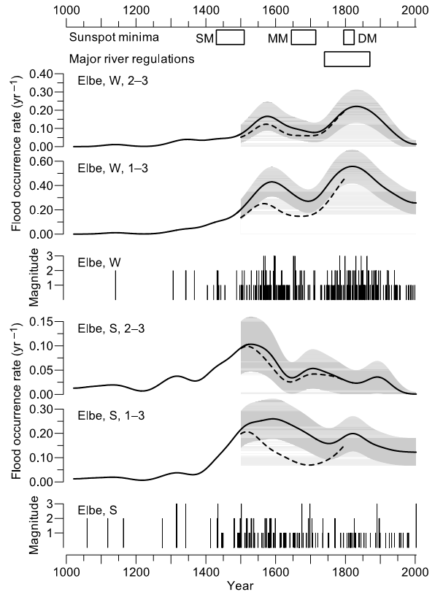

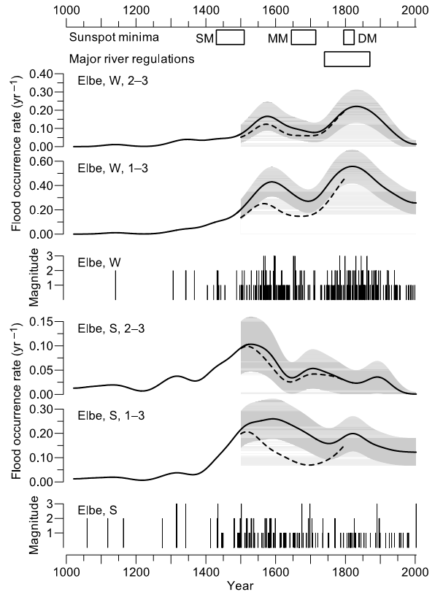

Dass Elbe-Hochwasser zyklisch sind und mit einem ominösen Klimawandel nicht zunehmen – sondern abnehmen – , zeigen neben den historischen Pegelmessungen auch Studien.

Bild 12 Hochwasserereignisdaten Elbe seit dem Jahr 1000.

Originaltext zu Bild 12: Figure 7. Occurrence of Elbe floods during winter (W; November–April) and summer (S; May–October), for all flood magnitudes (classes 1–3) and heavy floods only (classes 2–3). Kernel estimation (section 3.2.2.2) using a bandwidth of 35 years is applied to the flood dates (shown as bar charts), obtained from measurements and C. Weikinn’s documentary data (section 2.1) to calculate time-dependent flood risks,b l(t) (solid lines) with bootstrap 90% confidence band (shaded). Records before 1500 are likely not homogeneous (no confidence bands shown). Occurrence rates using documentary entries from database CLIMDAT for 1500–1799 are shown as dashed lines. Also shown are time periods of sunspot minima (SM, Spo¨rer Minimum; MM, Maunder Minimum; DM, Dalton Minimum) taken from Kurths et al. [1997] and the time period of major regulations of the river Elbe.

Quelle: M. Mudelsee Department of Earth Sciences, Boston University, Boston, Massachusetts, USA: Extreme floods in central Europe over the past 500 years: Role of cyclone pathway ‘‘Zugstrasse Vb’’

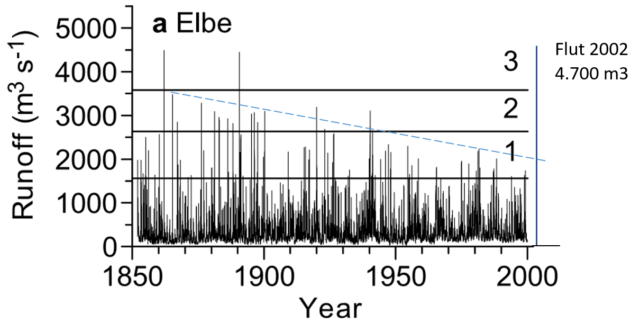

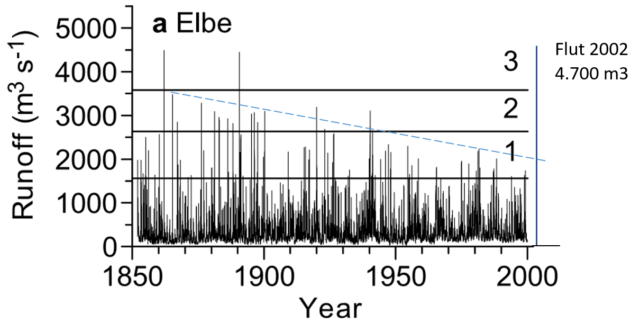

Bild 12 (Magnitude Elbe, S) und Bild 13 (Bild 13 mit vom Autor zugefügten Wassermenge von 2002) zeigen die extremen Schwankungen hydrologischer Ereignisse, vor allem jedoch eine stetige Abnahme seit dem Temperaturanstieg aus der kleinen Zwischeneiszeit (welche bereits um ca. 1600 begann) und einen Beleg, dass die in den Klimasimulationen programmierte Aussage: Mehr Wärme = mehr Überschwemmungsereignisse, falsch ist.

Bild 13 Elbe, Fließmengen. Wert der Flut 2002 von 4.700 m3 nach vom Autor nach den Angaben in der Studie ergänzt. Quelle: MUDELSEE ET AL.: EXTREME FLOODS IN CENTRAL EUROPE

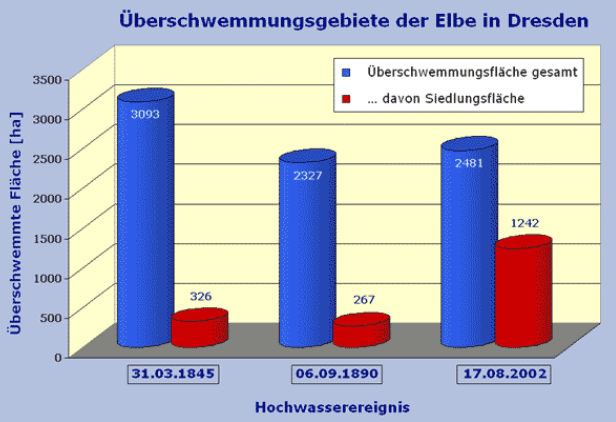

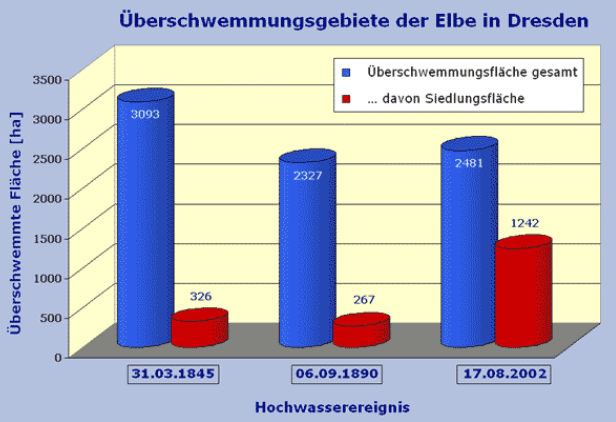

Dazu noch die überschwemmten Flächen damals und heute:

Bild 14 Überschwemmte Flächen durch Hochwasser bei Dresden. Quelle: Leibniz-Institut für ökologische Raumentwicklung e.V. Dresden

Köln und Rhein

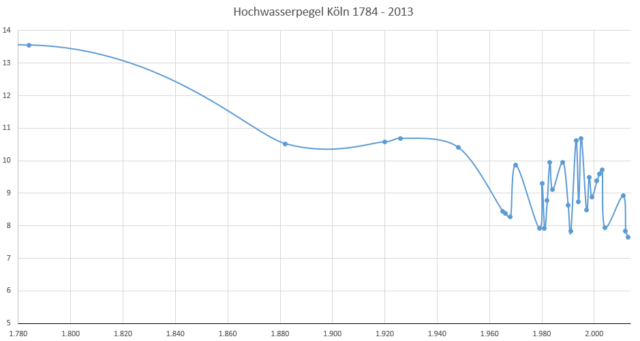

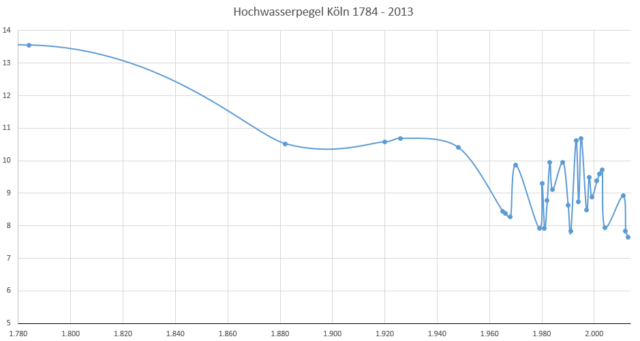

Der Autor hatte bereits vor Längerem die Hochwasser-Pegeldaten einer Langzeit-Messstelle von Köln in eine Grafik umgesetzt. Kann daran irgend jemand (außer einer GRÜNEN Vorzeige-Politikerin) eine Zunahme durch den ominösen AGW-Klimawandel erkennen? Entweder sind die historischen und auch aktuellen Daten falsch, oder Frau Eckardt ….

Bild 15 Hochwasserpegel Köln 1784 – 2013 lt. Daten der Stadtentwässerungsbetriebe Köln AöR (Grafik aus den Tabellendaten vom Autor erstellt). Y-Achse: Rheinpegel (m).

Man stelle sich vor, die Kölner könnten noch einmal mit Booten „über ihre Stadtmauer fahren“, wie es 1342 möglich war. Der sofortige Weltuntergang würde ausgerufen werden.

Hochwasser Deutschland allgemein

DWD Klimastatusbericht 2003. Zur Temperatur- und Hochwasserentwicklung der letzten 1000 Jahre in Deutschland: Historische Hochwasser

“… Die Flut von 1501 kam, wie die von 2002, im August und wütete ebenfalls im Erzgebirge und in der Elb-Region. Für derartige Sommerfluten ist häufig dieselbe Wetterlage verantwortlich: Ein Atlantiktief lädt sich über dem Mittelmeer mit Wasserdampf auf, driftet dann nach Norden, wo es die Wassermassen über Mitteleuropa

ausklinkt.

Dieser Wetterprozess bewirkte nach Meinung des verstorbenen Meteorologen Rainer Roth von der Universität Hannover auch die „Sintflut“ von 1342, Magdalenen-Hochwasser“ genannt, da die Katastrophe am Sankt-Magdalenen-Tag, dem 21. Juli, auftrat. Das Zentrum der Niederschläge lag damals im Einzugsgebiet des Mains, also weiter westlich als beim Elbe-Hochwasser 2002. Würzburg, Frankfurt und Köln verzeichneten Rekordmarken, die seitdem nicht wieder erreicht wurden. In Würzburg riss das Wasser alle Brücken fort. Die Kölner konnten mit Booten über die Stadtmauer fahren. Wenn man also überhaupt von einer Jahrtausendflut sprechen will, dann war es die von 1342. Dieser Meinung ist auch der Hydrologe und Buchautor Martin Schmidt. In seiner Analyse der historischen Hochwasser im deutschen Rheingebiet kommt er zu dem überraschenden Schluss: „Die verfügbaren Informationen und Daten lassen das 20. Jahrhundert als eines erscheinen, das nicht einmal ein Jahrhunderthochwasser gehabt hat.“…”11

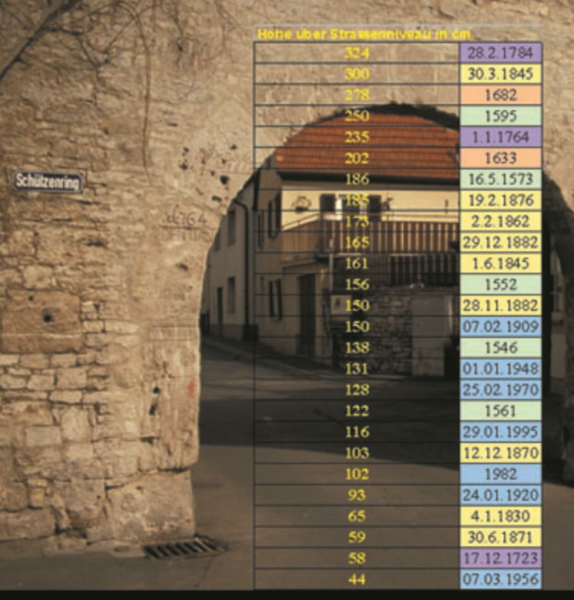

Daraus noch Hochwassermarken des Mains. Man muss weit nach unten suchen, um ein jüngeres Datum (das jüngste ist 1970) zu finden.

Bild 16 Hochwassermarken in Eibelstadt am Main. Quelle: DWD Klimastatusbericht 2003 Zur Temperatur- und Hochwasserentwicklung der letzten 1000 Jahre in Deutschland

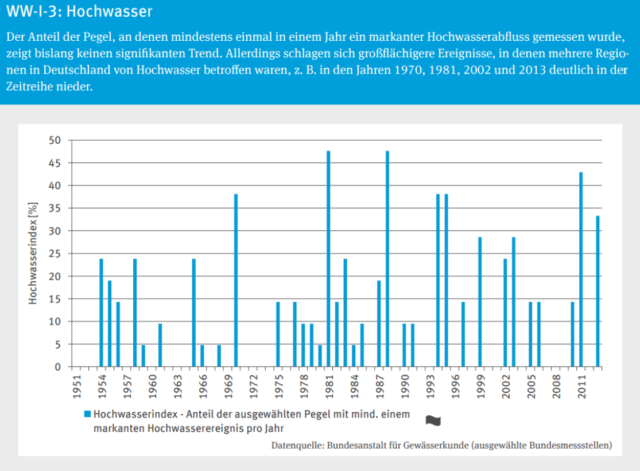

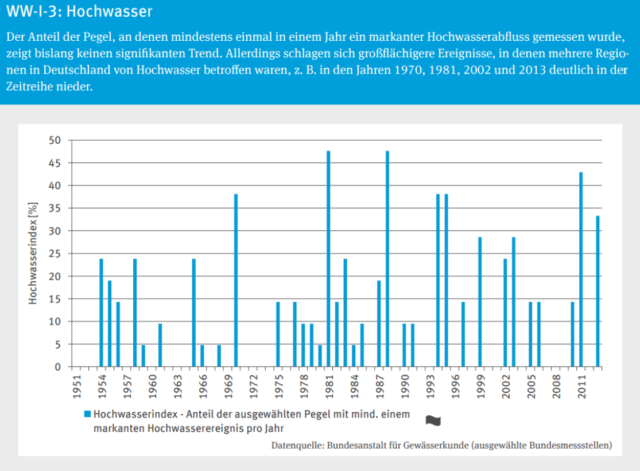

Der Klimamonitoringbericht 2015 des UBA beschreibt die Hochwasserlage und Tendenz für Deutschland:

UBA: … Obwohl es im Betrachtungszeitraum mehrfach großflächige Hochwasserereignisse gegeben hat, ist kein signifikanter Trend abzulesen.

Bild 17 [3] UBA Klimainformation Bild 26

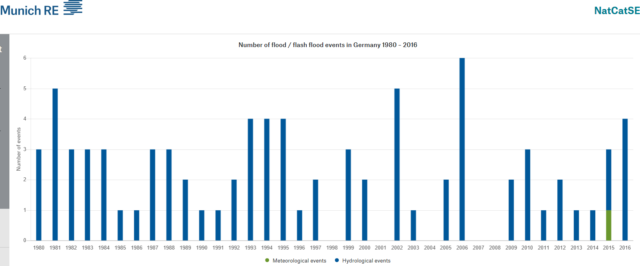

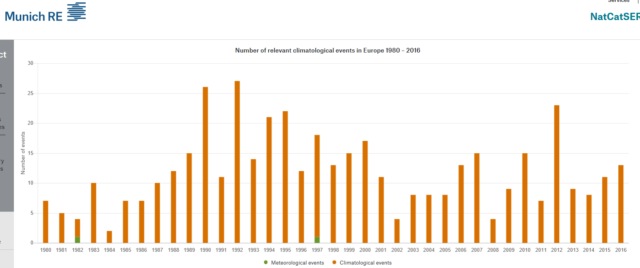

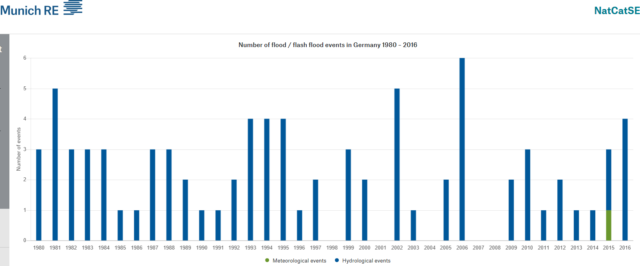

Wieder Daten der MunichRe, die angeblich den schlimmen Klimawandel belegen (sollen). Wieder zeigen diese auch dazu keinenn Beleg.

Bild 18 Anzahl der Flutereignisse Deutschland seit 1980. Quelle MuRE NatCat-Viewer

Bild 19 Anzahl relevanter klimatischer Ereignisse in Europa seit 1980. Quelle MuRE NatCat-Viewer

Als Ergebnis lässt sich nur feststellen, dass auch Hochwasserereignisse an den genannten Orten nicht entfernt durch einen AGW-Klimawandel zugenommen haben, oder dabei wären, es zu tun.

Fazit

Sehr geehrte Frau K. G. Eckardt. Sofern Sie, oder einer ihrer Mitarbeiter*innen dies lesen sollten. Fällt Ihnen auf, dass die Überschwemmungen in Deutschland zur Kaltzeit wesentlich schlimmer waren und die (geringfügige) Erwärmung auch hierzu ihren Segen mit einer mindestens niedrigeren Wiederholrate, meist jedoch auch zusätzlich niedrigeren Pegeln brachte?

Sofern Sie meinen, das wären (noch) zu wenig Belege, dann sehen Sie in den weiteren Recherchen dazu nach. Andere, als die zwei von Ihnen genannten Flüsse in Deutschland bestätigen es teils noch deutlicher:

EIKE 09.06.2016: An den Unwettern ist der Mensch eher nicht schuld – aber ganz sicher an deren Folgen

EIKE 29.10.2015: Kann man den Klimawandel in Deutschland wirklich täglich spüren? Eine Suche mit überraschendem Ergebnis

EIKE 21.11.2015: Die bayerische Umweltministerin Frau Scharf: Extremwetter, Extrem-Hochwasser und die Unberechenbarkeit des Wetters nehmen zu. Doch stimmt das wirklich?

Wie oft muss der Hopfen noch den (simulierten) Klimawandeltod sterben?

Es gibt wohl nichts, was eine*n GRÜNEN Vordenker*in dazu veranlassen könnte, sich an der Wirklichkeit zu orientieren.

Ein „Untergangsguru“, der zum Klimaalarmisten mutierte Professor H. Lesch, interpretierte eine Studie über Hopfen falsch:

EIKE 24.08.2016: Wenn der Hopfen nicht stirbt, stirbt dann der Klimawandel?

-und schon ist diese – einfach nur falsche – „Erkenntnis“ bei den Grünen nicht mehr auszurotten.

Bei EIKE einfach einmal nachzusehen, was dort darüber recherchiert und zusammengetragen wurde, ist für GRÜNE (Ver)Führungskräfte wohl nicht zumutbar, da dann ihr so schön gezimmertes Trugbild zusammenfallen müsste.

EIKE 22.08.2015: Grüne Abgeordnete Barbara Höhn durch Fakten widerlegt: Der Hopfenertrag steigt trotz Klimawandel

EIKE 31.08.2016: Schlechte Erntejahre kommen ganz offenbar immer häufiger

In der freien Natur ging es dem Hopfen noch nie besser als heute

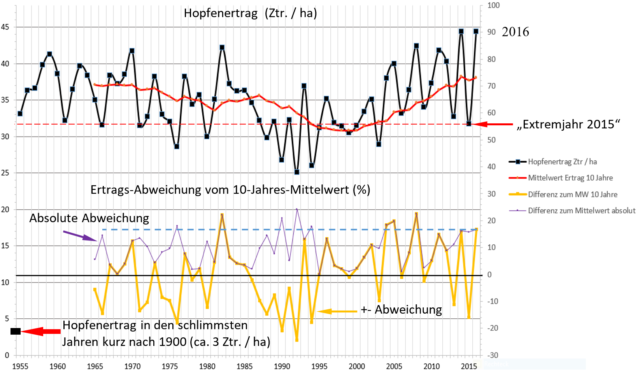

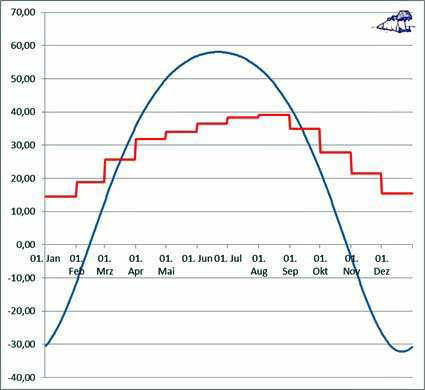

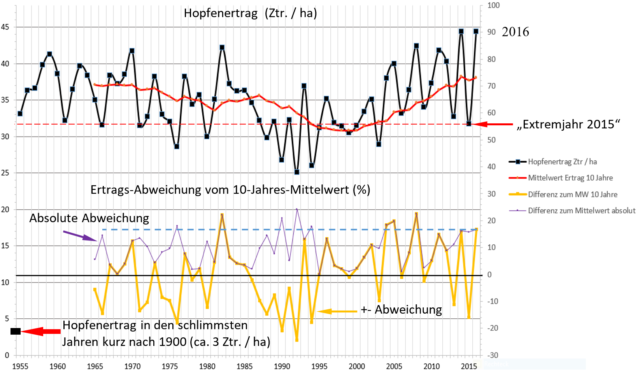

Mit dem Klimawandel ist der Ertrag nach Aussage des zuständigen Verbandes geradezu explodiert, während man um 1920 überlegte, den Anbau mangels Ertrag in Deutschland ganz einzustellen. Das jedenfalls zeigen die Ertragsgrafiken und sagte man auf einer Verbandstagung.

Bild 20 Hopfenertrag Deutschland (schwarz) mit 10-Jahres Mittelwert (rot) lt. Daten der LfL Jahresberichte Sonderkultur Hopfen (nur die von 2016 sind aus der Zeitung), ergänzt um die Differenz zum 10-Jahres-Mittelwert (gelb), rechte Achse (%)

Vortrag von Michael Doetsch, Paulaner Brauerei GmbH & Co. KG: [4] Verbesserung des Hopfenanbaus seit 1975

-Steigerung der Produktivität pro ha um das 8fache

-infolge des in Hüll entwickelten Prognosemodells zusammen mit den in Hüll gezüchteten Sorten (Magnum und Taurus als Beispiel) heute pro kg Alpha nur noch 4 % der Spritzmenge ausgebracht werden muss im Vergleich zu 1975. Bei Herkules sogar nur 3 %

-Infolge der Erhöhung des ha-Ertrages und der damit einhergehenden Reduzierung des Arbeitseinsatzes – dieser hat sich in dem Zeitraum von 1975 bis heute von 650 h/ha/Jahr auf rd. 200 h/ha/Jahr, d. h. rund 70 % reduziert! – war es möglich, in dem Wettbewerb mit den Billiglohnländern auf der einen Seite und dem fast schon industrialisierten Hopfenanbau in den USA auf der anderen zu bestehen, ja sogar die Nase vorn zu behalten.

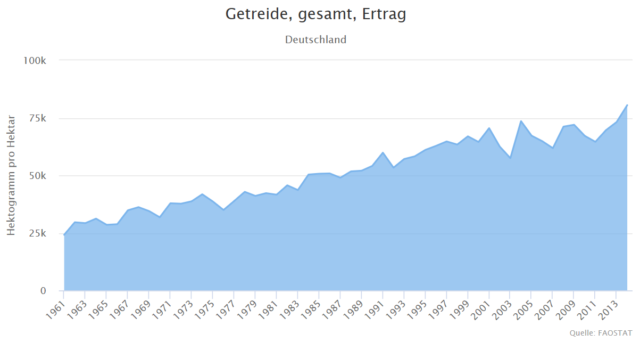

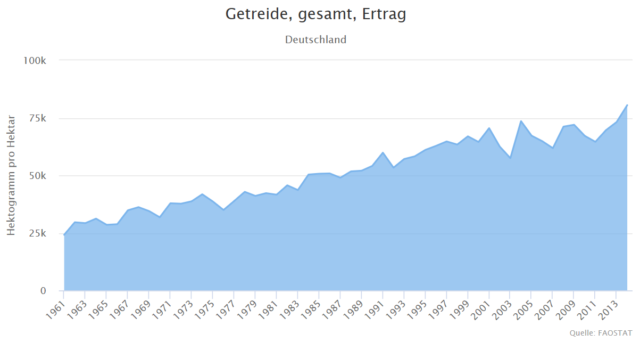

Dass dies nicht nur für den Hopfen zutrifft, zeigt noch das folgende Bild.

Bild 21 Weizenertragsverlauf Deutschland seit 1961. Quelle: FAOSTAT

Doch gibt es einen möglichen Grund für in Zukunft sinkende Erträge: Der Übergang zu Niedrig-Gerüstsystemen [4]. Da man dafür andere Hopfensorten verwenden muss, sinkt dann zwar der Ertrag, aber noch deutlicher die Kosten, so dass es sich in Summe lohnen soll.

Nicht vergessen darf man, dass es der Hopfen im Sommer auch feucht liebt, ein Grund weshalb er in feuchteren, aber auch für Hagel anfällige Gegenden angebaut wird. Das Feuchte gefällt jedoch auch den Schadpilzen und Ungeziefer. Pestizide werden aber zunehmend verboten. Auch ein Problem, welches der Mensch, aber nicht der Klimawandel verursacht.

Wenn es so weit kommt, wird an der Ertragsminderung bestimmt der Klimawandel schuld sein.

Es könnte natürlich auch einmal sein, dass die Kälte wie um 1975 wieder kommt, als die „Wissenschaftler“ sich sicher waren, dass die nächste Eiszeit begonnen hat. Dann könnte der Hopfen wieder auf ein Achtel des aktuellen Ertrages zurück-geschrumpft sein. Die Hopfenbauern werden sich dann freuen, weil damit der von den GRÜNEN herbeigesehnte „natürliche Idealzustand“ erreicht ist.

… das ist relevant, liebe Freundinnen und Freunde

Dass (auch) die GRÜNE Führungsriege ihre Wähler nach Strich und Faden belügt, ist mit dem Video auf YouTube: „Ihr habt keine Ahnung, Kretschmann“ [7], in dem ein Tischgespräch von Herrn Kretschmann mit seinem Nachbarn auf dem Parteitag unbemerkt aufgenommen wurde, demonstrativ gezeigt (Özdemir erklärt in die Kamera, wie einig man sich Im Führungskreis auch mit Kretschmann gewesen sei. Im aufgenommenen Tischgespräch erzählte Herr Kretschmann seinem Tischnachbarn darüber jedoch genau das Gegenteil).

Das kann passieren (dass so etwas durch einen blöden Zufall bekannt wird), weil es bei allen Parteien so sein wird.

Nur, weil der neue SPD-Messias aus Würselen, verkündete:

DIE WELT – Freitag, 26. Mai 2017: M. Schulz: … „Keine politische Kraft darf zu keiner Zeit falsche Nachrichten verbreiten“

wird sich die Politik bestimmt nicht ändern. Falls sich Herr Schulz selbst in Zukunft daran halten würde, könnte sich die Anzahl solcher Politiker in Berlin aber wenigstens deutlich erhöhen.

… denn ohne Untergangsandrohungen hätte unsere Partei keine Inhalte und keine Berechtigung mehr

Die Rede von Frau Eckardt zeigt aber erneut, wie arrogant von der obersten politischen Kaste die Parteimitglieder und das Wahlvolk zum Narren gehalten werden. Frau Eckardt hat diese Rede mit Sicherheit gut vorbereitet, um ihre Pointe mit dem Bier setzen zu können. Bei Interesse an Fakten wäre sie dabei ganz schnell auf die Wirklichkeit gestoßen – und hätte darauf verzichten müssen.

So etwas macht man bei den Grünen jedoch nicht. Denn diese halten auf Parteitagen sogar mit den Fakten noch schlimmer umgehende Vorträge von Prof. H. Lesch aus:

EIKE 01.01.2016: Harald Lesch trägt vor den GRÜNEN zum Klimawandel vor: Der Klimawandel ist kein Thema, das man ernsthaft bezweifeln kann,

-zudem hat es die GRÜNE, Barbara Höhn ja auch schon so gemacht:

EIKE 22.08.2015: Grüne Abgeordnete Barbara Höhn durch Fakten widerlegt: Der Hopfenertrag steigt trotz Klimawandel.

Wenn es zur „Belegführung“ der Ideologie erforderlich ist, beauftragt man bei willigen Nicht-Fachpersonen Studien, die das Unwahre in Wahrheit verwandeln:

EIKE 28.8.2015: Wenn Politologinnen „Klimastudien“ machen – zur „Klimastudie“ von Bündnis 90/Die Grünen,

wenn zur Untermauerung der Ideologie die dilettantisch und oberflächlich durchgeführten „Analysen“ der politischen „Wahrheitsfabrik“ nicht ausreichen:

EIKE 19.08.2016: Teil II: Vom Wissenschaftlichen Dienst veröffentlichte Klimainformation für Abgeordnete Rezension: Teil 2 (und Teil1)

Quellen

[1] WEB-Seite: Historische Hochwassermarken

[2] Umweltbundesamt: 24/2015 CLIMATE CHANGE Vulnerabilität Deutschlands gegenüber dem Klimawandel

[3] Umweltbundesamt: 2015 Monitoringbericht zur Deutschen Anpassungsstrategie an den Klimawandel

[4] Internationales Symposium: Hopfenanbau 2020 Wolnzach (5./6.5.2008; st)

[5] Hessisches Landesamt für Umwelt und Geologie (Wiesbaden, 2012), C. M. Weder: Erstellung einer Statistik über Extremereignisse und Klimaveränderungen in Hessen

[6] EIKE 10.05.2017: Die Volkshochschule Hannover und ihre Ausstellung: Wir alle sind Zeugen – Menschen im Klimawandel

[7] EIKE, 26.06.2017: Ein GRÜNER Spitzenpolitiker denkt heimlich – entlarvt den Unsinn der Elektroautos und nebenbei noch Lügen der Parteispitze