Es ist ein sehr großes FALLS. Wir könnten Billionen für nichts verschwenden. Tatsächlich hat Lord Stern geschätzt, dass es es wert wäre, jedes Jahr ein paar Billionen Dollar auszugeben, um ein mögliches Desaster in 200 Jahren zu vermeiden. Weil er mit der London School of Economics assoziiert ist, wird ihm geglaubt – zumindest von jenen, deren Erfahrungen mit Versicherungen begrenzt sind. All jene, die diese Erfahrung haben wissen, dass es es nicht wert ist, sich gegen etwas zu versichern, das in 200 Jahren eintreten könnte – es ist unendlich besser sicherzustellen, dass unsere Kinder damit fertig werden. Mit jedwedem Glück werden sie Gleiches mit ihren Kindern tun, und die Ur-Ur-Urenkel werden gute Individuen sein, die sehr gut mit Lord Sterns kleinem Problem umgehen können.

Also habe ich mich entschlossen, die Hypothese ausgehend von fünf Prinzipien zu untersuchen. Es gibt fünf Schritte zu der Hypothese:

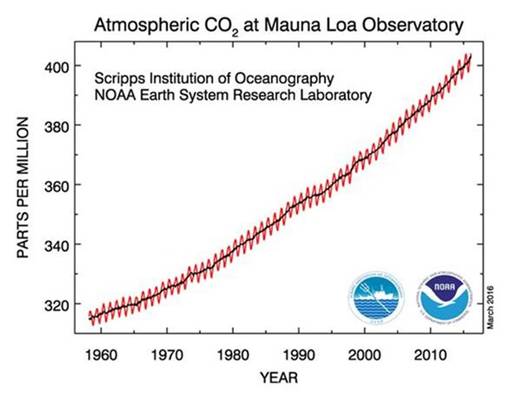

1. Der CO2-Gehalt der Atmosphäre steigt.

2. Der CO2-Anstieg in der Atmosphäre geht zum großen Teil einher mit der Zunahme der Verbrennung fossiler Treibstoffe. Die Verbrennung fossiler Treibstoffe führt zu CO2-Emissionen, so dass es sehr angemessen scheint, die beiden Zunahmen in Verbindung miteinander zu bringen.

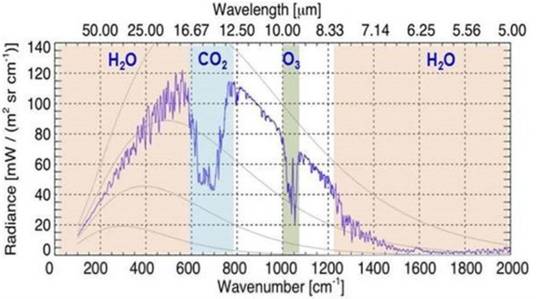

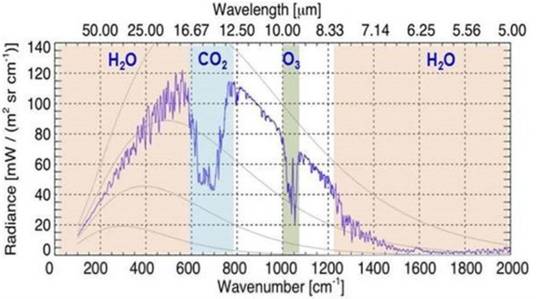

3. CO2 kann Infrarot streuen über Wellenlängen primär um etwa 15 µm. Infrarot dieser Wellenlänge, welche Energie von unserem Planeten wegführen sollte, wird in die untere Troposphäre zurück gestreut, wo der zusätzliche Energie-Input einen Temperaturanstieg verursachen sollte.

4. Die erwartete Zunahme der Energie der unteren Troposphäre kann langfristige Änderungen des Klimas und der Thermosphäre verursachen, was charakterisiert werden könnte durch eine Zunahme der Häufigkeit und Intensität von Extremwetterereignissen, durch steigende Wassertemperatur in den Ozeanen, eine Verringerung der Eisbedeckung und viele weitere Änderungen.

5. Die größte Bedrohung ist, dass der Meeresspiegel steigen und Gebiete überfluten könnte, die derzeit dicht besiedelt sind.

Sind diese Hypothesen in wissenschaftlichem Sinne haltbar? Gibt es eine solide Logik bei der Herstellung einer Relation zwischen jedem Schritt in dieser Kette?

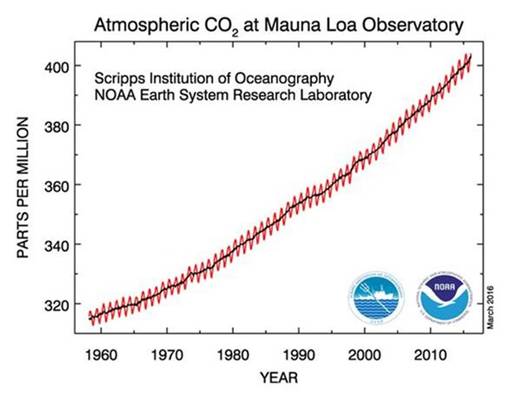

Der CO2-Anstieg in der Atmosphäre ist unbestreitbar. Viele Messungen zeigen ihn. Zum Beispiel gab es seit dem Jahr 1958 kontinuierliche Messungen auf dem Mauna Loa-Observatorium in Hawaii:

Anstieg und Rückgang von Jahr zu Jahr ist dem je nach Jahreszeit unterschiedlichen Pflanzenwachstum geschuldet. Aber der langzeitliche Trend zeigt eine stetige CO2-Zunahme in der Atmosphäre.

Vor 1958 gab es nur sporadische Messungen des CO2-Gehaltes, keine kontinuierlichen. Nichtsdestotrotz gibt es ausreichende Informationen, eine diesbezügliche Rekonstruktion zurück bis in das Jahr 1850 vorzunehmen:

Es gab einen leichten Anstieg des atmosphärischen Niveaus um das Jahr 1900, dann eine Periode mit nahezu Stillstand bis nach 1950, als ein starker Anstieg einsetzte, der bis zum heutigen Tag anhält. Man behalte diese Graphik mal im Hinterkopf – sie wird in anderer Form noch einmal erscheinen.

Die Schlussfolgerung ist eindeutig – es gab eine Zunahme des CO2-Gehaltes in der Atmosphäre. Was könnte die Ursache dafür sein?

Nun, es gibt die gleiche Verteilung von CO2-Emissionen durch die Verbrennung fossiler Treibstoffe und anderer industrieller Quellen:

Eine ähnliche Verteilung ist kein Beweis – Korrelation ist nicht Kausalität. Aber falls man versucht, die Emissionen direkt mit der Zunahme des CO2 in der Atmosphäre in Verbindung zu bringen, wird man scheitern. Es gibt viele nur teilweise verstandene „Senken“, welche CO2 aus der Atmosphäre entfernen. Die Erkennung der Dynamik all dieser Senken hat sich als schwierig herausgestellt, und darum haben wir kein wirklich gutes chemisches Gleichgewicht zwischen dem, was emittiert wird und dem, was in die Luft kommt.

Glücklicherweise gibt es Isotope, die uns helfen. Es gibt zwei primäre Pflanzenbestandteile, C3 und C4. C3-Pflanzen sind sehr alt und tendieren dazu, eher das Kohlestoffisotop 12C zu bevorzugen als das Kohlenstoffisotop 13C. Pflanzen mit C4-Bestandteil sind vergleichsweise jünger, und sie sind bzgl. ihrer Isotopen-Diät nicht so anspruchsvoll. Fossile Treibstoffe stammen aus einer Zeit, bevor die Evolution C4-Bestandteile hervorgebracht hatte, so dass sie reicher an 12C sind als die heutige Biomasse. Emittiert man also 12C-reiches CO2 aus fossilen Treibstoffen in die Luft, sollte der 13C-Anteil in der Luft sinken, und das ist genau das, was beobachtet wird:

Der Beweis, dass die Verbrennung fossiler Treibstoffe die Ursache für die CO2-Zunahme in der Atmosphäre ist, ist also wirklich schlüssig. Aber hat das irgendwelche Auswirkungen?

Kohlendioxid verteilt Infrarot über eine geringe Energie-Bandbreite. Die Infrarot-Photonen, welche Energie vom Planeten entfernen sollten, werden in die untere Troposphäre zurück gestreut. Die zusätzliche Energie sollte einen Temperaturanstieg verursachen.

Die obere graue Linie zeigt das Spektrum, welches angenähert dem Spektrum der mittleren Albedo des Planeten Erde bei einer Temperatur von 280 K entspricht. Das ist die Temperatur etwa 5 km über der Oberfläche, wo sich einfallende und ausgehende Strahlung im Gleichgewicht befinden. Das tatsächliche Spektrum wird durch die blaue Linie repräsentiert. Der Unterschied zwischen beiden ist die verloren gegangene Energie durch die von Treibhausgasen verursachten Verteilungs-Prozesse. Wasserdampf hat bei Weitem die stärkste Auswirkung. CO2 trägt zum Verlust zwischen 13 und 17 μm bei, Ozon zwischen etwa 9 und 10 μm.

Der Effekt der CO2-Absorption nimmt logarithmisch mit der Konzentration ab. Die Verdoppelung der Konzentration wird nicht irgendwelche Auswirkungen verdoppeln. Tatsächlich befinden sich derzeit etwa rund 400 ppm in der Atmosphäre. Es ist unwahrscheinlich, dass die Welt mit einem Gehalt von 800 ppm sehr viel anders aussehen würde. Sie wird grüner sein – Pflanzen wachsen besser – und es könnte geringfügig wärmer und feuchter sein, aber sonst würde die Welt sehr wie unsere Welt jetzt aussehen.

So wir irgendwelche Auswirkungen jedoch proportional mit der Zunahme der Konzentration geringer werden, so werden sie mit jeder Abnahme proportional zunehmen. [Original: However, just as any effect will lessen proportionately with increase in concentration, so it will increase proportionately with any decrease.] Falls es dabei irgendwelche beobachtbaren Effekte gibt, sollte man sie in historischen Aufzeichnungen finden. Haben wir sie gesehen?

Es gibt „offizielle“ historische Temperaturaufzeichnungen. Eine Version aus jüngerer Zeit von der HadCRU sieht so aus:

Die vertikale Achse zeigt das, was unter dem Begriff „Temperatur-Anomalie“ bekannt ist, also die Abweichung von der mittleren Temperatur über den Zeitraum 1950 bis 1980. Man erinnere sich, dass der CO2-Gehalt erst nach 1950 signifikant wurde, so dass wir diese Abbildung mit diesem Faktum im Hinterkopf betrachten können:

• von 1870 bis 1910 sank die Temperatur, es gab keinen signifikanten CO2-Anstieg.

• von 1910 bis 1950 stieg die Temperatur, es gab keinen signifikanten CO2-Anstieg.

• von 1950 bis 1975 sank die Temperatur, der CO2-Gehalt war gestiegen.

• von 1975 bis 2000 stiegen sowohl die Temperatur als auch der CO2-Gehalt.

• von 2000 bis 2015 hat die Temperatur geringfügig, der CO2-Gehalt hingegen stark zugenommen.

Treibt das Kohlendioxid Temperaturänderungen an? Schaut man auf diesen Beweis, muss man sagen, dass falls es eine Relation gibt, diese sehr schwach sein muss. In einer Studie von den Eisbohrkern-Aufzeichnungen über 8000 Jahre fand ich, dass es eine Wahrscheinlichkeit von 95% gibt, dass sich die Temperatur aus natürlichen Gründen um bis zu ±2°C innerhalb von 100 Jahren ändern würde. Während des 20.Jahrhunderts änderte sie sich um 0,8°C. Schlussfolgerung? Falls das CO2 in der Luft wirklich globale Erwärmung verursacht, muss das Signal erst noch aus dem natürlichen Rauschen auftauchen.

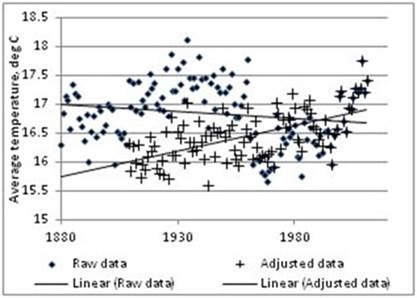

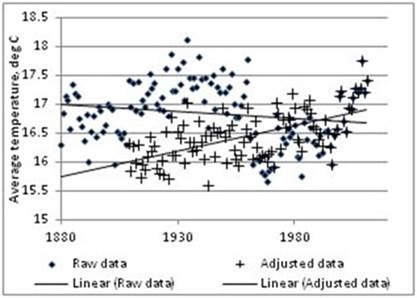

Eines der Probleme mit den „offiziellen“ Temperaturaufzeichnungen wie die oben gezeigte Reihe von HadCRU ist, dass sie Gegenstand von „Adjustierungen“ waren. Während manche Adjustierungen von Rohdaten offensichtlich erforderlich sind, wie beispielsweise die Berücksichtigung der Seehöhe eines Messpunktes, war die Adjustierung in diesem Falle dergestalt, dass die Vergangenheit kälter und die Gegenwart wärmer gemacht worden ist, was die globale Erwärmung viel dramatischer aussehen lässt als es aus den Rohdaten hervorgeht.

Es könnte unvernünftig aussehen, sich auf die offiziellen Daten als „adjustiert“ zu beziehen. Allerdings ist die Grundlage der offiziellen Daten das, was als das Global Historical Climatology Network or GHCN bekannt ist, und es wurde willkürlich adjustiert. Zum Beispiel ist es möglich, die Rohdaten von Kapstadt von 1880 bis 2011 mit den Adjustierungen zu vergleichen, die an die Daten der sich entwickelnden GHCN-Reihen Version 3 angebracht worden waren:

Das Goddard Institute for Space Studies GISS ist verantwortlich für das GHCN. Das Institut befasste sich mit den den Adjustierungen zugrunde liegenden Metadaten. Sie zeigten eine einzelne Datenlinie, gaben die geographischen Koordinaten und die Seehöhe des Messpunktes an sowie eine kurze Reihe bedeutungsloser Daten einschließlich des Wörtchens „COOL“. Die Grundlage der Adjustierungen ist daher unbekannt, aber die Tatsache, dass etwa 40 aufeinanderfolgende Jahre lang Daten um genau 1,10°C „adjustiert“ worden sind, zeigt ziemlich eindeutig, dass hier die Methode „Pi mal Daumen“ angewendet worden ist anstatt von Algorithmen.

Es gab inzwischen so viele Manipulationen der „offiziellen“ Aufzeichnungen der globalen Erwärmung, dass sie keinerlei Glaubwürdigkeit mehr haben. Das soll nicht heißen, dass sich die Erde während der letzten Jahrhunderte nicht erwärmt hat. Gletscher zogen sich zurück, Schneefallgrenzen stiegen. Es gab Erwärmung, aber wir wissen nicht wie viel.

Interessanterweise sind die gemessenen Temperaturen nicht eindeutig. Zum Beispiel hat das Abschmelzen von Eis an Alpenpässen in Europa Wege ans Licht gebracht, die vor 1000 Jahren und noch früher regelmäßig benutzt worden waren. Danach waren sie von Eis bedeckt, das erst in jüngster Zeit wieder geschmolzen ist. Die Schutthalden neben den Wegen, die diese historischen Reisenden genommen haben, bieten eine reiche Vielfalt archäologischen Materials.

Folglich muss die Welt vor einem Jahrtausend mindestens so warm gewesen sein wie heute. Sie hat sich währen der letzten paar hundert Jahre erwärmt, aber die Erwärmung ist primär natürlichen Ursprungs und hat nichts mit menschlichen Aktivitäten zu tun. Wir haben nicht einmal eine Ahnung davon, ob es überhaupt irgendwelche Auswirkungen menschlicher Aktivitäten gibt, und wir können mit Sicherheit nicht sagen, ob irgendein Anteil der beobachteten Erwärmung anthropogenen Ursprungs ist. Die Physik sagt, dass wir eine Auswirkung haben sollten, aber wir können sie noch nicht von der natürlichen Variation unterscheiden.

All jene, die uns ob des Kohlenstoff-Verbrechens anklagen wollen, haben daher ein anderes Verfahren entwickelt – das Globale Zirkulations-Modell. Hierbei handelt es sich um eine Repräsentation der Atmosphäre, welche die Bedingungen innerhalb einer Schicht der Atmosphäre berechnet, typischerweise 5 km X 5 km X 1 km. Jede Schicht wird mit einer benachbarten Schicht in Beziehung gesetzt (falls man über ausreichend Computerleistung verfügt – wenn nicht, müssen die Schichten dicker sein).

Die Modellierer lassen ihre Berechnungen typischerweise einige Jahre in der Vergangenheit beginnen, in denen das Klima bekannt ist. Dann versuchen sie, damit das (bekannte) Klima zu prophezeien vom Startzeitpunkt bis heute. Es gibt viele adjustierbare Parameter in den Modellen, und dreht man an diesen nur ausreichend herum, kann man das Modell an die Historie „anpassen“.

Scheint das Modell erst einmal historische Daten gut genug reproduzieren zu können, wird es auf die Zukunft losgelassen. Dabei schwingt die Hoffnung, dass – selbst wenn die Modelle nicht perfekt sind – eine vernünftige Bandbreite von Prophezeiungen herauskommen wird, falls verschiedene Personen unterschiedliche Frisierungen zu unterschiedlichen Zeiten anbringen. Aus dieser Bandbreite könnte man vielleicht ein paar Hinweise auf die Zukunft gewinnen.

Unglücklicherweise wurden diese Hoffnungen nur zu oft immer wieder enttäuscht. Das El Nino-Phänomen ist ziemlich gut bekannt, es hat eine bedeutende Auswirkung auf das globale Klima – und dennoch ist kein einziges der Modelle in der Lage, dieses zu berücksichtigen. Genauso können die Modelle auch nicht Hurrikane abbilden – der Scale 5 km X 5 km ist einfach zu grob. Sie können lokale Klimate nicht abbilden – eine Stichprobe von zwei Gebieten, die nur etwa 5 km auseinander liegen und von denen es in dem einen Gebiet jährlich 2000 mm Regen gibt, in dem anderen aber nur um 250 mm scheiterte kläglich. Gut wurden die Wind- und Temperaturdaten sowie die lokale Topographie abgebildet. Man hatte mit einem sehr engen Netz gearbeitet, aber da gab es nicht ausreichend Regelknöpfe, um dieses Modell mit der Historie in Einklang zu bringen.

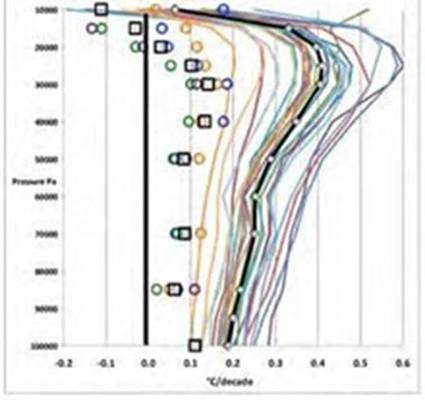

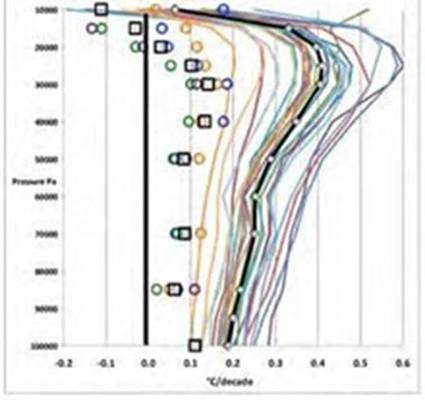

Sogar die in diesen Modellen angewandten Grundlagen der Physik scheitern. Die grundlegende Physik prophezeit, dass sich die obere Atmosphäre zwischen den beiden Wendekreisen schneller erwärmen sollte als die Oberfläche. Regelmäßig steigen Wetterballone mit Thermometern in diesem Gebiet auf. Es gibt drei separate Ballon-Datensätze, und sie alle stimmen darin überein, dass es keinerlei Anzeichen einer zusätzlichen Erwärmung gibt:

[Die Graphik erscheint auch im Original so unscharf. Anm. d. Übers.]

Die schwarzen Quadrate zeigen das Mittel der drei Datensätze. Die Höhe wird in Druckeinheiten angegeben; 100.000 Pascal am Boden und 20.000 Pascal in einer Höhe von etwa 9 km. Es gibt 22 verschiedene Modelle, und deren Mittel zeigt die schwarze Linie. Am Boden zeigt die Messung eine Erwärmung um 0,1°C pro Jahrzehnt, aber die Modelle prophezeien 0,2°C pro Jahrzehnt. In 9 km Höhe zeigen die Messungen immer noch eine Erwärmung um 0,1°C, die Modelle jedoch im Mittel 0,4°C, in Extremfällen bis 0,6°C. Modelle,die um einen Faktor 4 oder mehr falsch sind, können nicht als wissenschaftlich bezeichnet werden. Sie sollten nicht einmal zur Veröffentlichung angenommen werden – sie sind falsch.

Die Hypothese, dass wir auf der Grundlage von Modellen, die sich schon jetzt als falsch herausgestellt haben, das zukünftige Klima vorhersagen können, ist falsch. Internationale Abkommen, den zukünftigen Temperaturanstieg auf X°C über das vorindustrielle Niveau begrenzen zu können, hat mehr mit des Kaisers neuen Kleidern zu tun als mit Realität.

Der dritte Schritt zu unserem Verständnis der Klima-Zeitverschwendung kann also nur lauten, ja, die Welt erwärmt sich, aber um wie viel und warum – davon haben wir keine Ahnung.

Wie könnten die Klimaauswirkungen einer wärmeren Welt aussehen? Was ist „Klima“? Es ist das Ergebnis der Mittelung einer klimatologischen Variable wie etwa Regenmenge oder Luftdruck, gemessen typischerweise einen Monat oder eine Jahreszeit lang, woraus dann über viele Jahre hinweg ein Mittel gebildet wird, als ob man einen Hinweis auf das Wetter bekommen würde, das man in einem Monat oder während der nächsten Jahreszeit erwarten kann.

Zweitens, wir müssen die Bedeutung von „Änderung“ verstehen. In diesem Zusammenhang bedeutet Änderung eindeutig, dass der Mittelwert einer klimatologischen Variable über X Jahre von dem Mittelwert der gleichen Variable über einen anderen Zeitraum von X Jahren abweicht. Aber schon jetzt ist offensichtlich, dass sich das Wetter von Jahr zu Jahr ändert, weshalb es eine natürliche Variation des Klimas von einem Zeitraum von X Jahren zu einem anderen Zeitraum von X Jahren gibt. Daher muss man wissen, wie groß X sein muss, um die natürliche Variabilität zu berechnen und damit zuverlässig irgendwelche Änderungen des gemessenen Klimas zu entdecken.

Dieser Aspekt von „Klimawandel“ scheint in der gesamten bisherigen Debatte übersehen worden zu sein. Man scheint anzunehmen, dass es ein „präindustrielles“ Klima gab, welches man viele Jahre lang messtechnisch erfasst hatte, bevor die Industrie ein wesentlicher Faktor unserer Existenz geworden ist und dass sich das Klima, das wir heute messen, statistisch von jenem hypothetischen Klima unterscheidet.

Das Problem dabei ist natürlich, dass es nur sehr wenige tatsächliche Daten aus jenen präindustriellen Tagen gibt, so dass wir nichts in der Hand haben, um zu erkennen, wie das Klima damals wirklich war. Es gibt keine Grundlinie, von der aus wir eine Änderung messen können.

Angesichts dieser Schwierigkeit haben die Protagonisten des Klimawandels die Hypothese modifiziert. Es wird jetzt kolportiert, dass die beobachtete Erwärmung der Erde das Klima dergestalt ändern wird, dass Extremwetterereignisse immer öfter auftreten. Dies beseitigt die Schwierigkeit jedoch nicht, sondern verschlimmert sie noch.

Zur Illustration nehme man an, dass ein Extremereignis eines ist, dass außerhalb der 95%-Wahrscheinlichkeits-Bandbreite liegt. Also würde man im Verlauf von 100 Jahren im Mittel 5 solcher Extremereignisse erwarten. Anstatt dass man 100 Jahre mit Daten heranzieht, um das mittlere Klima zu ermitteln, gibt es jetzt nur fünf Jahre, um eine mittlere Schätzung des Extremereignisses zu erhalten, und der relative Fehler bei der Mittelung von 5 variablen Ereignissen ist offensichtlich viel größer als der relative Fehler bei der Mittelung von 100 variablen Ereignissen.

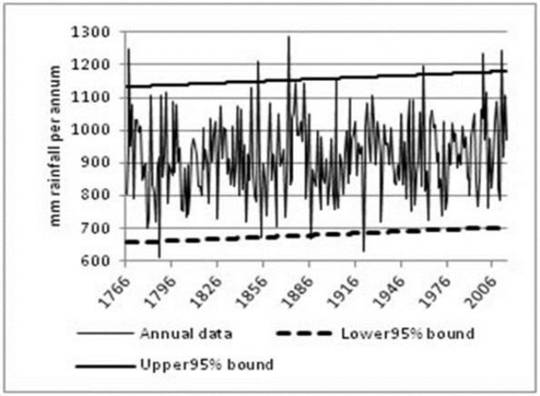

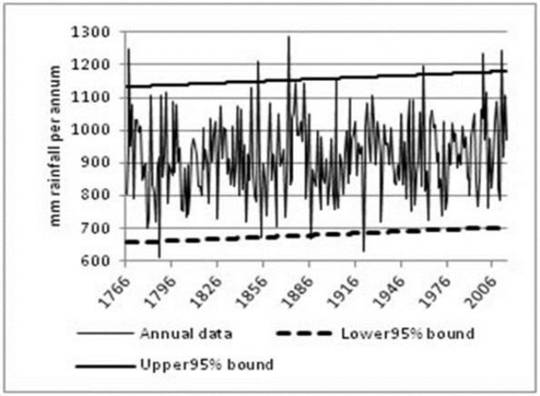

Die Daten der Regenmenge von England und Wales zeigen dies ziemlich überzeugend:

Die trendbereinigten Daten sind eng um die Normale verteilt, so dass es sinnvoll ist, hierfür die normale Statistik zu bemühen. Die 5%-Grenzen sind folglich zwei Standardabweichungen auf je einer Seite des Mittels. Im Laufe der 250-jährigen Aufzeichnung würde man 12,5 Extremereignisse erwarten (jene außerhalb der 95%-Grenze). Tatsächlich erfordert es 250 Jahre, um eine vernünftige Schätzung (innerhalb von 12%) nur bzgl. der Häufigkeit extremer Regenmengen vornehmen zu können. Es gibt keine Möglichkeit, irgendwelche Änderungen dieser Häufigkeit aufzufinden, was jedoch nötig wäre, um „Klimawandel“ zu zeigen.

Tatsächlich ist die Lebensspanne eines Menschen unzureichend, um auch nur die Häufigkeit von Extremereignissen herauszufinden. Während aufeinander folgenden 60-Jahre-Perioden gibt es 2, 4, 2 und 2 Ereignisse, ein Mittel von 2,5 Ereignissen mit einer Standardabweichung von 1,0. Es gibt eine Wahrscheinlichkeit von 95%, innerhalb von 60 Jahren zwischen 0,5 und 5,5 Ereignisse zu erleben, wo 3% (5% von 60) erwartet werden. Viele Lebensspannen sind erforderlich, um die Häufigkeit mit hinreichender Genauigkeit zu bestimmen, und noch viel mehr Lebensspannen, um irgendwelche Änderungen der Häufigkeit zu finden.

Man weiß, dass es seit mindestens 150 Jahren wärmer geworden ist. Falls die Erwärmung zu mehr Extremwetter geführt haben sollte, hätte man erwarten können, dass es einige Beweise für eine Zunahme von Extremereignissen während dieses Zeitraumes gebe. Die Main-Stream-Presse versucht uns das mit Sicherheit weiszumachen, wenn es zu einem offensichtlich heftigen Sturm kommt. Aber keiner der klimatologischen Indikatoren, von denen Daten seit mindestens 100 Jahren vorliegen, zeigt auch nur Spuren von Anzeichen einer Zunahme extremer Ereignisse.

Zum Beispiel gab es viele Behauptungen, dass tropische Zyklone an Häufigkeit und Stärke zunehmen. Die WMO berichtet: „Es bleibt unsicher, ob Änderungen der Aktivität tropischer Zyklone in der Vergangenheit über die aus natürlichen Gründen zu erwartende Variabilität hinausgeht“.

Es stimmt, dass die Schäden durch Zyklone zunehmen, aber dies liegt nicht an extremerem Wetter. Es ist die Folge einer immer stärkeren Bebauung, und jedes Bauwerk ist verwundbarer als vor 20 oder mehr Jahren. Daten aus über ein Jahrhundert wurden sorgfältig analysiert, um zu dieser Schlussfolgerung zu kommen. Der IPCC-Bericht stimmt hinsichtlich Extremereignisse damit überein.

Es ist sehr unwahrscheinlich, dass Extremwetter jedweder Art irgendeinen Teil unseres Planeten unbewohnbar macht – darunter sind Dürren, schwere Stürme und Orkane. Tatsächlich ist dies keine allzu große Überraschung – die Menschheit hat gelernt, mit Extremwetter umzugehen, und Menschen bevölkern Gebiete von den kältesten bis zu den heißesten Regionen, vom Meeresspiegel-Niveau bis in Höhen, wo man nach Luft ringen muss. Wir sind nicht nur anpassungsfähig, sondern wir haben auch gelernt, Strukturen zu schaffen, die uns vor den Kräften der Natur schützen.

Natürlich ist ein solcher Schutz nicht kostenlos zu haben. Nicht jeder kann sich die Strukturen leisten, die für ihren Schutz erforderlich sind. Dörfer werden regelmäßig von Stürmen schwer beschädigt, die in den meisten modernen Städten kaum Schäden hinterlassen würden. Flut-Kontrollmaßnahmen sind ausgelegt auf Ereignisse, die einmal während 100 Jahren auftreten, und im Allgemeinen funktionieren sie auch – während arme Länder, deren tief liegende Gebiete regelmäßig überschwemmt werden, sich dringend geeignete Schutzmaßnahmen wünschen.

Tatsächlich ist es eine Herausforderung für die Fähigkeit von Ingenieuren, Schutzmechanismen gegen alle Arten natürlicher Kräfte zu entwickeln. Beispiel: Das Erdbeben vor Japan mit der Magnitude 9 (welches den Tsunami auslöste, der die Reaktoren von Fukushima zerstörte), hat nur wenig Gebäudeschäden verursacht, während es zuvor im gleichen Jahr bei Erdbeben mit einer Magnitude von „nur“ 7 in Wellington, Neuseeland, zu schweren Gebäudeschäden gekommen war. Dabei wurde die Kathedrale von Wellington zerstört, die nicht darauf ausgelegt war, Erdbeben zu widerstehen.

Wir sollten keine Angst vor Extremwetterereignissen haben. Es gibt keinerlei Beweise, dass diese irgendwie stärker sind als in der Vergangenheit, und die meisten von uns können angemessen darauf reagieren. Natürlich werden unsere Schutzmaßnahmen irgendwann nicht ausreichen, aber normalerweise geht dies auf menschliches Versagen zurück und nicht auf exzessive Naturkräfte. Hier beim vierten Schritt unserer Reise können wir schon sehen, wie die Klimawandel-Hypothese strauchelt und zu Fall kommt.

In gleicher Weise erweisen sich die meisten der anderen Angst-Stories bzgl. „Klimawandel“ als Unsinn, wen sie mit realen Daten getestet werden. Die Eisbären verschwinden nicht von der Erde: tatsächlich kann die International Union for the Conservation of Nature während der letzten 400 Jahre keine Änderung der Verlustrate von Spezies erkennen. Die Temperatur war niemals ein starker Indikator für die Ausbreitung von Malaria – das Fehlen entsprechender Maßnahmen bzgl. der menschlichen Gesundheit ist hierbei eine kritische Komponente. Spezies wandern, aber ob die Temperatur dafür der Treiber ist, ist zweifelhaft – angesichts täglicher und jahreszeitlicher großer Temperaturänderungen ist es sehr unwahrscheinlich, dass eine kleine Änderung der Mitteltemperatur dafür die Ursache ist. Gletscher schmelzen, aber die Welt ist wärmer, so dass dies nicht unerwartet kommt.

Eine letzte Frage bleibt übrig: Wird der Meeresspiegel steigen und unsere Küstengebiete verschlucken?

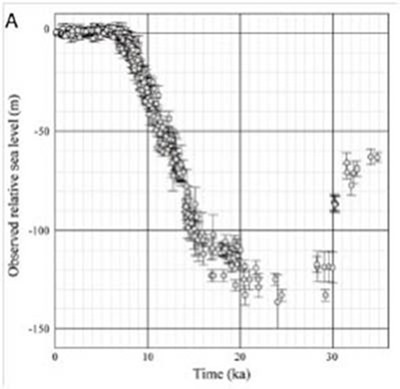

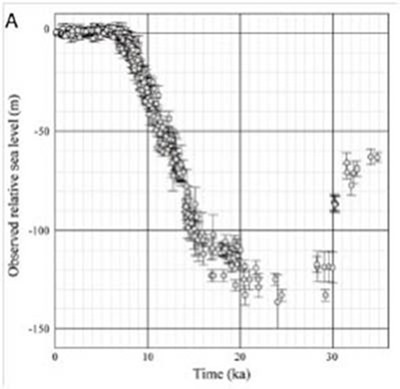

Zunächst muss man erkennen, dass der Meeresspiegel steigt. Das hat er schon während der letzten 25.000 Jahre getan. Allerdings ist er während der letzten 7 Jahrtausende langsamer gestiegen als jemals zuvor:

Die kritische Frage lautet, ob die beobachtete geringe Anstiegsrate als Folge eines sich erwärmenden Klimas zugenommen hat. Es gibt viele Beweise dafür, dass dies nicht der Fall ist. Einer davon sind langzeitliche Daten von Tiden-Messstationen. Sie müssen mit Vorsicht behandelt werden, weil es Gebiete gibt, in denen sich das Land absenkt (wie der Golf von Mexiko, wo der vom Mississippi herangeschwemmte Schlamm schwer auf der Kruste liegt), während sich andere Gebiete heben (wie der größte Teil von Skandinavien, wo die Last eines viele tausend Meter dicken Eispanzers vor 10.000 Jahren verschwunden ist). Eine typische langzeitliche Tiden-Messreihe gibt es aus New York:

Der Trend von 1860 bis 1950 betrug 2,47 bis 3,17 mm pro Jahr; der Trend im Zeitraum 1950 bis 2014 2,80 bis 3,42 mm pro Jahr – beide mit einem 95%-Vertrauensniveau. Die Wahrscheinlichkeit, dass sich nach 1950 eine Beschleunigung zeigt,liegt unter 5%.

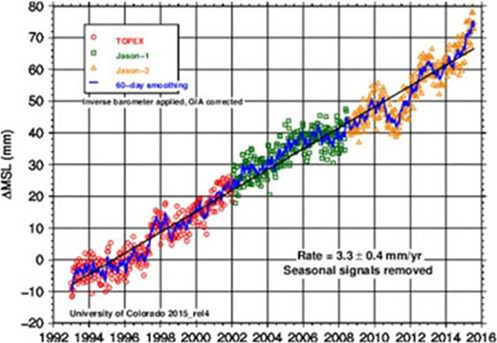

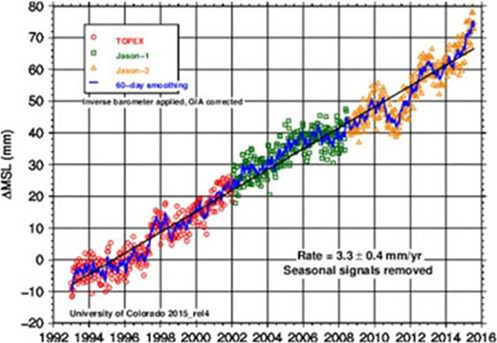

Ein weiterer Beweis kommt von den Satellitenmessungen des Meeresspiegels. Die folgende Abbildung zeigt die jüngsten verfügbaren Satelliten-Informationen – sie reichen aber nur bis zum Jahr 1993 zurück. Nichtsdestotrotz ist der Anstieg von 3,3 ± 0,3 mm pro Jahr vollkommen konsistent mit den Tidenmessungen:

Folglich weisen viele Beweislinien auf die gegenwärtige Rate des Anstiegs hin, die etwa 3 mm pro Jahr oder 30 cm pro Jahrhundert beträgt. Unsere bestehenden Schutzmaßnahmen gegen das Meer müssen mit täglichen Änderungen von vielen Metern fertig werden, und Sturmfluten mit einigen weiteren Metern. Die mittlere Höhe unseres Schutzes ist bis etwa 7 m über dem Meeresspiegel ausgelegt, so dass zusätzliche 0,3 m bis zum Ende dieses Jahrhunderts die Anzahl der Wellen etwas erhöhen wird, die über die Barrieren schwappen.

Das IPCC prophezeit, dass der Meeresspiegel in diesem Jahrhundert um 0,4 bis 0,7 m steigen wird. Angesichts der großen Bandbreite dieser Prophezeiung besteht die Möglichkeit, dass es recht hat. Wichtig ist jedoch, dass nicht einmal ein Anstieg um 0,7 m eine Katastrophe wäre, und zwar angesichts der Tatsache, dass unsere Schutzmaßnahmen schon jetzt meterhoch sind – sie um weitere 10% zu erhöhen während der nächsten 80 Jahre wäre kostspielig, aber wir hätten Jahrzehnte Zeit, diese Änderung vorzunehmen. Bis dahin sollte es mehr als hinreichend Warnungen geben, falls wirklich ein signifikanter Anstieg des Meeresspiegels erfolgt.

Unter dem Strich: Unsere fünf Schritte haben gezeigt:

● Die Verbrennung weiter zunehmender Mengen fossiler Treibstoffe hat die CO2-Konzentration in der Atmosphäre zunehmen lassen.

● Die physischen Auswirkungen dieser Zunahme sind auf keine wissenschaftliche Weise nachweisbar. Es mag eine gewissen Erwärmung der Atmosphäre gegeben haben, aber gegenwärtig liegt jedwede Erwärmung fast mit Sicherheit innerhalb der natürlichen Variation der Temperatur.

● Es gibt keine Beweise, weder für irgendeine Zunahme der Häufigkeit oder Magnitude von Wetterphänomenen noch für klimabezogene Änderungen der Biosphäre.

● Es ist unwahrscheinlich, dass jedweder Anstieg des Meeresspiegels in diesem Jahrhundert eine unüberwindbare Herausforderung ist.

Versuche, die globale Temperatur durch die Kontrolle von CO2-Emissionen zu beeinflussen, sind wahrscheinlich ebenso unnütz wie wirtschaftlich katastrophal.

Link: http://wattsupwiththat.com/2016/04/08/five-points-about-climate-change/

Übersetzt von Chris Frey EIKE