Ist es nicht endlich an der Zeit, den Irrsinn der Verschwendung von Zeit und Geld für mehr Klimamodelle zu stoppen?

Kurz-, mittel- und langfristige Klimavorhersagen sind über 50% der Zeit falsch, so dass eine richtige Vorhersage nicht besser ist als ein Zufallsereignis. Globale und regionale Vorhersagen sind oftmals genauso falsch. Falls es ein Klimamodell geben würde, dessen Vorhersagen zu 60% zutreffend sind, würde jedermann dieses benutzen. Da es aber keine einzige genaue Klimavorhersage gibt, geht das IPCC dazu über, alle Modellvorhersagen zu mitteln, als ob sich die Fehler dadurch irgendwie gegenseitig aufheben würden und das Mittel der Vorhersagen repräsentativ wäre. Klimamodelle und deren Vorhersagen haben eklatante Schwächen, die in anderen Unternehmungen ihre sofortige Aussortierung zur Folge hätte. Es sei denn, natürlich, dass es sich um ein von der Regierung finanziertes Fiasko handelt. Tägliche Wettervorhersagen sind seit der Entwicklung moderner Vorhersagemethoden seit dem 1. Weltkrieg immer besser geworden. Dagegen scheinen allerdings selbst kurzfristige Klimavorhersagen nicht besser zu sein als der Old Farmers Almanac aus dem Jahr 1792, bei dem als Vorhersagegrundlage Mond, Sonne und andere astronomische und terrestrische Indikatoren herangezogen worden waren.

Ich habe viel gesagt und geschrieben über die Schlüsselrolle von Modellen bei der Erzeugung und Fortführung der Katastrophen-AGW-Mythologie. Menschen waren erschrocken über die durchgesickerten E-Mails der CRU, aber die meisten wissen nicht, dass die tatsächlichen Instruktionen zum „Verstecken des Stillstands“ [hide the decline] im Anteil der Baumringe der Hockeyschläger-Graphik in den Computercode Eingang gefunden haben. Dies ist ein Grund, warum Menschen vom Akronym GIGO (Garbage in, Garbage out) sprechen, wenn von Klimamodellen die Rede ist.

Ich bin es leid, dass immer weiter so getan wird, als könnten die Klimamodelle akkurate Vorhersagen in einem chaotischen System erzeugen. Die Wirklichkeit ist, dass die Modelle nicht funktionieren und nicht funktionieren können, und zwar aus vielen Gründen einschließlich sehr fundamentaler: Fehlende Daten, fehlendes Wissen der wesentlichen Mechanismen, fehlendes Wissen über grundlegende physikalische Prozesse, fehlende Fähigkeit, physikalische Phänomene wie Turbulenz in mathematischer Form präsentieren zu können und fehlende Computer-Kapazität. Bob Tisdale hat die Probleme in seinem 2013 erschienenen Buch Climate Models Fail zusammengefasst. Es ist an der Zeit aufzuhören, weiterhin Geld und Zeit zu verschwenden und Menschen und Computer wichtigeren Dingen zu widmen.

Das Einzige, was die Leute weiter an den Modellen arbeiten lässt, sind finanzielle Zuwendungen der Regierung, entweder an Wetterbüros oder an Akademien. Ohne diese Finanzierung würden die Computermodellierer nicht das Studium des Klimas dominieren. Ohne diese Finanzierung könnte das IPCC nicht existieren. Viele in die Klimamodellierung involvierte Personen kennen sich in Klimatologie oder Klimawissenschaft nicht aus bzw. haben keinerlei Erfahrung damit. Sie waren Absolventen von Programmen zur Modellierung mittels Computer auf der Suche nach einer herausfordernden Gelegenheit, Zugang zu großen Computern zu haben und exzessiv bezahlt zu werden. Die Atmosphäre und später auch die Ozeane boten diese Gelegenheiten. Jetzt werden beide Bereiche zusammengeschustert, um das Fiasko fortzusetzen. Unglücklicherweise ist all dies für die Gesellschaft extrem teuer. Jene Ausgaben enthalten Kosten für die Computer und die Modellierungszeit, aber viel schlimmer ist, dass die falschen Ergebnisse im globalen Energie- und Umweltbereich angewendet werden.

Hört auf mit dem Theater sowie Geld und Zeit zu verschwenden! Streicht die Finanzierung, und niemand würde privates Geld für die Arbeit an Klimavorhersage-Modellen ausgeben!

Gewöhnlich argumentiere ich, dass es ein wenig bringen könnte, im Labor mit Klimamodellen zu spielen, mit wissenschaftlicher Verantwortung hinsichtlich Genauigkeit, Durchführbarkeit und Anwendbarkeit. Es ist eindeutig, dass sie diesen Verantwortlichkeiten nicht genügen. Jetzt erkenne ich, dass diese Haltung falsch ist. Wenn Modellergebnisse als die einzige Basis für Regierungspolitik herhalten muss, haben sie keinerlei Wert. Sie sind ein massiver Kostenfaktor und ein großer Schaden für die Gesellschaft, aber genau das zu tun war der Auftrag an das IPCC.

Das IPCC hat einen kleinen Wert. Es illustriert all die Probleme, die in vorherigen Kommentaren angesprochen worden waren. Im Labor erzeugte Klimamodelle werden manipuliert sogar weit über wissenschaftliche Präzision hinaus in regierungsamtlichen Wetterämtern oder Akademien. Dann werden sie zur Grundlage öffentlicher Politik in Gestalt der Summary for Policymakers SPM.

Ein weiterer Wert der IPCC-Berichte ist, dass sie eine detaillierte Auflistung der Gründe bieten, warum die Modelle nicht funktionieren und nicht funktionieren können. Zu blöde, dass nur Wenige diese Berichte lesen oder verstehen. Falls das der Fall wäre, würden sie erkennen, dass die Grenzen so hoch liegen, dass sie jede Erfolgschance zunichte machen. Nur eine einzige Teiluntersuchung illustriert diesen Punkt.

Daten

Die IPCC-Mitarbeiter wussten von Anfang an um die Grenzen der Daten, doch hat sie dies nicht daran gehindert, Modelle zu konstruieren.

Im Jahre 1993 hat Stephen Schneider, an einer der vordersten Plätze der AGW-Hypothese stehend, hinsichtlich des Gebrauchs von Klimamodellen gesagt:

„Ungewissheit über wichtige Rückkopplungs-Mechanismen sind ein Grund, warum das ultimative Ziel der Klimamodellierung, also die zuverlässige Vorhersage der Zukunft grundlegender Variablen wie Temperatur und Niederschlagsmenge, nicht realisierbar ist“.

In einem Bericht des US National Research Council vom 3. Februar 1999 heißt es:

Defizite hinsichtlich Genauigkeit, Qualität und Kontinuität der Aufzeichnungen stellen ernste Begrenzungen hinsichtlich des Vertrauens dar, das man den Forschungsergebnissen entgegen bringen kann.

Darauf erwiderte Kevin Trenberth:

Es ist sehr eindeutig, dass wir kein Klima-Beobachtungssystem haben … dies könnte für Viele ein Schock sein, die davon ausgehen, dass wir genau wissen, was mit dem Klima passiert, aber wir wissen es nicht.

Zwei Direktoren der CRU, Tom Wigley und Phil Jones, sagten:

Viele Unsicherheiten bzgl. der Gründe des Klimawandels werden niemals gelöst werden können, weil die dafür notwendigen Daten fehlen.

70% der Welt werden von Ozeanen überdeckt, von denen es praktisch keine Messungen gibt. Die Pole sind von grundlegender Bedeutung hinsichtlich der Dynamik des atmosphärischen Antriebs und des Klimas, und dennoch gibt es im 15 Millionen km² großen Gebiet des Arktischen Ozeans oder dem 14 Millionen km² großen antarktischen Kontinent praktisch keine Messstationen. Von etwa 85% der Erdoberfläche liegen keine Wetterdaten vor. Das IPCC räumt diese Begrenzungen ein und behauptet, dass die Daten einer einzelnen Station repräsentativ sind für die Bedingungen in einem Umkreis mit einem Radius von 1200 km. Ist das eine zulässige Annahme? Ich glaube nicht.

Aber es sind nicht nur die fehlenden Daten von der Erdoberfläche. Tatsächlich fehlen nicht nur die Daten von der Oberfläche, sondern auch aus diversen Höhenschichten über der Oberfläche zwischen 1,25 und 2 m. Und wie Forscher (Climate Near the Ground) zeigen, unterscheiden sich diese Höhenschichten markant von tatsächlichen Oberflächen-Temperaturen, wie sie an den wenigen Mikroklima-Stationen gemessen werden, die es gibt. Angeblich sind die US-Stationen die besten, aber wie Anthony Watts akribische Studie zeigt, messen lediglich 7,9% dieser Stationen mit einer Genauigkeit von weniger als 1°C (Abbildung 1). Ins Verhältnis gesetzt: im IPCC-Bericht aus dem Jahr 2001 behauptet Jones, dass die Zunahme um 0,6°C über 120 Jahre jenseits einer natürlichen Zunahme liege. Dies unterstreicht auch die Tatsache, dass die meisten der instrumentell gemessenen Temperaturen auf 0,5°C genau gemessen worden sind.

Bei anderen grundlegenden Daten einschließlich Niederschlag, Luftdruck, Windgeschwindigkeit und -richtung sieht es noch schlechter aus als bei den Temperaturdaten. Zum Beispiel gibt es in Afrika nur 1152 Wetterbeobachtungsstationen, welche ein Achtel der von der WMO geforderten minimalen Dichte ausmachen. Wie ich bereits in einem früheren Beitrag betont habe, reichen fehlende Daten für alle Aggregatzustände von Wasser (hier) allein aus, um das Scheitern der IPCC-Projektionen zu garantieren.

Die Modelle versuchen, eine dreidimensionale Atmosphäre zu simulieren, aber es gibt über der Oberfläche praktisch keine Daten. Die Modellierer glauben, dass wir dumm genug sind zu glauben, dass mehr Ebenen in den Modellen dieses Problem lösen, aber falls man keine Daten hat, spielt die Anzahl der Ebenen keine Rolle.

Wesentliche Mechanismen

Während meiner Laufbahn als Klimatologe wurden viele Phänomene von Wetter und Klima entweder gefunden oder gemessen, angeblich mit hinreichender Genauigkeit, um Eingang in ein Modell zu finden. Unter diesen Phänomenen sind ENSO, Pacific Decadal Oscillation (PDO), the Atlantic Multidecadal Oscillation (AMO), the Antarctic Oscillation (AAO), the North Atlantic Oscillation (NAO), Dansgaard-Oeschger Oscillation (D-O), Madden-Julian Oscillation (MJO), Indian Ocean Dipole (IOD) und andere.

Abgesehen davon wissen wir immer noch wenig über Phänomene, die mit der Hadley-Zelle und der Innertropischen Konvergenzzone ITC zusammenhängen, welche im Wesentlichen die gesamten tropischen Klima-Mechanismen sind. Der Milankovitch-Effekt bleibt umstritten und geht nicht in die IPCC-Modelle ein. Die Theorie kosmischer Strahlen scheint eine Antwort zu geben auf die Beziehung zwischen Sonnenflecken, globaler Temperatur und Niederschlag, aber auch diese wird gleichermaßen vom IPCC ignoriert. Auch das Phänomen Monsun wird kaum berücksichtigt, wenn es heißt:

Kurz gesagt, die meisten AOGCM-Modelle simulieren nicht genau die räumliche oder jahreszeitliche Variation der Monsun-Niederschläge.

Es gibt nur sehr begrenzt Wissen über die großen ozeanischen Zirkulationen an der Oberfläche und in den Tiefen. Es gibt praktisch keine Messungen des transferierten Wärmevolumens oder wie sich dieses mit der Zeit ändert, einschließlich Messungen der geothermischen Wärme.

Das IPCC räumt ein, dass:

wir bei der Klimaforschung und -modellierung erkennen sollten, dass wir es mit einem gekoppelten, nicht linearen chaotischen System zu tun haben, und dass daher die langfristige Vorhersage zukünftiger Klimazustände nicht möglich ist.

Dieser Kommentar reicht schon aus, um mit dem Verschwenden von Zeit und Geld aufzuhören. Man füge das zweite und damit verbundene Problem hinzu, das von Essex und McKitrick in dem Beitrag Taken By Storm identifiziert worden ist, und man findet dick unterstrichen aufzuhören.

Klimaforschung ist alles andere als eine routinemäßige Anwendung klassischer Theorien wie Strömungslehre, obwohl manch einer versucht sein könnte, genau das zu glauben. Es muss in der „exotischen“ Kategorie wissenschaftlicher Probleme betrachtet werden, teilweise weil wir versuchen, eine wissenschaftlich bedeutende Struktur zu finden, die niemand sehen kann oder jemals gesehen worden ist und die vielleicht nicht einmal existiert.

In dieser Hinsicht muss man unabdingbar im Hinterkopf behalten, dass es keine Experimentier-Anordnung für das globale Klima gibt, so dass alles, was wir haben, jene ersten Prinzipien sind. Man kann alle Messungen heranziehen, die man heute will; man kann Terabyte Plattenspeicher füllen, falls man will, aber das kann nicht als experimenteller Apparat dienen. Apparate können kontrolliert werden, und deren Betreiber können Messungen eigener Variablen durchführen über eine Bandbreite kontrollierter, physikalisch relevanter Bedingungen. Im Gegensatz dazu haben wir nur das heutige Klima als direkte Stichprobe, vorausgesetzt wir sind klug genug, sogar zu wissen wie man streuende Daten auf physikalisch bedeutsame Weise mitteln kann, um das Klima zu repräsentieren. Kurz gesagt, das globale Klima ist durch keinerlei konventionelle Mittel zu erfassen.

Computer-Kapazität

Modellierer behaupten, dass die Computer immer besser werden und dass alles, was sie brauchen, größere und schnellere Computer wären. Das macht mit Sicherheit keinen Unterschied, und die Geldverschwendung geht weiter. Im Jahre 2012 stellte Cray den Supercomputer mit der Bezeichnung Gaea vor (Abbildung 2). Er hat eine Kapazität von 1,1 Petaflops. Die Abkürzung FLOP bedeutet Floating-Point Operations per Second, und Peta sind um 1000 Millionen Floating-Point Operations per Second. Jagadish Shukla sagt, die Herausforderung bestehe darin,

dass wir in der Lage sein müssen, Klimamodelle mit der gleichen Auflösung laufen zu lassen wie die Wettervorhersagemodelle, die während der nächsten 5 Jahre eine horizontale Auflösung von 3 bis 5 km erreichen können. Dies wird Computer mit einer Spitzenfähigkeit von etwa 100 Petaflops erfordern.

Unabhängig von der Computer-Kapazität ist das alles bedeutungslos, wenn die Daten für das Modell fehlen.

Abbildung 2: Der Gaea-Computer von Cray mit dem umweltlichen Image.

Gescheiterte Vorhersagen (Prophezeiungen, Projektionen)

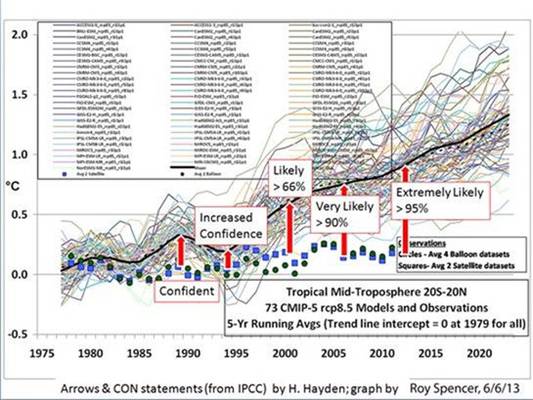

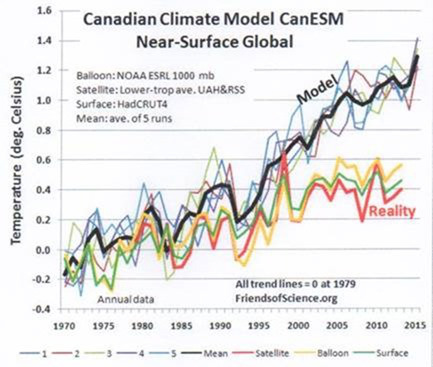

Abbildung 3 zeigt die gescheiterte Vorhersage des IPCC. Dort wird so etwas Projektion genannt, aber die Öffentlichkeit glaubt, dass es Vorhersagen sind. Wie auch immer, sie sind konsistent falsch. Man beachte die Beschriftungen, die Haydens Graphik aus der Summary for Policymakers SPM hinzugefügt worden sind. Während die Fehlerbandbreite bei den aktuellen Daten immer größer wird, behauptet die Summary stur, dass sie sich verbessern. Eines der vom IPCC herangezogenen Computermodelle gehört Environment Canada. Dessen Prophezeiungen sind die schlechtesten von all jenen, die für die Mittelung der Ergebnisse durch das IPCC Eingang fanden (Abbildung 4).

Abbildung 3

Abbildung 4. Quelle: Ken Gregory

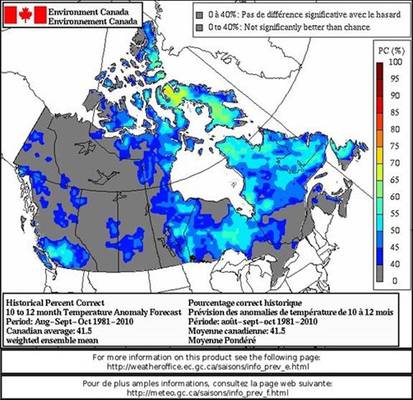

Das kanadische Desaster ist keine Überraschung, wie deren Abschätzung der Vorhersageleistung über ein Jahr zeigt. Sie machen eine Vorhersage über ein Jahr und bieten eine Karte an, die die Verteilung der Eintreff-Genauigkeit in Prozent zeigt, verglichen mit dem Mittel des Zeitraumes 1981 bis 2010 (Abbildung 5).

Abbildung 5

Die kanadische mittlere prozentuale Genauigkeitsverteilung ist unten links mit 41,5 Prozent angegeben. Das ist das beste, was sie erreichen konnten nach etwa dreißig Jahren Modellentwicklung. Ergebnisse in anderen Ländern sind auch nicht besser.

In einem Bericht im New Scientist sagte Tim Palmer, ein führender Klimamodellierer am EZMW in Reading:

Ich möchte das IPCC nicht unterminieren, aber die Vorhersagen, vor allem für regionale Klimaänderungen, sind in großem Umfang unsicher.

Die Kosten

Joanna Nova hat die umfangreichsten Forschungen hinsichtlich der Kosten der Klimaforschung durchgeführt, die der US-Regierung entstehen (hier):

Insgesamt wird die US-Regierung während der letzten 20 Jahre bis zum Ende des Finanzjahres 2009 32 Milliarden Dollar für die Klimaforschung ausgegeben haben – und weitere 36 Milliarden Dollar für die Entwicklung klimabezogener Technologien. Das sind tatsächliche Dollars, ersichtlich aus Berichten der Regierung, und nicht inflationsbereinigt. Finanzielle Zuwendungen anderer Regierungen sind nicht berücksichtigt. Die wirkliche Summe kann nur weiter steigen.

Es gibt keinen Zweifel daran, dass diese Summe wuchs, und die Welt als Ganzes wird wahrscheinlich die US-Ausgaben verdoppeln, wie dieser Kommentator behauptet:

Allerdings kann ich mindestens eine zuverlässige halbe Milliarde Pfund zu Joanne Novas 79 Milliarden-Dollar-Rechnung hinzufügen – plus: wir wissen jetzt schon, dass das Framework 7-Programm der EU 1,9 Milliarden Euro für die direkte Klimaforschung enthält. Framework 6 beläuft sich auf 769 Millionen Euro. Falls man alle Anhang-1-Länder zusammenfasst, muss die ausgegebene Summe deutlich über 100 Milliarden liegen.

Das sind lediglich die Kosten für die Computer-Modellierung. Die ökonomischen und sozialen Kosten sind noch viel höher und praktisch unmöglich zu berechnen. Paul Driessen sagt dazu:

Wie die entsprechenden polaren Gebilde sind 90% des titanischen Eisberges der Klimaförderung für die meisten Bürger unsichtbar, Geschäftsleute und Politiker gleichermaßen.

Es ist kein Wunder, wenn Larry Bell sagen kann:

Das Government Accounting Office (GAO) der USA ist nicht in der Lage herauszufinden, welche Vorteile der Steuerzahler von den vielen Milliarden Dollars hat, die jedes Jahr für eine Politik ausgegeben werden, die angeblich dem Kampf gegen den Klimawandel gewidmet ist.

Falls es wirklich einer vermeintlich hoch entwickelten Agentur wie dem GAO der USA nicht möglich ist, die Kosten zu berechnen, dann gibt es keine Chance für eine globale Abschätzung. Es gibt kaum Zweifel daran, dass die direkten Kosten in Billionen Dollar gemessen werden. Darin sind nicht enthalten die verpassten Gelegenheiten für Entwicklung und das Leben derer in Armut zu verbessern. Und all das nur wegen der als falsch nachgewiesenen Ergebnisse von vollständig gescheiterten Computermodell-Prophezeiungen, Projektionen oder wie immer man das nennen kann.

Es ist an der Zeit, diesen Wahnsinn zu beenden, welcher in der Klimawissenschaft in der Erzeugung immer neuer Computermodelle besteht, die nicht funktionieren und nicht funktionieren können!

Jene, die Wissen haben, prophezeien nichts. Jene, die prophezeien, haben kein Wissen“. Tzu Lao im 6. Jhd. vor Christus.

Übersetzt von Chris Frey EIKE.

Anmerkung des Übersetzers: Wie bloß kann man all diese Dinge der deutschen Zipfelmütze vermitteln?!