Im Folgenden ist der

WUWT-Beitrag ins Deutsche übersetzt wiedergegeben. Er schildert die

Originalarbeit in verkürzter Form. Da die verwendeten statistischen Methoden der Originalarbeit wohl nur den wenigsten Leser(inne)n vertraut sein dürften, hat der Bearbeiter der News (Horst-Joachim Lüdecke) eine Veranschaulichung ohne Zuhilfenahme von mathematischen Formeln versucht. Sie ist als pdf angefügt. Es wäre vielleicht sinnvoll, diese Veranschaulichung zuerst zu lesen, um der folgenden Übersetzung verständlich besser folgen zu können. Nun zur Übersetzung des Artikels von WUWT, die von Helmut Jäger vorgenommen wurde:

In der Fachzeitschrift

“…Obgleich die anthropogenen Antriebe einen gemeinsamen stochastischen Trend haben, zeigen wir, dass dieser Trend empirisch unabhängig vom stochastischen Trend bei den Zeitreihen der Temperatur und der Sonneneinstrahlung ist. Deshalb weisen Treibhausgas-Antrieb, Aerosole, Sonneneinstrahlung keine polynomiale Kointegration mit der globalen Temperatur auf. Das bedeutet, dass die jüngste globale Erwärmung nicht statistisch signifikant auf einen anthropogenen Antrieb bezogen ist. Aber wir meinen auch, dass ein Antrieb durch Treibhausgase einen zeitweiligen Effekt auf die globale Temperatur gehabt haben könnte.”

Das Papier ist hochinteressant und möglicherweise ein Donnerschlag, weil die Verfasser wirklich alle einschlägigen Zeitreihen von Beobachtungsdaten (einschließlich GISS und BEST) benutzten, zusammen mit der Sonneneinstrahlung nach Lean und Rind, dazu CO2, CH4, N2O, Aerosole, ja sogar Wasserdampfdaten. Und sie haben [die Daten] statistischen Tests gegen die Antriebsgleichungen unterzogen (dabei auch Lucias bevorzugter Einheitswurzel). Erstaunlicherweise scheinen sie bei den Beobachtungsdaten einen anthropogenen Antrieb fast gänzlich auszuschließen, dies aber mit der Einschränkung, dass Irrtum möglich sei, wörtlich:

“…unsere Zurückweisung eines anthropogenen Klimawandels ist nicht absolut; es könnte ein „falsch positiv“ sein, aber wir können die Möglichkeit nicht ausschließen, dass die jüngste globale Erwärmung einen anthropogenen Stempel trägt. Diese Möglichkeit ist aber sehr klein und sie ist auf konventionellem Level nicht statistisch signifikant.“

Ich erwarte, dass Menschen wie Tamino (auch unter dem Namen Grant Foster bekannt) und weitere hitzköpfige Statistik-Besessene zum Angriff übergehen werden und die Prämissen und Tests in Frage stellen, aber gleichzeitig hoffe ich, dass sich auch weniger vorurteilsbefangene Statistiker engagieren und die Stichhaltigkeit prüfen. Ich habe die Vermutung, dass die Autoren von BEE sorgfältig darauf achteten, alle Möglichkeiten eigener Irrtümer auszuschließen. Ich schulde Dank an Andre Bijkerk und Joanna Ballard, die mich über Facebook auf dieses Papier aufmerksam machten.

Der Abstract und Auszüge aus dem Paper mit folgenden Autoren folgen.

M. Beenstock(1), Y. Reingewertz(2), and N. Paldor(3): Polynomial cointegration tests of anthropogenic impact on global warming, Earth Syst. Dynam., 3, 173-188, 2012

(1) Department of Economics, the Hebrew University of Jerusalem, Mount Scopus Campus, Jerusalem, Israel

(2) Fredy and Nadine Institute of Earth Sciences, the Hebrew University of Jerusalem, Edmond J. Safra campus, Givat Ram, Jerusalem, Israel

Abstract

Wir wenden statistische Methoden auf instationäre Zeitreihen an, um die Erklärungshypothese vom anthropogen verursachten Klimawandel (AGW) zu testen, wonach eine Zunahme der atmosphärischen Treibhausgaskonzentration die Globaltemperatur im 20. Jh. erhöht hätte. Im Besonderen benutzen wir das Verfahren der polynomialen Kointegration, um einen möglicherweise anthropogenen Klimawandel im Beobachtungszeitraum (1880–2007) zu testen. Die Globaltemperatur und die Sonneneinstrahlung sind stationär beim ersten Differenzieren, wohingegen die Treibhausgas- und Aerosol-Antriebe erst beim zweiten Differenzieren stationär sind. Wir zeigen, dass dieser Trend empirisch unabhängig vom stochastischen Trend bei der Temperatur und Sonneneinstrahlung ist, obwohl die anthropogenen Antriebe einen gemeinsamen stochastischen Trend aufweisen. Daher sind Treibhausgas-Antrieb, Aerosole, Sonneneinstrahlung und Globaltemperatur nicht polynomial kointegriert.

Das impliziert, dass die jüngste globale Erwärmung nicht statistisch signifikant auf einen anthropogenen Antrieb bezogen ist. Andererseits haben wir aber herausgefunden, dass ein Treibhausgas-Antrieb einen zeitlich begrenzten Effekt auf die Globaltemperatur gehabt haben könnte.

Einführung

Angesichts der Komplexität und der Verschiedenartigkeit der Prozesse, die das Erdklima beeinflussen, ist nicht überraschend, dass eine völlig zufriedenstellende und akzeptierte Erklärung (IPCC, AR4, 2007) für alle Veränderungen noch fehlt, die im vergangenen Jahrhundert stattgefunden haben (z.B. Temperaturänderungen im großen Gebiet der Tropen, Bilanz des CO2-Eintrags in die Atmosphäre, Änderungen in der Aerosol-Konzentration, Ausmaß und Veränderung der Sonnenstrahlung). Diese Studie beschäftigt sich insbesondere mit denjenigen Prozessen, die mit dem Treibhauseffekt zu tun haben, durch den ein Teil der von der Erde abgestrahlten langwelligen Emission von einigen Molekülen der Atmosphäre wieder absorbiert wird. Diese sind (in absteigender Wichtigkeit): Wasserdampf, Kohlendioxid, Methan und Stickoxide (IPCC, 2007). Obwohl Wasserdampf das wichtigste Treibhausgas ist, wird die Dynamik von dessen atmosphärischem Austausch durch Verdampfung, Kondensierung mit nachfolgendem Niederschlag noch nicht genügend verstanden, um gerade ihn exakt zu quantifizieren. Während sehr viel Ursachenforschung zur globalen Erwärmung unter Einsatz von kalibrierten allgemeinen Zirkulationsmodellen (calibrated general circulation models – GCMs) durchgeführt wird, hat sich seit 1997 ein neuer Zweig wissenschaftlicher Untersuchung entwickelt, in dem die Beobachtungen des Klimawandels statistisch mit der Kointegrationsmethode getestet werden (Kaufmann and Stern, 1997, 2002; Stern and Kaufmann, 1999, 2000; Kaufmann et al., 2006a,b; Liu and Ro- driguez, 2005; Mills, 2009). Die in den letzten Jahrzehnten des 20. Jahrhunderts entwickelte Methode der Kointegration wird eingesetzt, um unechte Regressionsphänomene in instationären Zeitreihen aufzuspüren (Phillips, 1986; Engle and Granger, 1987). Instationarität entsteht, wenn Stichproben-Kenngrößen aus einer Zeitreihe (Mittel, Varianz, Kovarianz) zeitabhängig sind. Regressionsbeziehungen sind dann „unecht“ [siehe Erläuterung Prof. Dr. Lüdecke], wenn unabhängige instationäre Zeitreihen scheinbar signifikant korrelieren, weil sie zufälligerweise zeitliche Trends haben.

Die Methode der Kointegration ist erfolgreich beim Aufspüren von unechten Beziehungen in Zeitreihen von Wirtschaftsdaten.

So ist die Kointegration zum ökonometrischen Standard-Werkzeug geworden, um Hypothesen mit instationären Daten zu testen (Maddala, 2001; Greene, 2012). Wie bereits erwähnt, benutzen auch Klimatologen die Kointegration, um instationäre Klimadaten zu analysieren (Kaufmann and Stern, 1997). Die Kointegrationstheorie beruht auf der einfachen Vorstellung, dass Zeitreihen hoch korreliert sein können, obwohl es keine Kausalitätsbeziehung zwischen ihnen gibt. Bei einer „echten“ Beziehung müssen die Ergebniswerte nach einer Regression zwischen den Zeitreihen stationär sein. In diesem Falle sind die Zeitreihen “kointegriert”. Weil die stationären Restwerte im Mittel gegen “null” gehen, muss eine echte Langzeitbeziehung zwischen den Zeitreihen existieren, die sich über der Zeit annähern, weil sie einen gemeinsamen Trend haben. Wenn andererseits die Restwerte instationär sind, dann gehen die Restwerte nicht gegen “null”, die Zeitreihen haben keinen gemeinsamen Trend und die Beziehung zwischen ihnen ist „unecht“, weil die Zeitreihen nicht kointegriert sind. So kann sogar das R2 aus einer Regression zwischen instationären Zeitreihen 0,99 betragen, und dennoch die Beziehung „unecht“ sein.

Die ursprünglich von Engle and Granger (1987) entwickelte Methode der Kointegration geht davon aus, dass instationäre Daten bei Veränderungen Stationarität zeigen, auch Erst-Differenzen genannt. So kann sich die Temperatur über der Zeit erhöhen, also instationär sein, aber ihre Veränderung selbst stationär. Während der 1990er Jahre wurde die Kointegrationstheorie erweitert auf den Fall, wo eine Anzahl von Variablen zweimal differenziert werden muss (i.e. die Zeitreihen der Änderungen der Veränderung) bevor Stationärität erreicht wird. Diese Erweiterung ist als „polynomiale Kointegration” bekannt.

Frühere Analysen der Instationarität von Klimadaten-Zeitreihen (z.B. Kaufmann and Stern, 2002; Kaufmann et al., 2006a; Stern and Kaufmann, 1999) zeigten, dass Globaltemperatur und Sonneneinstrahlung stationär in erster Differenzierung sind, während das für Treibhausgase (in der Folge THG genannt) erst in zweiter Differenzierung zutrifft.

In der vorliegenden Studie wenden wir die Methode der polynomialen Kointegration an, um die Hypothese von der Verursachung der globalen Erwärmung seit 1850 durch verschiedene anthropogene Phänomene zu testen. Unsere Ergebnisse zeigen, dass die THG-Antriebe und andere anthropogene Phänomene nicht mit der Globaltemperatur und der Sonneneinstrahlung polynomial kointegriert sind. Deshalb, und trotz der hohen Korrelation zwischen anthropogenen Antrieben, Sonneneinstrahlung und Globaltemperatur zeigt sich für einen menschenverursachten Klimawandel statistisch keine Signifikanz. Die erkennbare statistische Beziehung zwischen Temperatur und anthropogenen Antrieben ist daher ein „unechtes“ Regressionsphänomen.

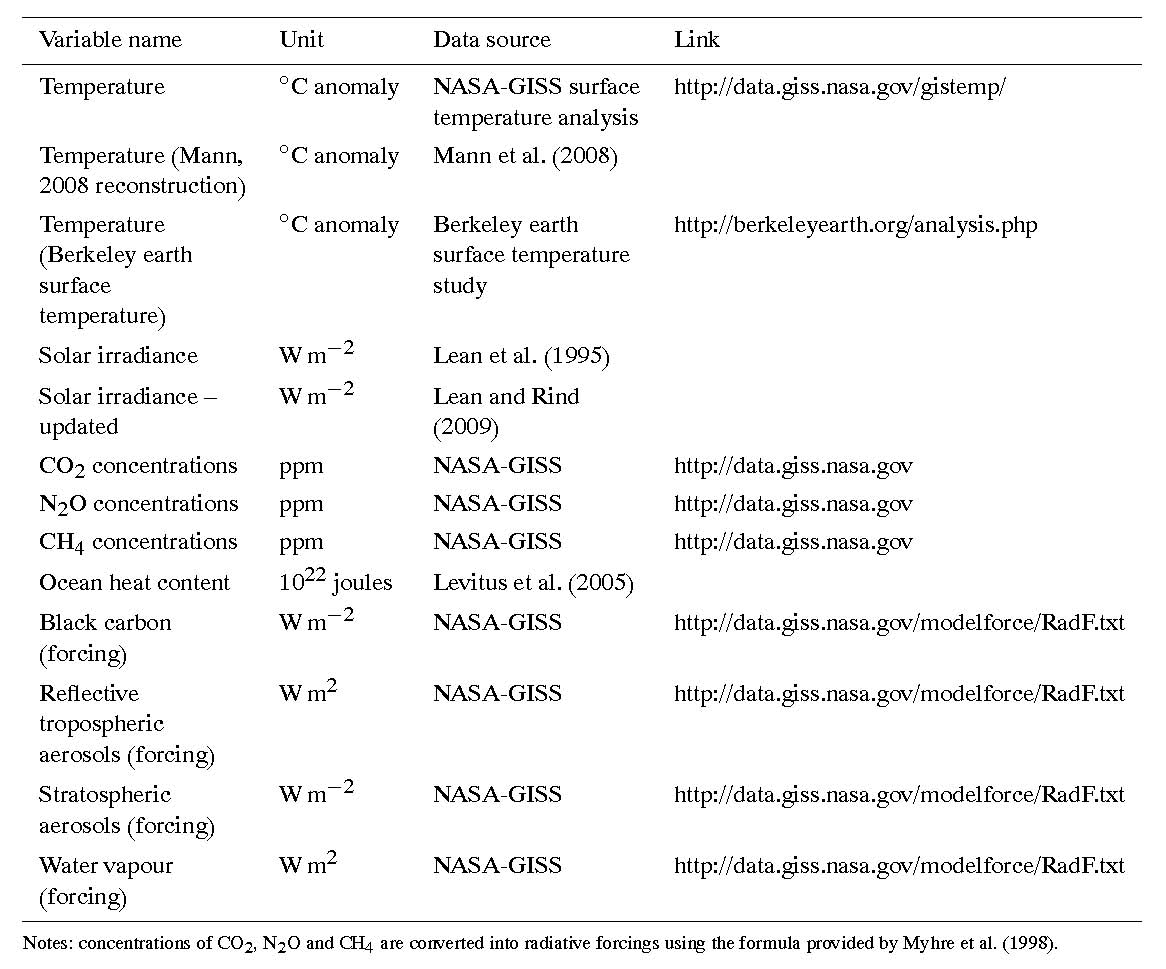

Daten und Methoden

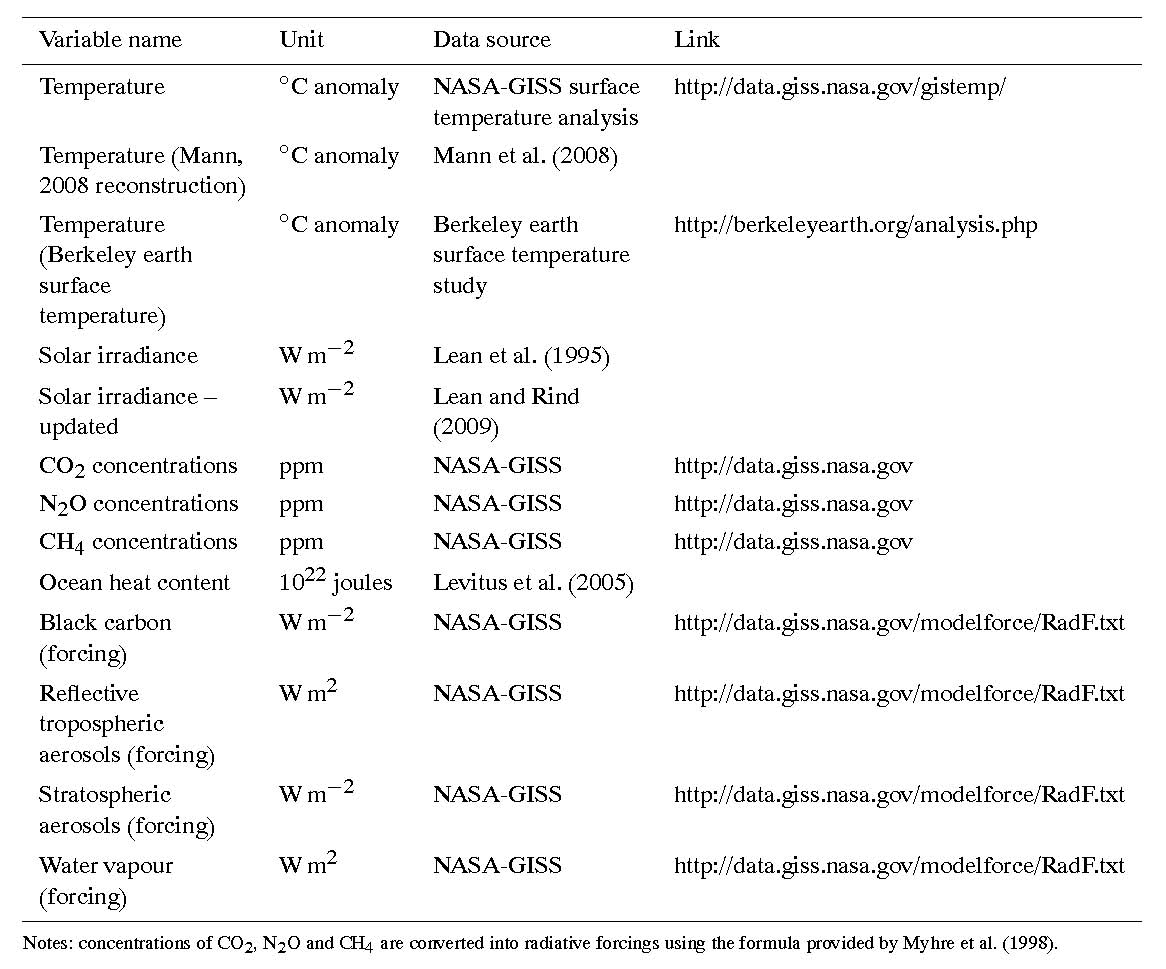

Wir benutzen Jahres-Daten (1850–2007) der Treibhausgas-Konzentrationen und Antriebe (CO2, CH4 and N2O), dazu Antriebe für Aerosole (Schwarzkohle, reflektive troposphärische Aerosole). Wir benutzen dazu Jahres-Daten (1880–2007) für Sonneneinstrahlung, Wasserdampf (1880–2003) und globale Durchschnittstemperaturen (Meer und Land zusammengefasst 1880–2007). Diese weithin benutzten Sekundärdaten kommen von NASA-GISS (Hansen et al., 1999, 2001). Zu Details über diese Daten siehe den Data Appendix.

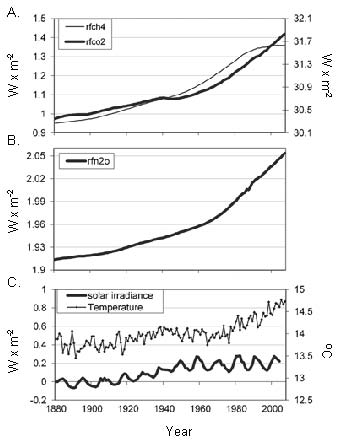

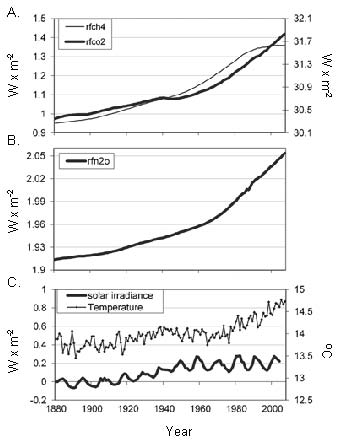

Wir führen Robustheitsprüfungen durch, indem wir neue Rekonstruktionen der Sonneneinstrahlung von Lean and Rind (2009) benutzen, die global gemittelten Temperaturen nehmen wir von Mann et al. (2008), die globalen Temperaturdaten der Oberflächen über Land (1850–2007) von der Berkeley Earth Surface Temperature Study [BEST]. Die Haupt-Zeitreihen sind in Fig. 1 abgebildet.

Fig. 1. Zeitreihe der Veränderungen in mehreren Variablen, welche die Klimaänderungen im 20. Jahrhundert repräsentieren oder beeinflussen. a) Strahlungs-Antriebe (rf, in W m−2) von 1880 bis 2007 für CH4 (Methan) und CO2 (Kohlendioxid); (b) Gleicher Zeitraum wie in Abb. a, aber für Stickoxid (N2O); (c) Sonneneinstrahlung (linke Ordinate, in W m−2) und Jahresglobaltemperatur (rechte Ordinate, in C°) von 1880–2003.

Darin zeigen die Abb. a und b die Strahlungs-Antriebe für drei Haupt-THG, während Abb. c die Sonneneinstrahlung und Globaltemperatur zeigt. All diese Variablen haben positive zeitliche Trends. Die zeitlichen Trends in den Abb. a und b scheinen nichtlinearer zu sein als ihre Gegenstücke in Abb. c. Die nachher berichteten statistischen Tests enthüllen, dass die Trends in Abb. c linear sind, wohingegen die Trends in den Abb. a und b quadratisch sind. Der Trend in der Sonneneinstrahlung hat sich seit 1970 abgeschwächt, während der Temperaturtrend sich in den 1950ern und 1960ern zeitweilig abschwächte.

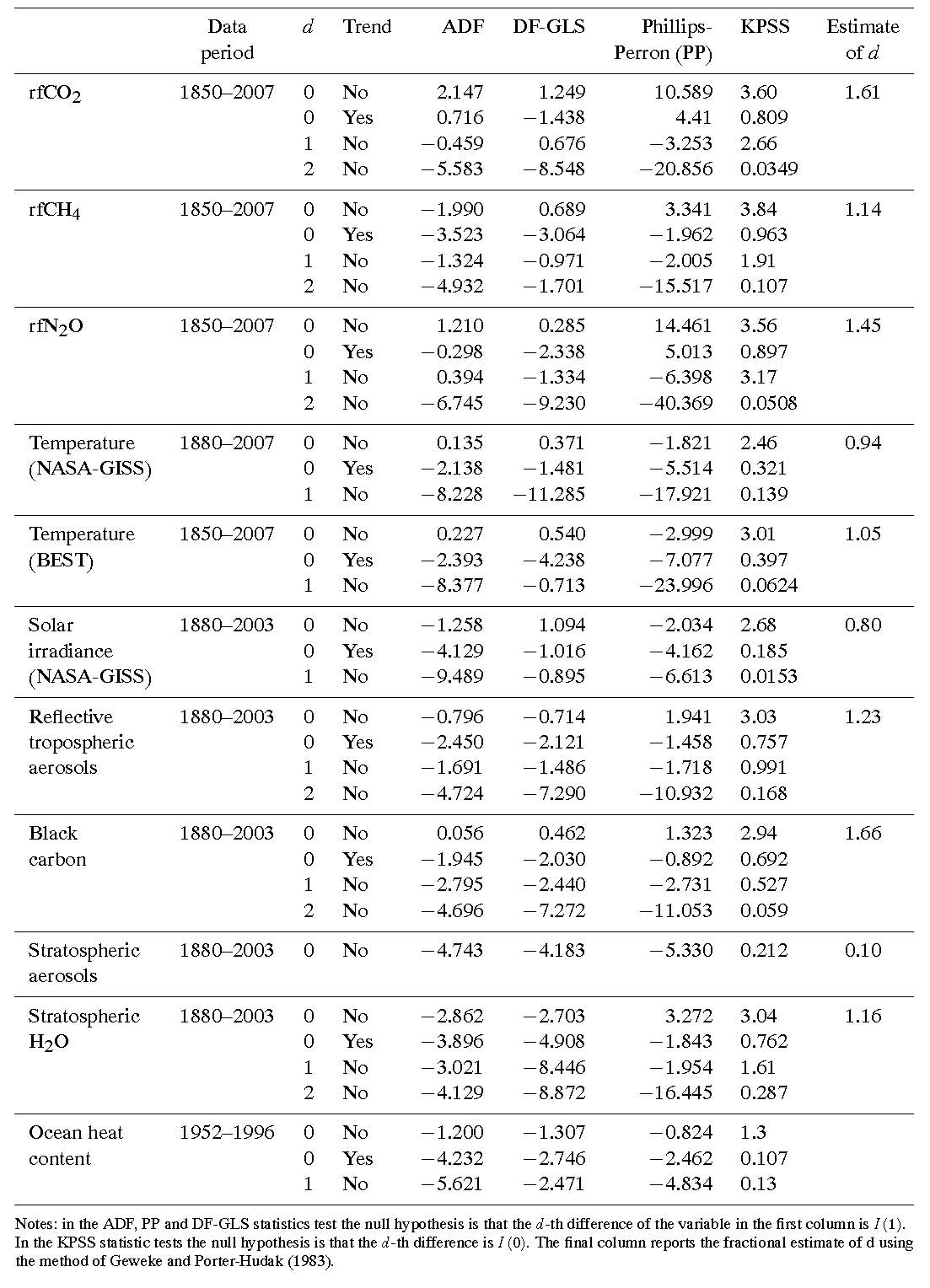

Die statistische Analyse instationärer Zeitreihen, wie z. B. die in Fig. 1, besteht aus zwei natürlichen Stufen. In der ersten werden Tests mit den Wurzeln der Einheiten gemacht, wobei die Daten nach Ordnung und Eigenschaft der Instationarität kategorisiert werden. Wenn die Daten instationär sind, sind die Kenngrößen der Stichprobenereignisse wie z. B. Varianzen, Ko-Varianzen zum Zeitpunkt der Stichprobe voneinander abhängig, dabei können die kleinsten Quadrate und die Abschätzungen der maximalen Wahrscheinlichkeiten der Parameter „unecht“ sein. In der zweiten Stufe werden diese instationären Daten benutzt um die Hypothesen anhand der Methode der Kointegration zu testen. Sie dient dazu, „echte“ von „unechten“ Beziehungen zwischen Zeitreihen unterscheiden zu können. Da die Leser von Earth System Dynamics vielleicht mit diesen Methoden nicht vertraut sind, geben wir eine Überblick über das Konzept und die Tests.

Ergebnisse

Eigenschaften der Zeitreihen der Daten

Eine rasche Betrachtung der Fig. 1 legt nahe, dass die Eigenschaften der Zeitreihen der Treibhausgas-Antriebe (Abb. a and b) von denen der Temperatur und Sonneneinstrahlung (Abb. c) erkennbar abweichen. In Abb. a und b gibt es Hinweise auf Beschleunigung, wohingegen in Abb. c die beiden Zeitreihen stabiler zu sein scheinen.

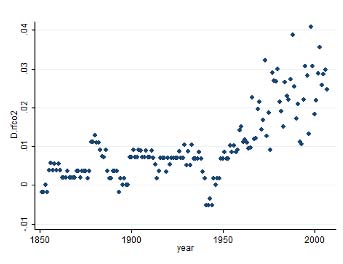

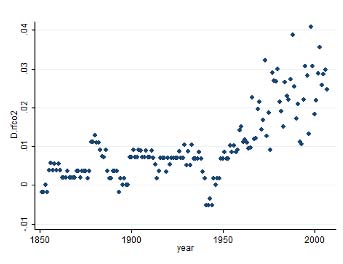

In Fig. 2 plotten wir rfCO2 in erster Differenzierung, das bestätigt den Sichtbefund, dass rfCO2 nicht I (1) ist, besonders seit 1940.

Fig. 2. Zeitreihen von rfCO2 in erster Differenzierung.

Ähnliche Darstellungen sind auch für andere Treibhausgas-Antriebe verfügbar. In diesem Abschnitt kommen wir zu dem wichtigen Befund, dass die Treibhausgas-Antriebe in erster Differenzierung nicht trend-frei sind, während die Unterschiede der Temperatur und Sonneneinstrahlung trend-frei sind. Das ist konsistent mit unserer Hauptbehauptung, dass anthropogene Antriebe [intergriert von der Ordnung] I (2) sind, während Temperatur und Sonneneinstrahlung I (1) sind. Was wir hier rasch erkennen, wird durch formale statistische Tests für die Variablen in Tabelle 1 bestätigt.

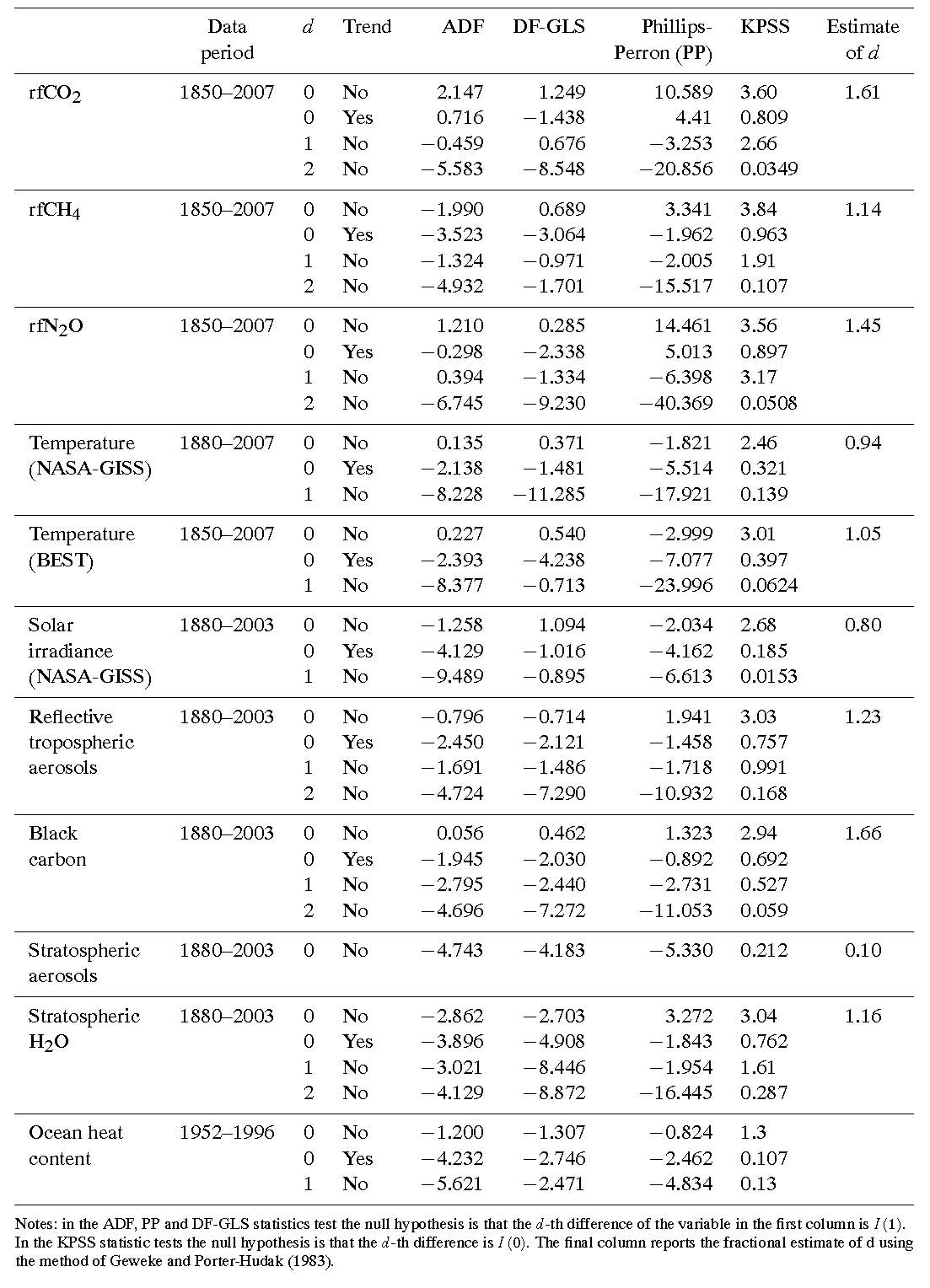

Obwohl die KPSS und DF-Typ Statistiken (ADF, PP und DF-GLS) unterschiedliche Null-Hypothesen testen, erhöhen wir nacheinander d bis sie geichlaufen. Wenn sie gleichlaufen, wenn d = 1 ist, dann typisieren wir die Variable als I (1), oder stationär hinsichtlich der Differenz. Bei den anthropogenen Variablen haben wir den Gleichlauf wenn d = 2. Weil die DF-Typ-Tests und die KPSS-Tests nicht zulassen, dass diese Variablen I (1) sind aber zulassen, dass sie I (2) sind, gibt es hier keinen unlösbaren Widerspruch. Die Sache hätte anders sein können, wenn gemäß der DF-Typ-Tests die anthropogenen Variablen I (1) gewesen wären, aber gemäß KPSS sind sie I (2).

Die erforderliche Anzahl von Erhöhungen für ADF ist irrelevant. Das häufig herangezogene Schwert-Kriterium benutzt eine Standardformel, die nur auf der Anzahl der Beobachtungen beruht, was wenig wenig hilfreich ist, weil dadurch Freiheitsgrade verloren gehen können. Wie schon gesagt, ziehen wir die Erhöhungen beim ADF-Test vor, solange bis die Restwerte seriell unabhängig werden, entsprechend einem La-Grange-Vervielfachungs-Test (LM). In den meisten Fällen werden 4 Erhöhungen gebraucht, bei rfCO2, rfN2O und stratosphärischem H2O werden aber 8. Auf jeden Fall ist die Klassifizierung robust in Bezug auf Erhöhungen im Bereich von 2 bis 10. Deswegen glauben wir nicht, dass die Anzahl der Erhöhungen unsere Klassifikationen beeinflusst. Die KPSS- und Phillips-Perron-Statistiken benutzen die nichtparametrischen Standard-Newey-West Kriterien für die Berechnung von robusten Standardfehlern. Tatsächlich sehen wir, dass diese Statistiken etwa 4 Autokorrelationen benutzen, was unserem LM-Verfahren entspricht, um die Anzahl der Erhöhungen für ADF zu bestimmen.

Diskussion

We haben gezeigt, dass anthropogene Antriebe keine polynome Kointegration mit der Globaltemperatur und der Sonneneinstrahlung aufweisen. Daher stützen die Daten für den Zeitraum 1880-2007 nicht die Erklärung einer anthropogenen globalen Erwärmung in jenem Zeitraum. (Hervorhebung durch dieRedaktion) Dieses Hauptergebnis wird grafisch in Fig. 3 gezeigt, wo die senkrechte Achse die Komponente der Globaltemperatur misst, die nach unserer Einschätzung nicht durch die Sonneneinstrahlung erklärt werden kann.

Fig. 3. Statistische Assoziation zwischen (Plot der Punktwolke) der anthropogenen Anomalie (Abszissen) und dem Netto-Temperatur-Effekt (d.h. Temperatur minus geschätztem Sonneneinstrahlungs-Effekt; Ordinaten). Abb. (a) – (c) stellen jeweils die Modell-Ergebnisse dar, wie jeweils in den Modellen 1 und 2 in Tabelle 3 und Gleichung (13). Die anthropogene Trend-Anomalie summiert die gewichteten Strahlungsantriebe der Treibhausgase (CO2, CH4 und N2O). Die Berechnung der Veränderung des Netto-Temperatur-Effekts (wie oben definiert) erfolgt durch Subtraktion: Von der beobachteten Temperatur in einem bestimmten Jahr wird das Produkt von Sonneneinstrahlung in jenem Jahr multipliziert mit dem Koeffizienten, der aus der Regression der jeweiligen Modell-Gleichung gewonnen wird, subtrahiert: 1,763 im Falle von Modell 1 (a); 1,806 im Falle von Modell 2 (b); und 1,508 im Falle von Gleichung (13) (c).

In Abb. a misst die horizontale Achse die Anomalie beim anthropogenen Trend, wenn letzterer aus Antrieben von Kohlendioxid, Methan und Stickoxid abgeleitet wird. In Abb. b misst die horizontale Achse diese anthropogene Anomalie getrennt von den Treibhausgas-Antrieben. Troposphärische Aerosole und Schwarzkohle sind eingeschlossen. Die Abb. a und b zeigen beide, dass keine Beziehung zwischen Temperatur und der anthropogenen Anomalie existiert, wenn der Erwärmungseffekt der Sonneneinstrahlung in die Betrachtung einbezogen wird.

Wir haben aber herausgefunden, dass Treibhausgas-Antriebe möglicherweise einen zeitweiligen Effekt auf die Globaltemperatur ausübten. Dieses Ergebnis wird in Abb. c der Fig. 3 dargestellt, wo die horizontale Achse die Veränderung im geschätzten anthropogenen Trend darstellt. Die Abb. c zeigt aber klar, dass eine positive Beziehung zwischen Temperatur und Veränderung der anthropogenen Anomalie besteht, wenn der Erwärmungseffekt der Sonneneinstrahlung in die Betrachtung einbezogen wird.

Derzeit werden die meisten Belege für die Stützung der Klimawandel-Theorie durch Kalibrierungs-Methoden und die Simulation von globalen Zirkulations-Modellen (GCM) gewonnen. Aus der Kalibrierung ergibt sich, z. B. bei Crowley (2000), dass zur Erklärung des Temperaturanstiegs im 20. Jahrhundert, und besonders seit 1970, ein genügend starker anthropogener Effekt bestimmt werden muss. Bei den Kalibrierern jedoch erfährt man nichts von Tests der statistischen Signifikanz dieses Effekts, sie überprüfen auch nicht, ob der Effekt vielleicht „unecht“ ist. Die Implikation unserer Ergebnisse ist, dass der Dauer-Effekt nicht statistisch signifikant ist. Trotzdem scheint es einen temporären anthropogenen Effekt gegeben zu haben. Wenn der Effekt eher temporär als permanent ist, würde eine Verdoppelung der Kohlenstoff-Emissionen keinen langfristigen Effekt auf die Erdtemperatur haben, aber für einige Jahrzehnte würde sie zeitweilig erhöht werden. Solcherart ist unseres Erachtens der Temperaturanstieg zwischen 1975-1995 und die nachfolgende Stabilität mit der Beschleunigung der Kohlenstoff-Emissionen während der zweiten Hälfte des 20th Jahrhunderts verknüpft (Fig. 2). Die Implikationen für die Politik sind erheblich, weil ein zeitlich begrenzter Effekt weniger ernst ist als ein permanenter.

Die Tatsache, dass seit der Mitte des 19. Jahrhunderts die Erdtemperatur nicht mit anthropogenen Antrieben verbunden ist, widerspricht nicht den Gesetzen der Thermodynamik, nicht der Treibhaustheorie, oder irgendeiner anderen physikalischen Theorie. Bei der Komplexität des Erdklimas und unserem unvollkommenen Verständnis davon, ist es schwer, die Hauptursache für die globale Erwärmung im 20. Jahrhundert den Kohlenstoff-Emissionen oder anderen anthropogenen Phänomenen zuzuschreiben. Dieses Argument ist kein physikalisches, sondern es bezieht sich auf die Daten-Interpretation. Stützen die Klimaentwicklungen in der jüngsten Vergangenheit die Interpretation, dass die globale Erwärmung in diesem Zeitraum durch menschliche Handlungen verursacht wurden? Wenn die Erdtemperatur im 20. Jahrhundert nicht zugenommen hätte, trotz der Zunahme der anthropogenen Antriebe (wie es in der zweiten Hälfte des 19. Jahrhunderts der Fall war), wäre dies kein Beweis gegen die Treibhaustheorie. Aber unsere Ergebnisse stellen die Daten-Interpretation in Frage, derzufolge die globale Erwärmung seit 1880 ein anthropogenes Phänomen sei.

Auch widerspricht die Tatsache, dass während jener Periode die anthropogenen Antriebe I (2) sind, also stationär in zweiter Differnzierung, während Erdtemperatur und Sonneneinstrahlung I (1) sind, also stationär in erster Differenzierung, keiner physikalischen Theorie. Aus Gründen der Physik kann erwartet werden, dass diese Variablen über die Jahrtausende die gleiche Intergrationsordnung aufweisen; sie sollten alle I (1) sein oder alle I (2), andernfalls gäbe es ein andauerndes Energie-Ungleichgewicht. Für die vergangenen 150 Jahre besteht aber kein physikalischer Grund, warum diese Variablen die gleiche Intergrationsordnung aufweisen sollten. Die Tatsache, dass sie in jenem Zeitraum nicht von gleicher Integrations-Ordnung sind, gemahnt Wissenschaftler zur Vorsicht, wenn sie überzeugende Interpretationen abgeben wollen von einer anthropogenen Verursachung der jüngsten globalen Erwärmung. Unsere polynomialen Kointegrationstests stehen im Widerspruch zu einer derartigen Interpretation der Daten.

Schlussendlich sind alle statistischen Tests probabilistisch und sie hängen von der Spezifikation des Modells ab. Der Typ-1-Fehler bezieht sich auf die Wahrscheinlichkeit der Zurückweisung einer Hypothese, wenn sie wahr ist (falsch positiv). Der Typ-2-Fehler bezieht sich auf die Nicht-Zurückweisung einer Hypothese wenn sie falsch ist (falsch negativ). In unserem Falle ist der Typ-1-Fehler sehr klein, weil der anthropogene Antrieb I (1) ist, mit einer sehr kleinen Wahrscheinlichkeit, und die Temperatur ist polynomial kointegriert, ebenfalls mit sehr kleiner Wahrscheinlichkeit.

Wir haben auch mit einer Anzahl von Modell-Spezifikationen und Schätzmethoden experimentiert. Das bedeutet aber, dass, wie bei allen Hypothesen, unsere Widerlegung des anthropogenen Klimawandels keine absolute ist; sie könnte auf „falsch positiv“ lauten, Auch können wir die Möglichkeit nicht ausschließen, dass die jüngste globale Erwärmung einen anthropogenen Stempel trägt. Doch diese Möglichkeit ist sehr klein und auf konventionellem Level statistisch nicht signifikant.

Daten-Appendix.

Related Files