Die Abbildung auf der rechten Seite zeigt die möglichen Standorte für Schiefergasvorkommen an (Ockerfarben). Regionen mit Bergbau-Berechtigung in Deutschland sind gelb dargestellt.

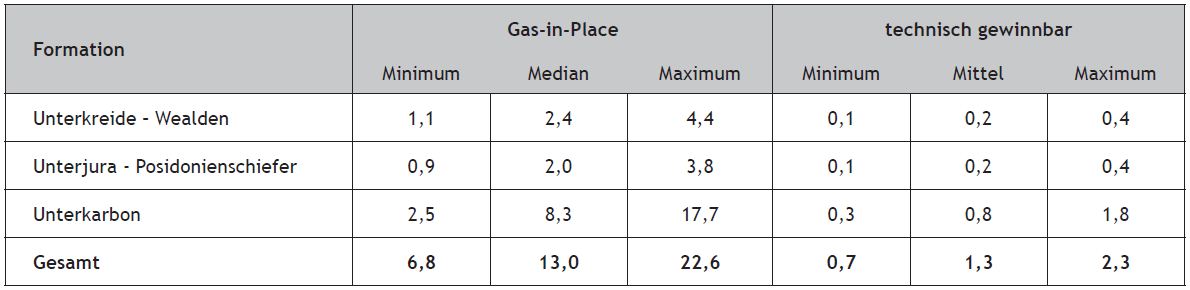

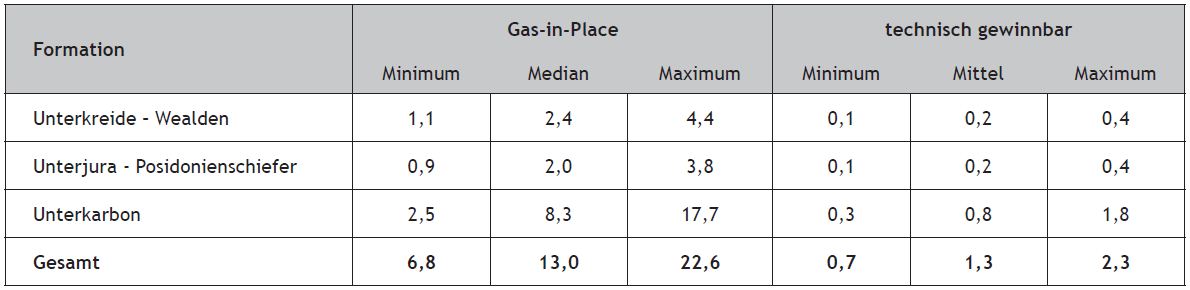

Die gesamten Ressourcen an Schiefergas schätzen die Geowissenschaftler in der Arbeit auf 6,8 bis 22,6 Billionen m³. Bei der (sehr konservativen) Annahme, dass man 10% davon wirtschaftlich gewinnen kann werden die Reserven mit 0,7 bis 2,3 Billionen m³ abgeschätzt.

Offiziell beziffert man momentan die Deutschen Schiefergas Reserven mit 1,3 Billionen Tonnen. Das ist zehnmal mehr als man bislang dachte und würde ausreichen Deutschland für 15 Jahre mit Gas zu versorgen.

Bislang bekannte Gas-Reserven in Deutschland. Quelle: BGR-Studie

Ressourcen und Reserven

An dieser Stelle verdient der Unterschied zwischen Energieressourcen und Energiereserven eine kurz Erläuterung. Bei den Reserven handelt es sich um die Menge, welche sich zu heutigen Preisen und bei heutigem Technologiestand wirtschaftlich fördern lässt. Ressourcen sind Energiequellen die zwar bekannt sind, deren Nutzung heute jedoch technologisch oder ökonomisch noch nicht interessant ist.

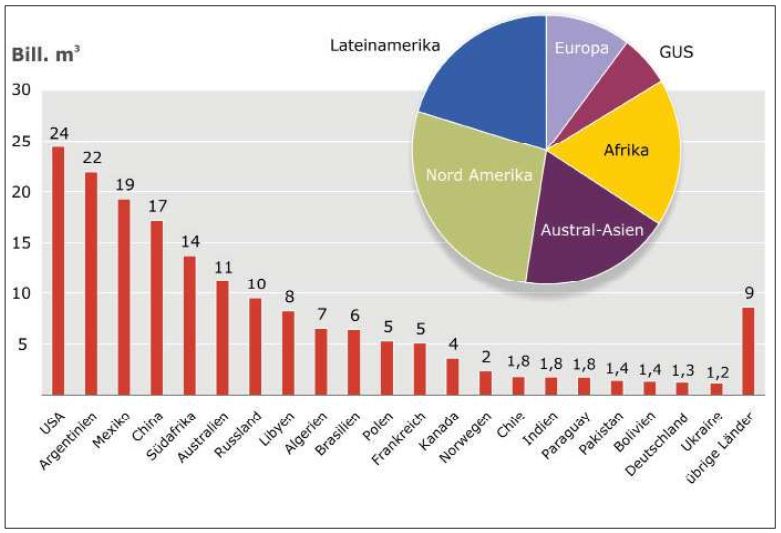

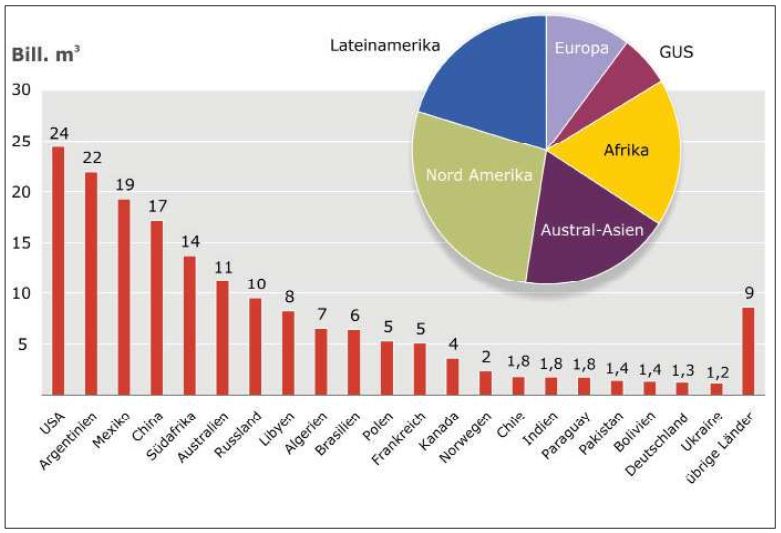

Die im Jahr 2010 bekannten weltweiten Reserven an Schiefergas (Deutschland 2012). Quelle: BGR-Studie

Aus diesem Umstand ergibt sich der auf den ersten Blick seltsam erscheinende Effekt, dass die Energiereserven bei steigenden Rohstoffpreisen ansteigen. Zum einen weil durch höhere Preise auch solche Quellen genutzt werden, deren Erschließung bislang zu teuer war. Und zum anderen, weil durch höhere Preise und die daraus resultierenden höheren Gewinnerwartungen die Entwicklung neuartiger Technologien gefördert wird.

Genau der letztgenannte Effekt hat den gewaltigen Technologiesprung bei der Förderung von unkonventionellem Gas in den letzten Jahren ausgelöst.

Vorrat an unkonventionellem Gas und Öl ist vermutlich viel größer als bislang bekannt

Es ist noch wichtig zu erwähnen dass es sich bei den in der BGR-Studie genannten Zahlen um sehr vorläufige Werte handelt. Die Forscher schreiben:

Bei den ermittelten Gasmengen handelt es sich um vorläufige Angaben, da die derzeitige Datengrundlage für eine abschließende Bewertung des Erdgaspotenzials nicht ausreichend ist.

Schließlich läuft das Projekt zur Erforschung der unkonventionellen Lagerstätten der BGR noch bis 2015. Das jetzt Vorgestellte Papier ist ein Zwischenbericht. Weite Bereiche in Deutschland sind noch gar nicht untersucht worden. Auch steht die Suche nach Formationen die Schiefer-Öl enthalten noch aus. Und die Gewinnung von unkonventionellem Öl hat mit ähnlichen Techniken wie sie beim Gas-Fracking angewendet werden in den USA gerade eine Renaissance bei der Ölforderung ausgelöst. Der Vorrat an förderbaren Kohlenwasserstoffen in Deutschland wird also aller Voraussicht nach noch um einiges höher sein.

Neben der Abschätzung des Schiefergaspotenzials wird im weiteren Fortgang des Projektes auch das Potenzial an nicht-konventionellem Erdöl untersucht werden. Darüber hinaus wird eine Methode des US-amerikanischen Geologischen Dienstes (USGS) zur Potenzialabschätzung angewendet.

Unkonventionelles Gas könnte Boom in Deutschland auslösen

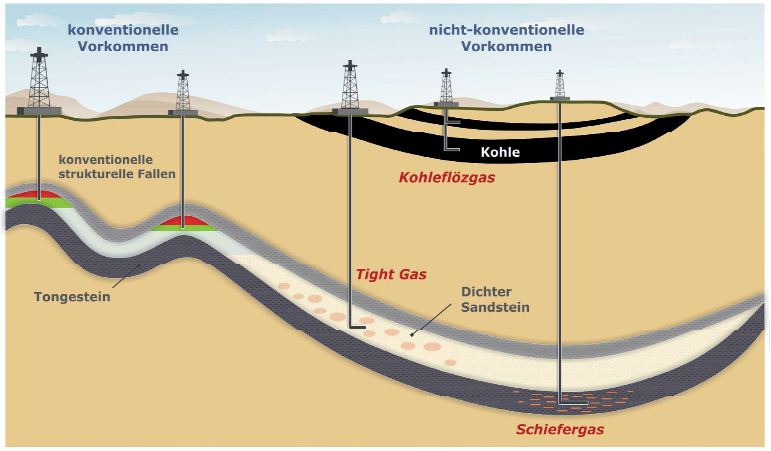

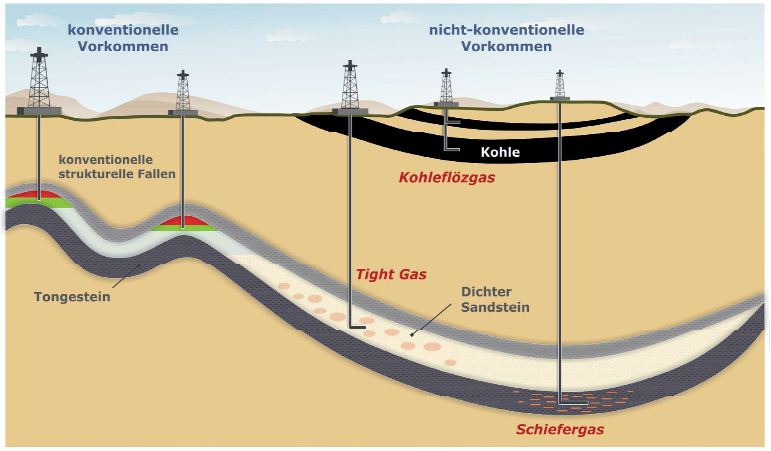

Schematische Darstellung konventioneller und nicht-konventioneller Erdöl- und Erdgas-Vorkommen. Rot: Erdgas, grün: Erdöl. Quelle: BGR-Studie

Die Aussicht auf die bereits jetzt bekannte riesige Mengen an förderbarem unkonventionellem Gas allein könnte schon einen Boom in der Gasindustrie auslösen.

Und damit genau das erreichen, was die Politik sich von den “Erneuerbaren Energien” zwar versprochen hat, woran diese aber, wie die Pleiten in der Solarindustrie eindrucksvoll zeigen, grandios gescheitert sind. Und zwar, sichere Arbeitsplätze in einer zukunftsträchtigen High-Tech Industrie zu schaffen.

Und man kann es wohl als gesichert ansehen, dass die Förderung von unkonventionellen Kohlenwasserstoffen in Deutschland einen weiteren Technologieschub erfahren wird.

Die Erfahrungen beim Bergbau, wo Deutschland bei der Entwicklung neuer Technologien und Verfahren eine führende Rolle auf der Welt eingenommen hat, können hier als Beispiel dienen. Und obwohl Deutschland bei der Förderung von Kohle keine bedeutende Rolle mehr spielt, zählt es bei der Entwicklung und Produktion von Bergbaumaschinen nach wie vor zu den führenden Nationen. Die Wahrscheinlichkeit dass Deutschland in naher Zukunft auch bei der Bohr-und Extraktionstechnologie zur technologischen Weltspitze gehört ist extrem hoch.

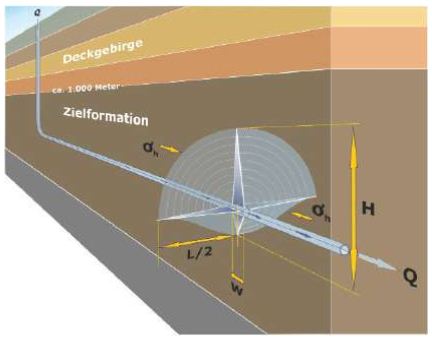

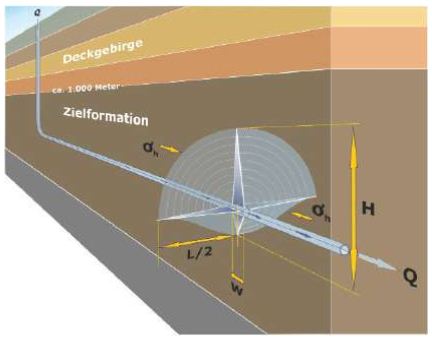

Schematische Darstellung einer Horizontalbohrungsstrecke mit einem durch Fracking erzeugten hydraulischen Riss. Quelle: BGR-Studie

Kombination aus Technologien macht Förderung interessant

Die Exploration von unkonventionellen Kohlenwasserstoffen ist schließlich technologisch äußerst anspruchsvoll. Es wird dabei ausgenutzt, dass unterirdische Bohrungen mittlerweile in die verschiedensten Richtungen gelenkt werden können. Dadurch können selbst bislang nicht zugängliche Gasfelder auf einmal sehr interessant werden. Vor allem wenn man die Möglichkeit des horizontalen Bohrens mit einer anderen Technik verbindet, dem Öffnen von Gesteinsporen durch das Einpumpen von Flüssigkeit, auch Hydraulic Fracturing oder Fracking genannt. Durch die Kombination dieser beiden Technologien wurde die Gasförderungin den letzten Jahren nicht weniger als revolutioniert.

Fracking wird seit langem angewendet

Das Fracking selbst ist eine Technik, die im 19. Jahrhundert zum ersten mal angewendet wurde und seit den 50er Jahren des 20. Jahrhunderts auf breiter Basis durchgeführt wird. Seit Beginn der 60er Jahre wird diese Technologie auch in Deutschland zur Stimulierung von Erdgaslagerstätten eingesetzt.

Bei den heutzutage üblichen Verfahren wird zunächst eine Bohrung senkrecht in die Tiefe getrieben bis die Zielgesteinsschicht erreicht wird. Diese befindet sich in der Regel zwischen 1.000 und 4.000 Meter Tiefe. Danach wird die Bohrung umgelenkt und horizontal weitergeführt.

Das gesamte Bohrloch wird dabei mit einem Stahlrohr ausgekleidet welches im gasführenden Gestein mit einer Perforationskanone durchlöchert wird. Beim dann folgenden eigentlichen Fracking-Prozess wird wird eine Flüssigkeit unter hohem Druck in die Erdgaslagerstätte gepumpt, um künstliche Fließwege für das Gas zu schaffen.

Die Flüssigkeit besteht zu rund 98 Prozent aus Wasser und Quarzsand. Bis zu 2 Prozent sind chemische Stoffe, die unter anderem für den Korrosionsschutz und zur Reibungsminderung erforderlich sind. Die Gesteinsrisse werden von dem beigegebenen Quarzsand offen gehalten. Sie stellen sicher, dass das Erdgas aus dem festen Gestein entweichen und zum Bohrloch fließen kann. Das Bohrloch selbst wird mit mehreren Schichte einzementierter Stahlrohre abgedichtet. So wird eine undurchdringbare Barriere zwischen dem Bohrloch und etwas wasserführenden Schichten geschaffen.

Bei dem gesamten Prozess dauert die Bohrung einige Wochen, Das Fracking selbst benötigt nur wenige Tage. Die eigentliche Gasförderung ist weit weniger arbeitsintensiv, kann aber, abhängig von der Lagerstätte, zwischen 10 und 30 Jahre andauern. Der gesamte Prozess der Bohrung, des Frackings und der anschließenden Förderung ist sehr anschaulich in einem Video von ExxonMobil und in dieser Animation dargestellt.

Widerstand kommt von den bekannten Stellen

Das Potenzial an Gaslagerstätten welche mit dieser neuen Technologie wirtschaftlich genutzt werden können ist gigantisch. Die weltweite Versorgung mit Gas könnte so über lange Zeit gesichert werden. Ein Umstand, der selbsternannte Umweltschutzgruppen jedoch nicht davon abhält, dieses Verfahren mit Vehemenz zu bekämpfen. Das Muster dabei ist altbekannt. Es werden theoretische Gefahren postuliert und durch Übertreibung und oft auch falsche Darstellungen soll in der Bevölkerung Angst vor der neuen Technologie geschürt werden.

So wird von Kritikern dieser Methode gerne der Film „Gasland“ des amerikanischen Filmemachers Josh Fox angeführt. Dieser Film zeigt unter anderem brennende Wasserhähne, die eine Folge der Förderungen von unkonventionellem Gas in Colorado sein sollten. Allerdings hat eine vom Department of Natural Ressources des Staates Colorado durchgeführte Untersuchung, dass das in den Hausbrunnen gefundene Methan nachweislich mit dem Fracking in mehr als tausend Meter Tiefe nichts zu tun hat, was sich etwa anhand der chemischen Zusammensetzung und der Isotopenverteilung belegen lässt.

Risiken nicht größer als bei konventioneller Förderung

Und gerade die Erschließungen in Nordamerika zeigen, dass die immer wieder genannten Gefahren beim Fracking von Seiten der Umweltschutzbewegungen massiv übertrieben wurden. Eine Anfang des Jahres erschienene Studie zu dem Thema, die sich auch mit der Förderung in den USA beschäftigt hat, kommt zu dem Ergebnis dass bei korrekter Durchführung nur eine geringe Gefahr von Fracking ausgeht. Auch in der aktuelle BGR-Studie wird auf die Umweltaspekte dieser Methode ausführlich eingegangen. Die Forscher kommen dabei zu ähnlichen Resultaten wie ihre amerikanischen Kollegen:

“Die Risiken von Fracking-Maßnahmen im geologischen Untergrund stellen sich im Vergleich zu möglichen Unfällen bei obertägigen Aktivitäten als gering dar. durch standortbezogene Voruntersuchungen können Fracking-Maßnahmen so geplant werden, dass ein unkontrolliertes Entweichen der Fracking-Fluide aus dem unterirdischen Riss in angrenzende Formationen mit sehr hoher Wahrscheinlichkeit ausgeschlossen werden kann.”

Auch die oft getätigte Aussage, dass es sich bei der beim Fracking eingesetzten Flüssigkeit um einen gefährlichen Chemikaliencocktail handeln würde, ist mehr als eine simple Übertreibung. Hauptbestandteil der Fracking-Flüssigkeit ist Wasser. Dazu kommt noch (manchmal) CO2, Quarz (Sand) und eine Reihe von Chemikalien (< 2%). Das Flüssigkeitsgemisch als Ganzes ist als schwach wassergefährdend und nicht umweltgefährdend eingestuft. Es stellt nach dem Chemikalienrecht kein kennzeichnungspflichtiges Gemisch dar (Hier eine Übersicht über eingesetzte Chemikalien bei verschiedenen Frac-Maßnahmen in Deutschland).

Es handelt sich beim Fracking um eine Technologie, die bei sachgemäßer Durchführung keine größere Gefährdung für die Umwelt darstellt, als die konventionelle Gasförderung. Durch die Möglichkeit der horizontalen Bohrung ist der überirdische Flächenverbrauch sogar weit geringer als bei herkömmlichen Methoden.

Chancen für die Energieversorgung in Deutschland

Noch ein weiterer Aspekt macht das Schiefergas interessant. Schließlich besitzt die Kontroverse um das unkonventionelle Gas in Deutschland erhebliches Potenzial zu einem politischen Streitthema zu werden. Einem Streit, bei dem es viel zu gewinnen gibt. Geht es dabei nämlich um nicht weniger als die zukünftige Ausrichtung der Energieversorgung bei uns im Land.

Die Förderung von Schiefergas könnte der Debatte um die Energiewende eine völlig neue Richtung verleihen. Schließlich versucht sich unsere Bundesregierung gerade an der Quadratur des Kreises, indem sie die Energieversorgung auf “Erneuerbare” umstellen will, die Stromversrogung jedoch bezahlbar halten und die Versorgungssicherheit gewährleisten muss und nach dem Ausstieg aus der CO2-freien Kernenergie trotzdem die Europäischen Ziele zur Emissionsminderung einzuhalten plant.

Strompreise als Gefahr für die „Energiewende“

Vor allem einen weiteren Anstieg bei den Strompreisen zu verhindern scheint jedoch zunehmend das Gebot der Stunde zu werden. Während zu erwarten ist, dass die Preise im nächsten Jahr vor allem aufgrund der Erhöhung der Einspeisevergütung für die neuen ineffizienten Energien (NIE) Wind und Sonne auf über 5 Cent für die Kilowattstunde ansteigt, sorgen sich immer mehr Menschen hier im Land um die Bezahlbarkeit des Stroms. Und so langsam scheint die Presse auch auf die Entwicklung der Stromkosten durch die Energiewende aufmerksam geworden zu sein. Artikel wie etwa der vorletzte Focus-Titel oder wie diesen Artikel in der Welt oder diesen aus der FAZ hätte man noch vor einem Jahr wohl vergeblich gesucht. So langsam verbreitet sich die Geschichte, dass der Strom in naher Zukunft wegen der Energiewende immer teurer wird.

Während eine kürzlich von der grün-roten Landesregierung in Stuttgart in Auftrag gegebene Studie bis 2020 nur einen moderaten Anstieg der Strompreise um etwa 5 Cent pro Kilowattstunde erwartet, glauben mittlerweile viele Deutsche eher an die Zahlen die das Karlsruhe Institut für Technolgie (KIT) ermittelt hat. Dort geht man von einem Anstieg der Strompreise in Höhe von 70% bis 2025 aus. Vor allem wegen der teuren „Erneuerbaren“ Energien.

Immer mehr Menschen haben (zurecht) Angst davor, dass die Energie schon bald unbezahlbar wird. Und für immer mehr ist sie das bereits geworden. Laut dem Bund der Energieverbraucher ist bislang 600.000 bis 800.000 Menschen der Strom abgestellt worden weil Sie ihre Rechnung nicht mehr bezahlen konnten. Im Vergangenen Jahr haben so viele Harz 4 Empfänger Notkredite beantragt, wie nie zuvor. Oft weil sie ansonsten die Nachzahlung der Stromrechnung nicht hätten begleichen können.

Ein modernes Gas-und-Dampf-Kraftwerk. Bildquelle: Wikipedia

Schiefergas als Rettungsanker für die Energiewende

Die Suche nach bezahlbarer und umweltverträglich produzierter Energie könnte durch das Schiefergas eine völlig neue Richtung bekommen. Ohne Zweifel würde die Förderung von unkonventionellem Gas in Deutschland die Gaspreise senken. In den USA hat sich der Preis für Gas seit Beginn des Shale-Gas Booms halbiert. Obwohl die amerikanische Regierung den Bau von zwei neuen Kernkraftwerken genehmigt hat werden diese in absehbarer Zeit wohl nicht gebaut werden. Strom aus Gas ist dort jetzt billiger, also baut man Gaskraftwerke.

Das sind Energiewirtschaftliche Bedingungen von der unsere Bundesregierung derzeit nur träumen kann. Weil Gaskraftwerke vielfach wegen des Vorrangs der NIE nicht mehr rentabel zu betreiben sind plant Eon bereits drei Blöcke zu schließen. Der für die Aufrechterhaltung der Stromversorgung so dringend benötigte Neubau von schnell regelbaren Gaskraftwerken findet erst recht nicht statt. Vor allem weil diese vornehmlich als Lückenbüßer für die Zeit dienen müssten, in denen nicht genug „erneuerbarer“ Strom produziert wird. Ein niedriger Gaspreis könnte die Situation hier umdrehen und Gaskraftwerke zu günstigen Stromproduzenten machen.

Schiefergas kann Deutschland unabhängiger von Importen machen

Billiges Gas aus eigener Produktion wäre die Chance unsere Stromversorgung bezahlbar und stabil zu halten, die in Europa vereinbarten Klimaschutzziele zu erreichen und gleichzeitig unabhängiger von Importen von Energierohstoffen zu werden. Die entstehenden Arbeitsplätze in der Förderindustrie und im Anlagenbau würden dauerhaft in Deutschland bleiben. Und das Ganze würde diesmal völlig ohne Subventionen und marktverzerrende Gesetze funktionieren. Die Förderung von unkonventionellem Gas würde dem Staat umgekehrt sogar Einnahmen aus Explorationslizenzen und Steuern einbringen.

Um auch in Deutschland einen Gasboom auszulösen bedarf es eigentlich nur noch einer Politik welche das riesige Potenzial der Gasförderung in Deutschland erkennt und die gewillt ist seine Entscheidungen auch gegen den Widerstand von Umweltschutzgruppen und anderen Forschrittsgegnern durchzusetzen.

Eine solche Politik hätte sicher vor allem bei den zuletzt von der CDU und der FDP vergraulten konservativen und liberalen Wähler einiges Mobilisierungspotenzial. Den meisten dieser Menschen sind bezahlbare Energiepreise und die Sicherung Deutschlands als Industriestandort nämlich wichtiger als die Bestätigung irrationaler Technologieängste.

Rudolf Kipp; zuerst erschienen in Science Sceptical

ÄHNLICHE BEITRÄGE :

* ganz aktuell SPON: Neue Studie gibt Entwarnung für Fracking (mit Dank an Leser Laburda)

* Welt Online vom 01.07.2012 Mehr als 30 Gasanbieter erhöhen die Preise

* Ein weiterer Rückschlag für Peak-Oil – Schwarzes Gold vom Schwarzen Kontinent

* Neue Energiestudie: “Der Tod der Peak-Oil Hypothese”

* Öl und Benzin – der Faktencheck