Eine unbequeme Wahrheit: Während der Kleinen Eiszeit waren die Stürme in Europa stärker als heute

Man malte schaurig-apokalyptische Bilder, welche sich in den Köpfen der verängstigten, unklimatischen Zivilbevölkerung allmählich festsetzen. Nur die wenigsten nahmen sich die Zeit, die ungeheuerlichen Prognosen zu überprüfen. Und diejenigen die es taten, trauten ihren Augen nicht.

Die fachliche Grundlage derartiger Szenarien ist überaus dürftig und wichtige Gegenargumente wurden einfach ausgelassen. Überschattet wurde die ganze Szenerie von möglichen Interessenskonflikten der Protagonisten. Wir haben bereits mehrfach über die verschiedenen Gewerke des Extremwetters berichtet (siehe Artikel-Übersicht und unser Blogbeitrag „Die Versicherungswirtschaft und die Klimakatastrophe: Eine unheimliche Liaison“).

Heute wollen wir uns einmal die Idee vornehmen, dass Europas Stürme in den kommenden Jahrzehnten immer häufiger und heftiger werden würden. Begründet wird dies mit der zu erwartenden Klimaerwärmung. Hierzu zunächst eine kleine Rückblende in den März 2012, als in Hamburg der „Extremwetterkongress“ stattfand. Die Südwest Presse schrieb damals:

„Klimaexperten tagen derzeit in Hamburg, um die Entwicklung des Wetters zu diskutieren. Ihre Botschaft ist deutlich: Wetterkatastrophen in Deutschland haben zugenommen – und es wird schlimmer werden. Immer mehr Hagel, Starkregen und Stürme: Analysen des Rückversicherers Munich Re zufolge, die gestern beim “Extremwetterkongress” in Hamburg vorgestellt wurden, müssen wir uns warm anziehen: “Die Daten zeigen eindeutig: Die Zahl wetterbedingter Naturkatastrophen in Deutschland hat sich seit 1970 mehr als verdreifacht”, sagte Peter Höppe, Chef der Munich Re-Georisikoforschung. “Veränderungen in der Atmosphäre tragen einen Anteil daran, dass hier immer mehr Wetterextreme auftreten.” Der Trend setze sich fort. “Für die nächsten 30 Jahre rechnen Klimamodelle in Deutschland vor allem mit einer Zunahme der Sturmintensität und mit mehr Starkniederschlägen, die zu Überschwemmungen führen”, erklärte Höppe.“

Und auf Zeit Online war zu lesen:

„Der [Deutsche Wetterdienst] DWD geht davon aus, dass die Zahl heißer Tage, die Starkniederschläge und die Anzahl der Winterstürme um bis zu 50 Prozent zunehmen.“

Auch andere Klimadiskutanten sehen mehr Stürme am Horizont der mittleren Breiten. So veröffentlichte im April 2012 eine britisch-deutsche Forschergruppe um Tim Woolings von der University of Reading in nature geoscience eine neue Studie, in der sie den derzeit schwächelnden Golfstrom als Auslöser von vermehrten Stürmen im östlichen Nordatlantik und in Europa sehen. Durch die Klimaerwärmung würde der Golfstrom allmählich an Kraft verlieren, was dann über Umwege die Sturmtätigkeit befördert, wie Der Standard am 3.4.2012 berichtete (siehe auch Beitrag auf scinexx):

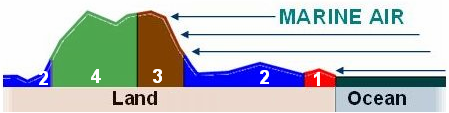

„Je schwächer die thermohaline Zirkulation ist, desto geringer wird die Zufuhr von warmem Oberflächenwasser in den nördlichen Teil des Nordatlantiks. Dadurch nimmt das Nord-Süd-Gefälle in der Wasseroberflächen-Temperatur zu und beeinflusst somit auch das Temperatur-Gefälle in der unteren Atmosphäre. Dieser so genannte Temperaturgradient ist sehr wichtig für die Entstehung von Tiefdruckgebieten. Je höher der Temperaturgradient, desto mehr potentielle Energie steht für die Entwicklung eines Sturms zur Verfügung. Die Stürme können dadurch extremer werden.“

Aber wie kamen die Forscher auf diesen Zusammenhang? Nun, sie verwendeten einen ganzen Strauß der offiziellen IPCC-Klimamodelle. Und eben diese Modelle mussten in der Vergangenheit sehr viel Kritik einstecken (siehe z.B. unser Buch „Die kalte Sonne“). Weder können diese Modelle die Klimageschichte der letzten 10.000 Jahre reproduzieren, noch haben sie den Erwärmungsstop seit 1998/2000 vorhergesagt. Sollten eben diese fehlerhaften Modelle nun wirklich in der Lage sein, die Sturmentwicklung korrekt vorherzusagen? Es dürfen Zweifel angemeldet werden.

Schon gibt es die ersten, die auf den Sturmangst-Zug aufspringen und das ihnen vermeintlich drohende Leid öffentlich beklagen. Hierzu gehört beispielsweise Christoph Rullmann von der Schutzgemeinschaft Deutscher Wald, der jetzt dringend Hilfe für die Buche fordert. Nachdem das Waldsterben der 1980er Jahre durch den Einsatz von Filtern auf den Kraftwerks- und Fabrikschloten in letzter Sekunde noch einmal abgewendet werden konnte, drohe der Buche nun neues Ungemach, sagte Rullmann am 3.2.2012 im Deutschlandradio:

„Aber diese Entwicklung, die sozusagen für den Wald positiv sich gestaltet hat, die wird jetzt überlagert durch die Veränderungen des Klimawandels, der zum Beispiel durch Stürme, durch diese Trockenereignisse, die wir immer stärker haben – wir hatten ja auch wieder dieses Jahr ein sehr trockenes Frühjahr, und das belastet natürlich die Wälder extrem.“

Und auf Zeit Online: machte sich bereits Claudia Kemfert Sorgen, ob die Windmühlen mit den von den Modellierern geplanten Stürmen wohl klarkommen werden:

„Die Zunahme extremer Wettereinflüsse habe auch Auswirkungen auf die Energieversorgung: Claudia Kemfert vom Deutschen Institut für Wirtschaftsforschung sagte, dass die Anfälligkeit für Naturkatastrophen steigen werde, weil Deutschland in den kommenden vier Jahrzehnten den Anteil der erneuerbaren Energien auf 80 Prozent erhöhen wolle. Die Windgeschwindigkeit beispielsweise werde zeitweise geringer, dann wieder stärker als bisher. Das sei für die Windkraftanlagen problematisch, sagte Kemfert. Extreme Stürme könnten die Stromleitungen beeinträchtigen. Die Zunahme extremer Wetterphänomene bringe die Energiewende zwar nicht in Gefahr, aber man müsse sich auf eventuelle Ausfälle vorbereiten.“

Zeit für einen Faktencheck

Es wäre also in der Tat nicht ganz unwichtig zu wissen, was da in den kommenden Jahren und Jahrzehnten auf uns zukommt. Also: Zeit für einen Faktencheck. Um es noch einmal zu betonen: Bei fast allen der oben skizzierten Aussagen handelt es sich um theoretische Projektionen für die Zukunft. Da man bei virtuellen Welten aber nie so ganz sicher sein kann, sollte sich ein jeder Modellierer verpflichtet fühlen, die Eckwerte seiner Berechnungen mit der Realität abzugleichen. Wenn man im Artikel des Standard zur oben genannten Golfstrom-Studie schmökert, bekommt man eine erste Ahnung davon, dass ein solcher Arbeitsschritt wohl notwendig ist:

„Meteorologen und Ozeanologen in aller Welt müssen sich nun Gedanken machen, wie sensitiv ihre Modelle sind. Denn trotz Übereinstimmungen im Verhältnis zwischen den Änderungen im Ozean und in der Atmosphäre weichen die einzelnen Modelle im Ergebnis teilweise stark voneinander ab.“

Ganz so toll scheint es also doch nicht zu passen. Eine Grundcharakteristik der theoretischen Rechnungen scheint zu sein, dass ein wärmeres Klima in den Computermodellen auf komplexe Art und Weise eine Steigerung der Sturmtätigkeit in mittleren Breiten hervorruft. Ein durchaus legitimer Ansatz könnte man meinen, warum auch nicht. Bevor man nun jedoch sehr viel Arbeitszeit und riesige Forschungsgelder in die Ausarbeitung dieser Arbeitshypothese steckt, sollte man zuvor noch einen wichtigen Plausibilitäts-Check durchführen.

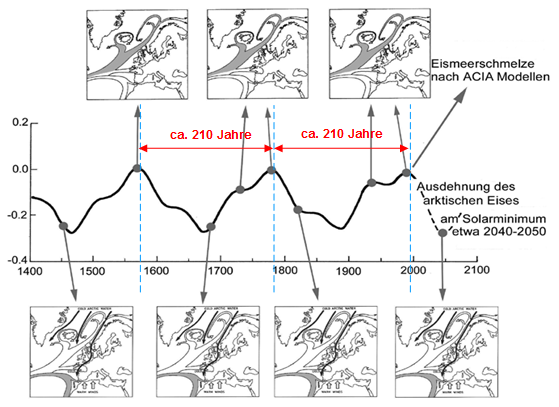

Und der liegt eigentlich auf der Hand: Wenn warme Temperaturen mehr Stürme in unserer Region produzieren, dann müsste es zu kälteren Zeiten doch entsprechend windstiller gewesen sein. Dabei mangelt es nicht an geeignetem Fallbeispiel-Material für diese Überprüfung: Während der Kleinen Eiszeit, die von 1400 bis 1850 andauerte, lag die Temperatur um etwa ein Grad unter dem heutigen Niveau. Also eigentlich doch kein Problem. Man nehme ein paar Studien über die Sturmhistorie der letzten 400 Jahre und los geht’s. Man möchte meinen, dass die diversen Sturmintensivierungs-Vertreter diesen simplen Plausibilitäts-Check doch sicher durchgeführt haben. Oder etwa nicht?

Die traurige Wahrheit: Gerade diesen Arbeitsschritt hat man offenbar ausgelassen. Wir wollen uns daher nützlich machen, und den Check hier nachholen.

Im Juli 2012 berichteten wir an dieser Stelle über die stürmische Vergangenheit der französischen Mittelmeerküste. Ein französisches Forscherteam um den Geologen Pierre Sabatier hatte untersucht, wie sich Stürme und Erderwärmung in der Region historisch zueinander verhalten haben. Das überraschende Resultat der Studie: Die Stürme traten bevorzugt in Kälteperioden auf. Die Sonnenaktivität spielte dabei eine wichtige Rolle: Immer wenn die Sonne schwächelte, wurde es kalt und stürmisch. Wenn die Sonne wieder aufdrehte, stiegen die Temperaturen und der Wind flaute wieder ab (siehe unseren Blogartikel „Wann gab es die schlimmsten Stürme an der französischen Mittelmeerküste? Immer wenn die Sonne schwächelte und die Temperaturen fielen!“). Hierzu passt eine Studie des Science & Public Policy Institutes (SPPI), das zusammen mit CO2Science Frankreichs Sturmentwicklung während der letzten Jahrhunderte analysierte. Unter anderem nahmen sie dabei auch den Golf von Aigues-Mortes an der Mittelmeerküste unter die Lupe. Die beiden sturmreichsten Phasen ereigneten sich hier 455 n. Chr. sowie 1700-1900 n. Chr., also während der Kälteperioden der Völkerwanderungszeit sowie der Kleinen Eiszeit.

Ganz offensichtlich suggerieren hier die theoretischen Modellierungsbemühungen etwas, was es in der Realität gar nicht gegeben hat. Die Sturmreichen Phasen Europas fielen nämlich die Kältephasen, wohingegen die Stürme in den warmen Zeiten abebbten.

Eine ähnliche Situation finden wir in den Niederlanden. Auch hier war die Kleine Eiszeit sehr viel sturmreicher als die nachfolgende Wärmephase (siehe unser Blogartikel „Die kräftigsten Stürme gab es in Holland während der Kleinen Eiszeit“). Hiermit kompatibel ist eine neue Studie von Stephen Cusack von Risk Management Solutions, die im Juni 2012 im Fachmagazin Climate Change erschien. Cusack konnte zeigen, dass die Stürme in den Niederlanden einem etwa 50-Jährigen Zyklus folgen und derzeit in einer Rekordflaute stecken, die es in den letzten 100 Jahren in dieser Art noch nicht gegeben hat. Die Studie wurde u.a. auf Spiegel Online und notrickszone besprochen.

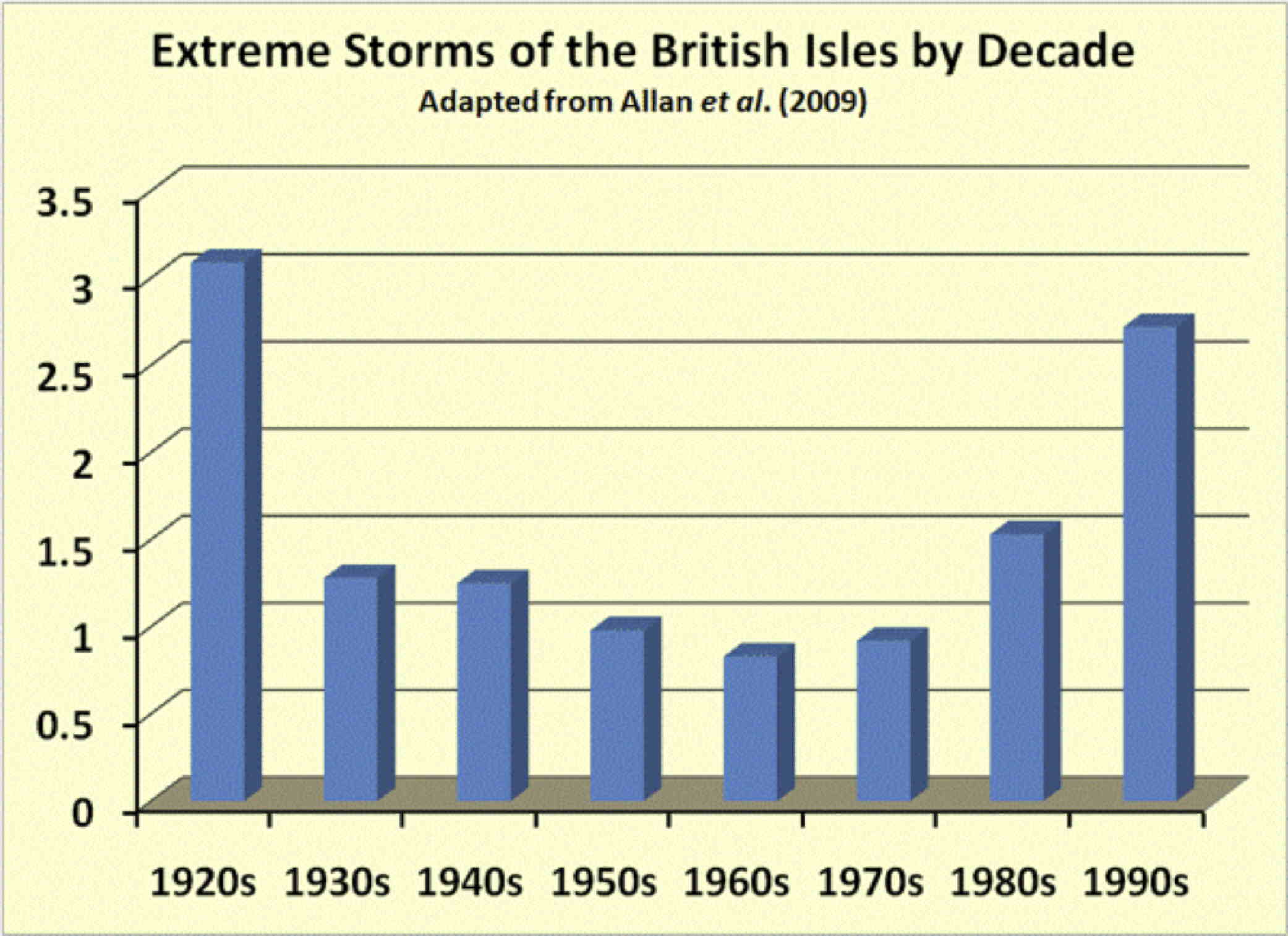

Auch für Großbritannien gibt es einen Überblick zur historischen Sturmentwicklung. Eine entsprechende Studie wurde im Mai 2012 von SPPI und CO2Science veröffentlicht. Während des 20. Jahrhunderts traten in dieser Region zwei besonders sturmreiche Phasen auf, nämlich in den 1920er und 1990er Jahren. Da diese Sturm-Maxima zu ganz unterschiedlichen Temperaturniveaus entstanden, kann die Klimaerwärmung hier offensichtlich keinen Einfluss genommen haben. Schaut man zudem in Großbritannien in Richtung Kleine Eiszeit, so wüteten auch hier die allerschlimmsten Stürme während dieser natürlichen Kältephase.

Abbildung 1: Entwicklung von sehr starken Stürmen auf den Britischen Inseln im 20. Jahrhundert. Quelle: SPPI nach Allan et al. (2009)

Keine Zunahme von Stürmen in Europa

Aber die Modellierer sind nicht nur in die Warm-Kalt-Falle getappt. Wenn man schlimme Stürme für die Zukunft vorhersagt, müsste man doch auch in den letzten 40 Jahren diesen Trend bereits bemerkt haben, denn dies soll ja die Zeit gewesen sein, wo Treibhausgase angeblich die Temperatur fast im Alleingang ein halbes Grad nach oben gedrückt haben.

Klaus-Eckart Puls hat sich durch Pressemitteilungen und Medienartikel gewühlt, um herauszufinden, ob die verschiedenen wissenschaftlichen Stellen in Deutschland schon einen solchen Anstieg der Sturmtätigkeit bei uns registriert haben (siehe Berichte auf EIKE und Schmanck). Das Ergebnis fällt deutlich aus: Nein, einen Trend zu stürmischeren Zeiten ist derzeit weit und breit nicht in Sicht.

Olaf Stampf schrieb im Spiegel 2007 in seinem Artikel „Abschied vom Weltuntergang“:

Unbegründet ist wohl auch die weitverbreitete Befürchtung, dass im Treibhausklima Superstürme mit nie dagewesener Wucht die Dörfer und Häuser verwüsten werden. Aus den gegenwärtigen Langzeitsimulationen lässt sich ein solcher Trend jedenfalls keinesfalls ableiten. “In unserem Computermodell brauen sich weder mehr Stürme noch stärkere Stürme über uns zusammen”, versichert Jochem Marotzke, Direktor des Hamburger Max-Planck-Instituts für Meteorologie, eines weltweit führenden Zentrums der Klimaforschung. “Nur die Zugbahnen der Tiefdruckgebiete ändern sich geringfügig – in Skandinavien wird es stürmischer, am Mittelmeer etwas ruhiger.”

Auf der Webseite der Wirtschaftswoche lesen wir:

Dass beispielsweise Stürme weltweit zugenommen hätten, kann Hans von Storch vom Meteorologischen Institut der Universität Hamburg und selbst Autor für den Weltklimarat, nicht bestätigen. „Bei der Anzahl von Taifunen in Asien, Polarstürmen und Starkwinden über der Nord- und Ostsee hat unser Team für die vergangenen Jahre keine Zunahme festgestellt“, sagt von Storch. Auch in den nächsten 20 Jahren werde der Anstieg so gering sein, dass er nicht einmal messbar sei.

Der Deutsche Wetterdienst (DWD) berichtete am 21.12.2009 in einer Pressemitteilung: Insgesamt ist laut DWD im vergangenen Jahrzehnt [2000-2009] aber keine Zunahme der großräumigen Stürme festzustellen. Zwei Jahre zuvor hatte die Organisation am 22.1.2007 in einer Pressemitteilung bereits erklärt: “Betrachtet man die Stürme und Orkane der letzten 30 Jahre, so hat bislang weder deren Häufigkeit noch deren Intensität zugenommen“.

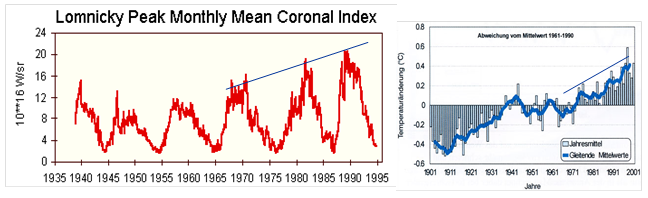

Zum gleichen Ergebnis kommt eine Untersuchung von Helmut Kraus und Ulrich Ebel: In den letzten 200 Jahren hat es über dem Nordatlantik ein ständiges Auf-und-Ab der Sturm-Aktivitäten gegeben. Selbst die extreme Orkan-Häufigkeit um 1990 wurde schon deutlich früher um 1890 sowie um 1915 übertroffen. Ein Klima-CO2-Signal ist dabei bis heute nicht erkennbar: “…daß die Intensität der Stürme in der Deutschen Bucht einer natürlichen Multidekadenschwankung unterliegt, aber in den letzten 120 Jahren keinerlei mit einer Klimaänderung zusammenhängenden Trend zeigt“.

Auch das Helmholtz-Zentrum Geesthacht hat Interessantes herausgefunden, wie das Institut in einer Pressemitteilung vom 16.9.2012 verbreitete:

Wissenschaftler am GKSS-Forschungszentrum Geesthacht haben gezeigt, daß die Häufigkeit von polaren Wirbelstürmen im Nord-Atlantik, so genannten Polartiefs, im Zuge der globalen Erwärmung abnehmen kann.

Eine Frage an alle Versicherungsmitarbeiter, Extremwetterforscher und Medienschaffende, die weiterhin eine Zunahme der Stürme in Deutschland und dem Rest Europas favorisieren: Wie redlich ist es eigentlich, die in diesem Beitrag angeführten Gegenargumente einfach so zu ignorieren? Wäre es nicht endlich an der Zeit, sich ernsthaft mit den Einwänden zu beschäftigen?

Mit Dank an Klaus-Eckart Puls für Materialbereitstellung.

Weitere Papers zur Sturmdiskussion gibt es auf Popular Technology.net

Dr. Sebastian Lüning; zuerst erschienen bei Die Kalte Sonne