So ist im Zeit-online-Interview auf die Frage, dass im Sommer nichts auf die Rekordschmelze hindeutete, von Herrn Prof. Rahmstorf zu erfahren: “Das stimmt: 2007 gab es ein langes, stationäres Hochdruckgebiet über der Arktis, das viel Sonne brachte. Das war in diesem Jahr nicht der Fall, das Wetter war durchwachsen.“ Damit die Personen in Presse und PIK nicht weiter im Dunkeln tappen und den Durchblick erhalten, erhellt der folgende Bericht die Szenerie und gibt die Antworten, warum in 2012 die arktische Sommereisschmelze so hoch ausfällt und wagt einen Blick in die Zukunft.

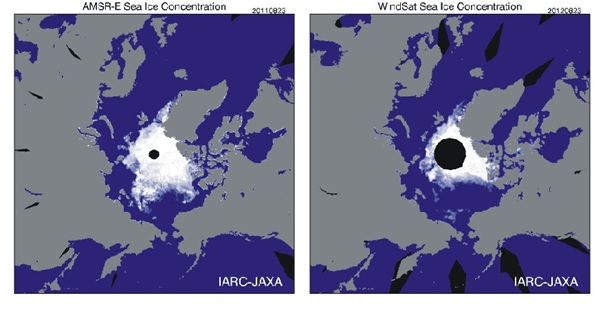

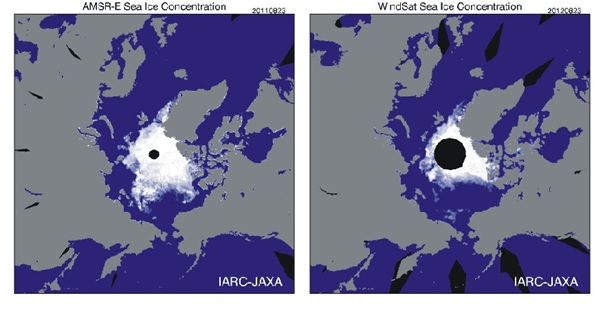

Abbildung 1 zeigt die arktische Eisbedeckung vom 28.08.2012 (rechts) und dazu im Vergleich, die arktische Eisbedeckung am 28.08.2011 (links). Deutlich weniger Eisbedeckung ist in diesem Jahr zu erkennen. Gleiches Bild zeigt die arktische Eisentwicklung.

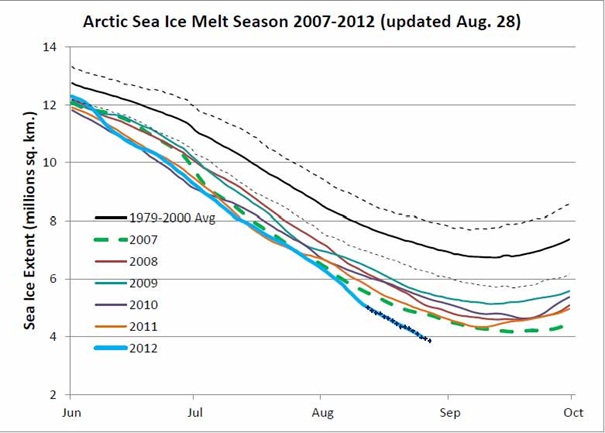

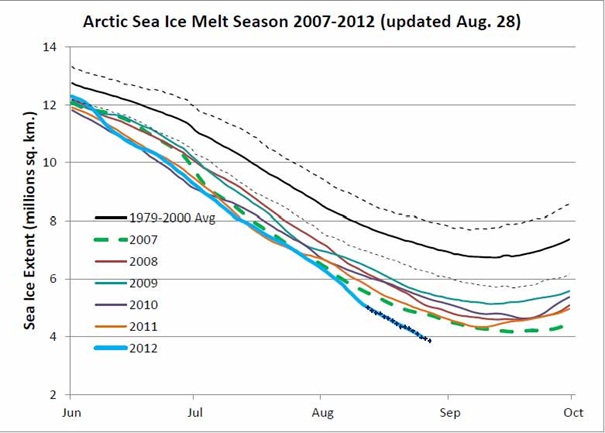

Abbildung 2 zeigt die arktische Eisentwicklung 2012 zum bisherigen Rekordminimum der letzten 30 Jahre von 2007, Datenquelle: NSIDC (National Snow Ice and Data Center).

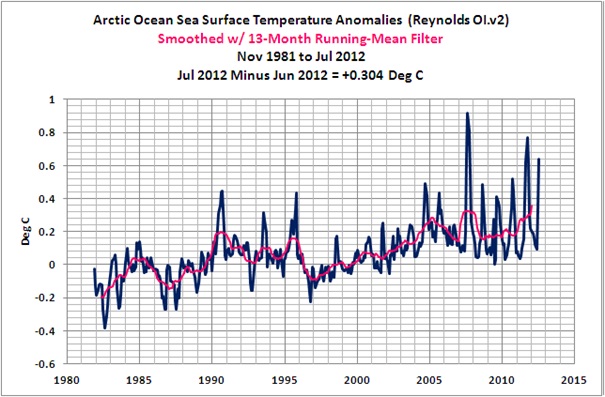

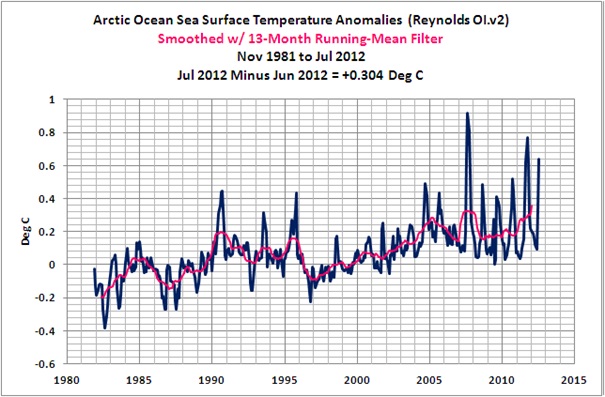

Da die Aggregatzustände von Wasser bekannt und gleich sind, muss es eine oder mehrere Ursachen für die starke Sommereisschmelze in 2012 gegenüber dem bisherigen Minimum in 2007 geben. Da es sich beim arktischen Eis um schwimmendes, also gefrorenes Eis handelt, sollen zuerst die arktischen Meerestemperaturen (deren statistisches Mittel – bei all solchen Darstellungen, auch denen des IPCC, handelt es sich immer um statistisch gemittelte Werte, da es physikalisch keine Globaltemperatur, als auch keine arktische Temperatur gibt) betrachtet werden.

Abbildung 3 zeigt die Anomalien des Arktischen Meeres von November 1981 bis Juli 2012. Die arktischen Wassertemperaturen sind gegenwärtig zwar hoch, erreichen aber nicht die Werte von 2007. Hier sind wir nicht wirklich fündig geworden. Wie sieht es bei den arktischen Temperaturen aus, die das Eis verstärkt schmelzen lassen können.

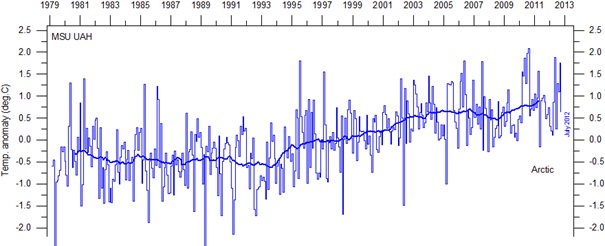

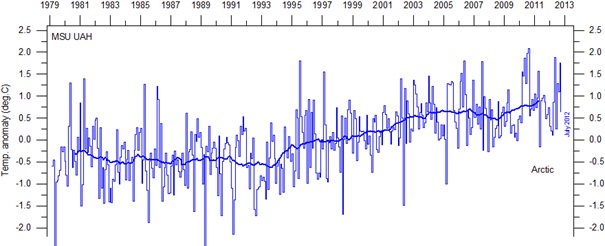

Abbildung 4 (Quelle: Climate4you.com) zeigt die arktischen Temperaturschwankungen. Sie liegen etwa auf gleicher Höhe wie 2007. Also ein Grund für eine hohe Eisschmelze, aber nicht höher als 2007. Demnach auch nicht der Grund.

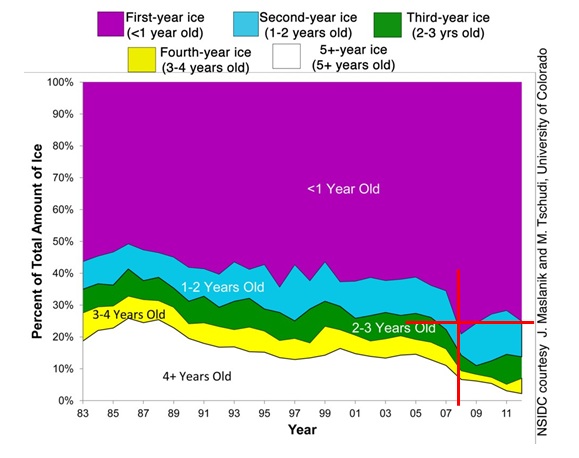

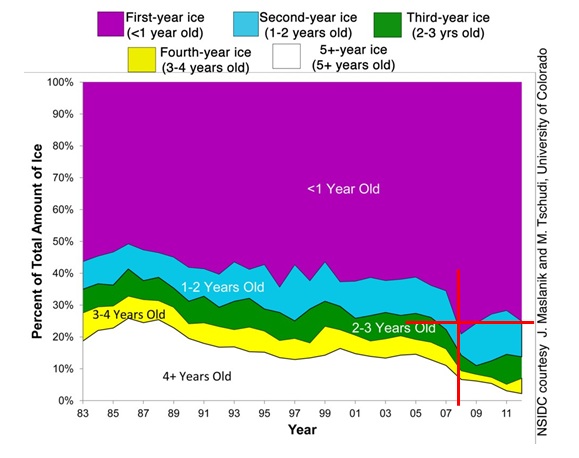

Nun hat Eis unterschiedliche Schmelzpunkte, was auf den im Eis eingebauten Salzgehalt zurückzuführen ist. So schmilzt einjähriges Eis schneller, als mehrjähriges.

Abbildung 5 zeigt die Eisentwicklung nach verschiedenen Altersklassen. Auch von dort keine Unterstützung, dass einjährige Eis, welches am schnellsten schmilzt, hat 2012 keine geringeren Werte als im Sommer 2007.

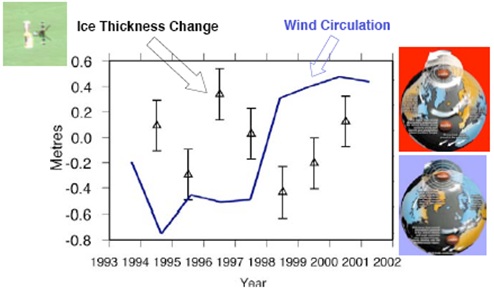

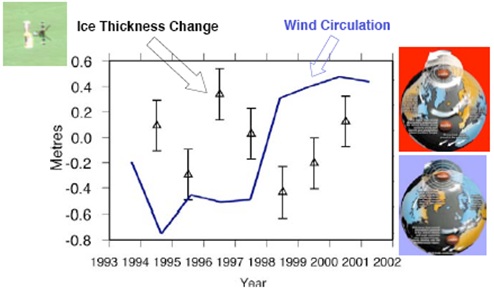

Nun ist die Eisschmelze auch von der Winddrift und damit von der Arktischen Oszillation (AO) abhängig, wie Prof. Dr. Seymor Laxon bereits vor fast 10 Jahren herausfand (Abbildung 6)

Abbildung 6 zeigt die Eisanomalien zur Windzirkulation (AO), Quelle: “Are the Ice caps melting?“ Prof. Seymor Laxon.

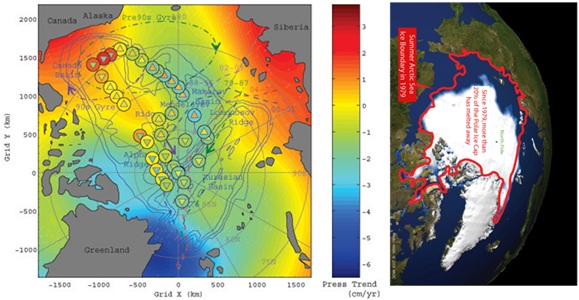

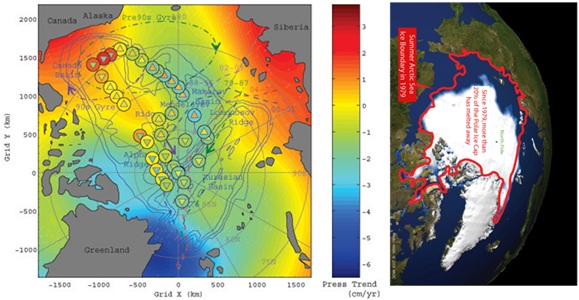

Weitere Forscher um Prof. Dr. James Morison (Polar Science Center – PSC) stellten fest, dass die arktischen Meeresströmungen, angetrieben durch Luftmassenzirkulationen, die Verteilung von Wärme und Salzgehalt verändern. Die AO (Arktische Oszillation) steht dabei in direktem Zusammenhang mit der Meereisbedeckung. James Morison: "The winter of 2006-2007 was another high Arctic Oscillation year and summer sea ice extent reached a new minimum." Das Forscherteam um James Morison fand weiter heraus, dass sich (durch die geänderten Meeresströmungen) der Salzgehalt der arktischen See seit 2002 deutlich geändert hat (Abbildung links).

Abbildung 7 links zeigt die Trendkonturen des Druckes der arktischen See im Zeitraum von 2002 – 2006, verglichen mit dem Referenzwert der 1990-Jahre. Der Druck steht im direkten Zusammenhang mit dem Salzgehalt, weil die Änderung des Wasserdrucks durch die im Wasser gelösten Stoffe – Salz – bestimmt wird. D.h. eine Erhöhung des Druckes ist gleichbedeutend mit einer äquivalenten Erhöhung des Salzgehaltes – je höher der Druck, desto höher der Salzgehalt. Die Messungen entstanden mit GRACE. GRACE ist ein Gemeinschaftsprojekt der NASA und des DLR (Deutsches Zentrum für Luft- und Raumfahrt). Die Abbildung rechts zeigt die sich veränderte Eisbedeckung im Zeitraum von 1979 – 2005, wobei die Eisschmelze in den 2000-Jahren vergleichsweise hoch ausfiel, Quelle: NASA. Werden beide Abbildungen miteinander verglichen, wird sofort ersichtlich, dass die Regionen, die eine hohe Eisschmelze zu verzeichnen haben, überwiegend auch die Regionen sind, in denen sich der Salzgehalt des Meerwassers erhöht und damit der Schmelzpunkt des Eises herabgesetzt wurde, d.h. die Eisschmelze bereits bei tieferen Temperaturen eintritt, bzw. bei höheren Temperaturen verstärkt stattfindet, mit einer großen Eisschmelze in der Fläche.

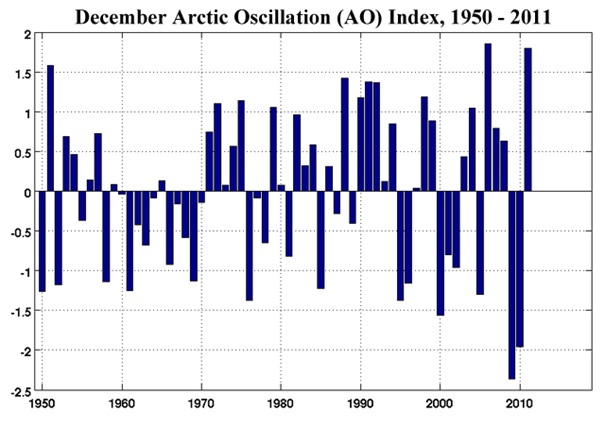

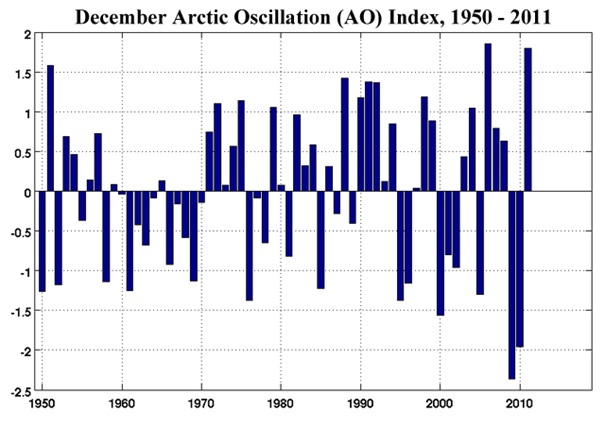

Schauen wir uns daher den Kandidaten, der von den Forschern genannt wurde und unmittelbar mit der arktischen Eisentwicklung zu tun hat, die AO, genauer an. Prof. Morison sagt uns dabei auch, worauf zu achten ist – auf eine stark positive Winter-AO vor der Sommereisschmelze.

Die AO ist der Luftdruckgegensatz zwischen den arktischen und den mittleren Breiten auf der Nordhemisphäre. Sie entsteht durch die großen Temperaturunterschiede zwischen den sehr kalten Polarregionen und den gemäßigten mittleren Breiten. Wie der Name schon sagt, handelt es sich um zyklische Änderungen (Oszillation). Die AO bestimmt die arktischen Wettersysteme. Bei einer negativen AO liegt über dem Pol ein starkes Hoch und dadurch bedingt entsteht ein schwacher Polarwirbel. Die sich entwickelnden Winde werden aufgrund der Corioliskraft nach Osten abgelenkt. In der positiven Phase treiben im Winter starke Westwinde die warme Atlantikluft nach Nordeuropa und Sibirien.

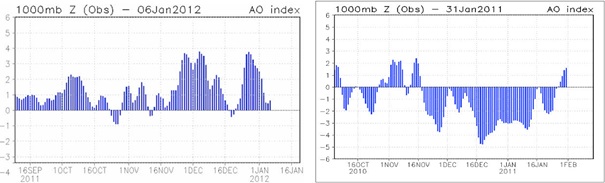

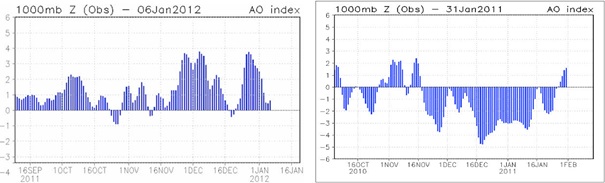

Abbildung 8 zeigt die Winter AO im Zeitraum von 1950 bis Dezember 2011. Dabei ist festzustellen, dass die AO ausgesprochen stark ist, so stark, wie die Winter AO vor dem letzten Rekordminimum in 2007. In 2011 war die AO dagegen stark negativ. Schauen wir noch genauer hin.

Abbildung 9 (Quelle: NASA Science News vom 19.01.2012) zeigt die Entwicklung der Winter AO von 2011/2012 zum Vorjahr. Deutlich ist zu sehen, dass diese vor der jetzt anstehenden Rekordeisschmelze ausgesprochen positiv ausgeprägt war.

Zwischenergebnis: Mit der AO wurde ein Parameter identifiziert, der für die starke Sommereisschmelze verantwortlich ist und dies war bereits im Dezember 2011 absehbar!

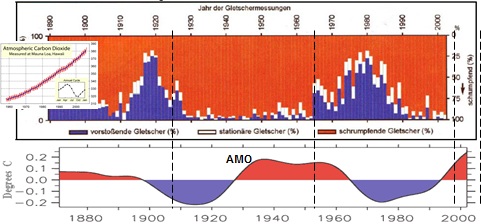

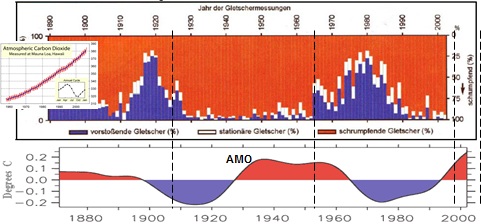

Gibt es weitere Kandidaten, die die Eisschmelze bestimmen und für die gegenüber 2007 nochmals verstärkte Sommereisschmelze verantwortlich ist? Von der Gletscher- und Eisentwicklung in unseren Breiten ist bekannt, dass diese von der AMO moderiert wird (Abbildung 10). Die AMO gibt die Wasseroberflächentemperaturen (deren Abweichungen) im Nordatlantik an.

Abbildung 10 zeigt die zyklische Entwicklung der österreichischen Gletscher von 1890 – 2002, Quelle: Slupetzky, 2005, Uni Salzburg. Gut erkennbar, dass der derzeitige Rückzug auf einen längeren Eisvorstoß folgt und das in den Jahren von 1930 bis in die 1960-Jahre, ähnlich geringe Eisbedeckungen vorlagen, wie heute. Der Gletscherzyklus zeigt weiter sehr starke Ähnlichkeiten mit der AMO und keine mit einem CO2-Atmosphärenpegel (kleines Bild). Daher soll die AMO an den arktischen Parametern gespiegelt werden.

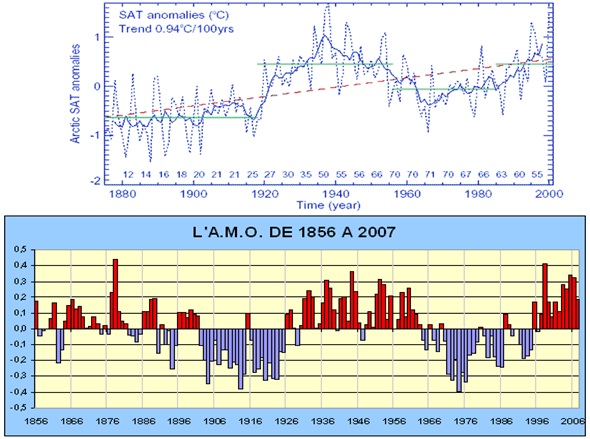

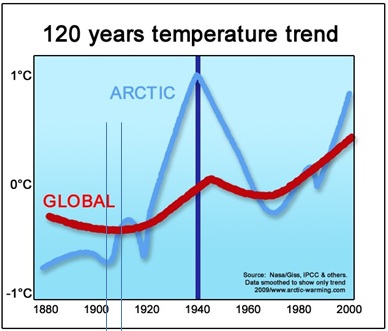

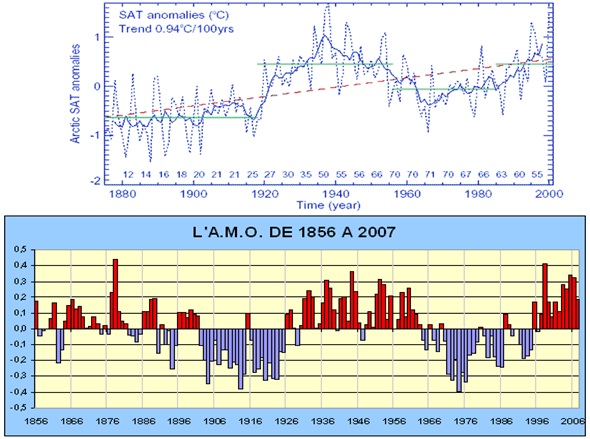

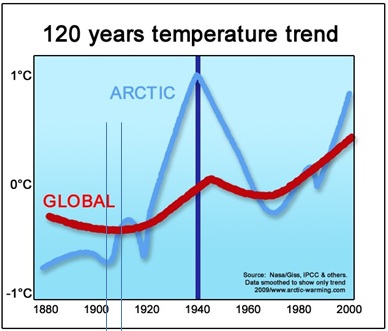

Abbildung 11, zeigt die arktischen Lufttemperaturen von 1880 – 2000 und darunter die trendbereinigte AMO. Deutlich zu sehen, dass sich die arktischen Temperaturen im Gleichklang zur AMO (Quelle: http://la.climatologie.free.fr/amo/amo-index.gif) entwickeln.

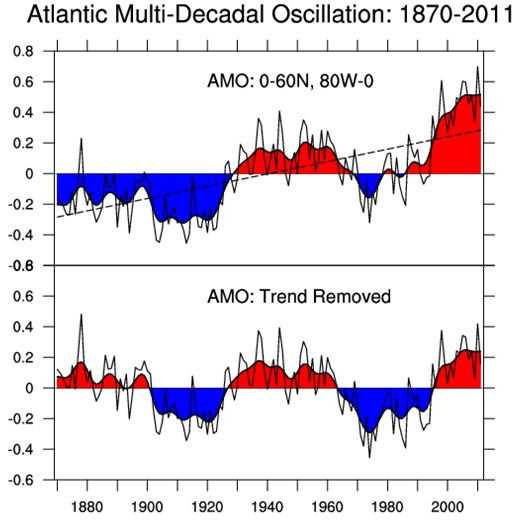

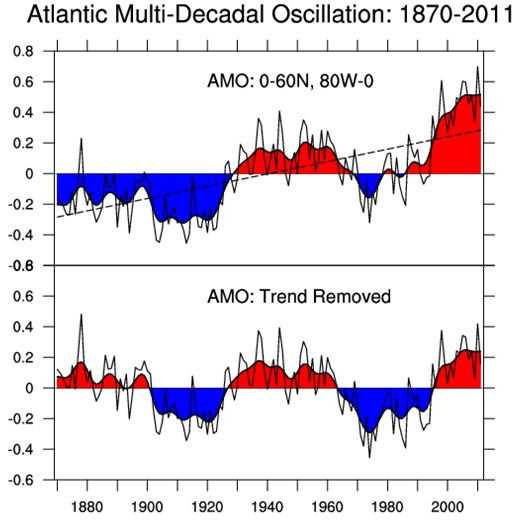

Für die jetzige Eisschmelze ist es notwendig, die gegenwärtige AO und zwar die reale und die trendbereinigte zu betrachten.

Abbildung 12 (Quelle: http://www.ncl.ucar.edu/Applications/Images/index_amo_1_lg.png) zeigt die reale AMO (mit Trend) und die trendbereinigte. Deutlich ist zu sehen, dass die AMO derzeit ihr Maximum anstrebt. Doch, woher kommen die Trends und die Schwingung, die die AMO nach Beginn des 20. Jahrhunderts steil ansteigen lässt? Der Autor gab bereits in seiner 8-teiligen EIKE-Serie “Dynamisches Sonnensystem – Die tatsächlichen Hintergründe des Klimawandels“ vom August 2011 die Antwort. Der Trend basiert auf dem Hauptsonnenzyklus, den im Mittel 208-jährigen de Vries/Suess-Zyklus, der um 2003 sein Maximum hatte und etwa 100 Jahre davor, sein Minimum, was sich in der AMO widerspiegelt. Wie sehr er die arktische Eisbedeckung bestimmt, zeigt Abbildung 14.

Auf http://www.ozeanklima.de/ ist hierzu folgendes zu lesen: “In den späteren Jahren der 1930er Dekade waren so warm wie die erste Dekade nach dem Jahr 2000. Nach 30 Jahren Abkühlung ab 1940, setzte der Erwärmungstrend seit 1980 wieder ein. War es eine Fortsetzung der Erwärmung, die mit dem Klimaknall im Januar 1919 begonnen hatte?“ Und dazu die folgende Abbildung zu sehen.

Abbildung 13 zeigt die globale und arktische Temperaturentwicklung seit 1880 nach GISS. Deutlich zu sehen, dass die globalen Temperaturen um 1910 und die arktischen um 1900 zu steigen beginnen. Dies ist exakt der Zeitpunkt, zu dem der Hauptsonnenzyklus sein Minimum verlies und wieder ansteigt und somit sowohl die globalen, als auch die arktischen Temperaturen ansteigen lässt – der Anstiegstrend beginnt. EIKE-Leser wissen mehr und kennen nun auch den Grund für den Anstieg.

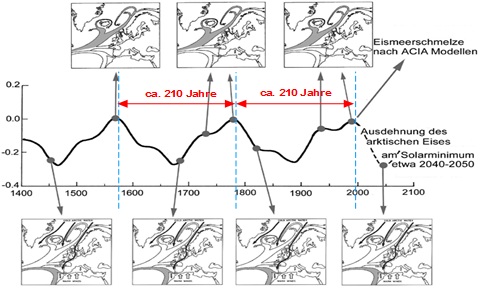

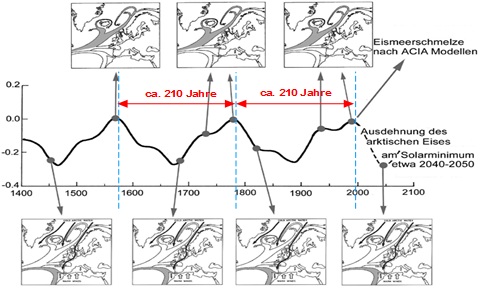

Abbildung 14: Natürliche Schwankungen auf die Meeresströmungen im Nordatlantik und somit auf den Golfstrom, zeigt die Abbildung, Quelle: Dr. Axel Mörner, “Keine Gefahr eines globalen Meeresspiegelanstiegs“. Die Abbildung wurde vom Autor um den de Vries/Suess-Sonnenzyklus (Zeiten) ergänzt. Zu sehen ist die arktische Eisentwicklung in Verbindung mit den vorherrschenden Meeresströmungen in Relation zum Hauptsonnenzyklus (de Vries-Suess-Zyklus). Sowohl die arktische Eisbedeckung, als auch das Muster der Meeresströmungen folgt dem im Mittel 208-jährigen de Vries-Suess-Zyklus. Bei Sonnenminima erleben Nordwesteuropa, der Nordatlantik und die Arktis Kaltphasen.

Woher stammt indes die Schwingung der AMO von ca. 35 Jahren? Das AWI, Prof. Dr. R. Gerdes, hierzu: "Seit Mitte der 90er Jahre haben wir einen starken Temperaturanstieg im Bereich des Nordatlantiks und des Nordpolarmeers. Das ist zum Teil Folge einer natürlichen oszillierenden Entwicklung, die Perioden von 60, 70 Jahren hat. Da sind wir jetzt in einer warmen Phase."

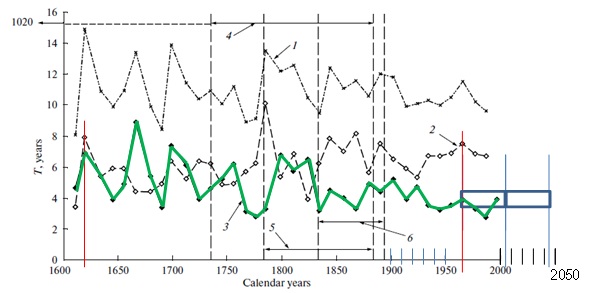

Diese Schwingung stammt ebenfalls von der Sonne und zwar vom Brückner-Zyklus der Sonne, der exakt diese Schwingung hat, wie Abbildung 15 zeigt.

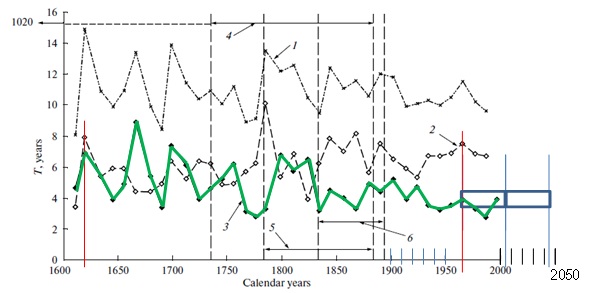

Abbildung 15 (Quelle: Halberg et al., “Thirty-Five-Year Climatic Cycle in Heliogeophysics“) zeigt den Brückner-Zyklus (grün) anhand der zeitlichen Variabilität der Wolfs-Zahl (Sonnenfleckenzahl). Ausgewertet wurden die Daten von Brückner, 1890 (4), Egeson, 1889 (5), und Lockyer, 1901 (6). Der Autor hat die mittlere Zykluslänge im Untersuchungszeitraum (gekennzeichnet durch die beiden roten Linien) ermittelt und an das letzte Maximum des Brückner-Zyklus angesetzt, um auf diese Weise statistisch die Folgemaxima zu ermitteln (blaue Rechtecke). Wie zu sehen, hatte der Brückner-Zyklus um 2005 sein letztes Maximum. Jetzt verwundert es auch nicht mehr, warum Europa 2003 einen Jahrhundert-Hitzesommer erlebte. Gleich drei starke Sonnenzyklen hatten seinerzeit ihr Maximum, der Hauptsonnenzyklus (de Vries/Suess-Zyklus), der Brückner-Zyklus und die magnetische Aktivität im Schwabe-Zyklus. Die Maxima gleich drei solarer Zyklen, die zudem auch noch stark ausgeprägt waren, fielen zu Beginn des Jahrhunderts zusammen, was seit Beginn der Sonnenfleckenaufzeichnungen um 1610 nicht stattfand und wohl letztmalig während dem Klimaoptimum des Mittelalters stattfand (verlässliche Daten über die Sonnenfleckenzahl aus dieser Zeit liegen dem Autor nicht vor, daher das „wohl“).

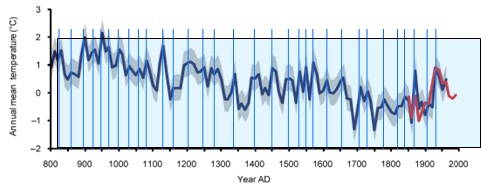

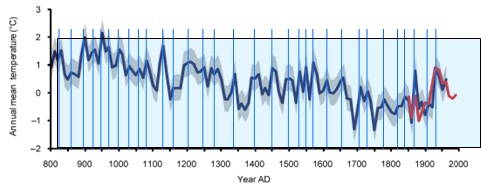

Wie dominant der Brückner-Zyklus die klimatischen Bedingungen in der Arktis, die Warm-und Kaltphasen und damit die Eisausdehnung bestimmen, zeigt ein Blick auf 1.200 Jahre Klimageschichte.

Abbildung 16, Quelle: Fredrik Charpentier Ljungqvist, Stockholm University, “A regional approach to the medieval warm period and the little ice age“, zeigt Temperaturschwankungen aus Eisbohrkerndaten in Grönland (blau) und von Messungen an der Westküste Grönlands (rot) im Zeitraum von 800 – 2000 (grau: Standardabweichung). Zu sehen ist ein heftig gezacktes Muster, in dem sich relative Minima und relative Maxima abwechseln. Werden z.B. die Maxima gekennzeichnet (blaue Linien), sind im Betrachtungszeitraum 31 volle Perioden von ca. 850 – 1935 abgebildet (der nächste also 1970 und er darauf folgende 2005!!! Vergleiche mit Abbildung 15). Daraus ergibt sich eine mittlere Zykluslänge von exakt 35 Jahren, was dem Brückner-Zyklus entspricht. Temperaturspitzen wechseln sich im Mittel alle 35 Jahre ab. Während des Klimaoptimums des Mittelalters sind die Zyklen eng zusammen, gleich wie heute, wogegen sie zu dessen Ausgang und während der Kleinen Eiszeit deutlich länger werden, was ein sicherer Parameter, für eine schwache Sonnenaktivität ist. So versuchen IPCC-nahe Wissenschaftler vergeblich, die Kleine Eiszeit nicht mit der variablen Sonne in Verbindung zu bringen. Wie am Brückner-Zyklus gezeigt, ein Versuch, der aussichtslos ist.

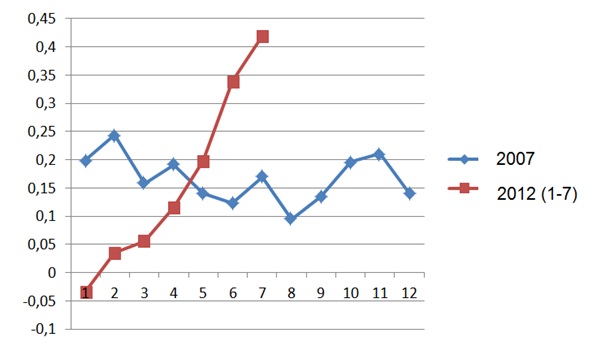

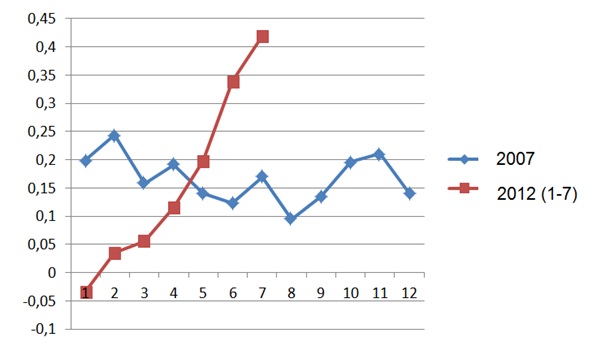

Nach diesem Exkurs, welche Parameter die AMO und damit unser Wetter und Klima, sowie die arktische Sommereisschmelze bestimmen, zurück, wie sich die AMO in 2012 entwickelte. Abbildung 12 zeigt die AMO bis 2011 und in der schwarzen Zeitreihe, dass sie gerade am Fallen ist, was natürlich der Begründung für die jetzige starke Sommereisschmelze entgegenstünde. Daher soll die AMO in 2012 betrachtet werden und im Vergleich dazu, in 2007. Die Daten stammen von (http://www.esrl.noaa.gov/psd/data/correlation/amon.us.data).

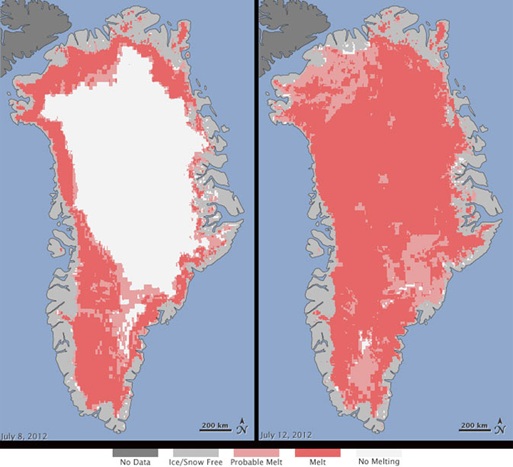

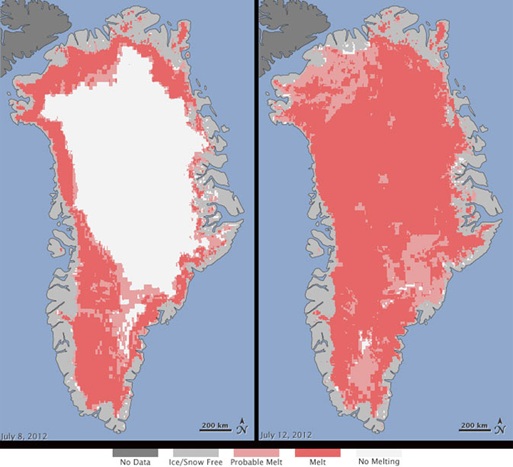

Abbildung 17 zeigt die AMO von Januar bis Juli 2012 im Vergleich zur AMO in 2007. Die AMO-Werte von 2012 laufen den Werten von 2007 regelrecht davon. Während die AMO in 2007 gar fällt, was auf das seinerzeit dort vorliegende Hoch zurück zu führen ist (siehe Zeit-online Interview mit Prof. Rahmstorf) und dem damit verbundenen schwachen atmosphärischen Polarwirbel, steigt in 2012 die AMO raketenartig an, was schnell und stark ansteigende Temperaturen in der Arktis bedeutet, vor allem in Grönland, dass sozusagen vor der „Haustür“ der AMO liegt. So braucht es niemanden zu verwundern, wenn die Presse solche Bilder brachte, die zeigen, dass zeitweise große Areale der grönländischen Eisdecke an geschmolzen waren.

Abbildung 18 zeigt zwei Momentaufnahmen der grönländischen Eisbedeckung vom Juli 2012. Damals fabulierte die deutsche Presse, dass 97% des grönländischen Eis schmilzen, was blühender Unsinn ist, da lediglich die oberste Schicht kurz an schmolz (Wasser gemessen wurde). Warum dem so war, wissen die EIKE-Leser nun.

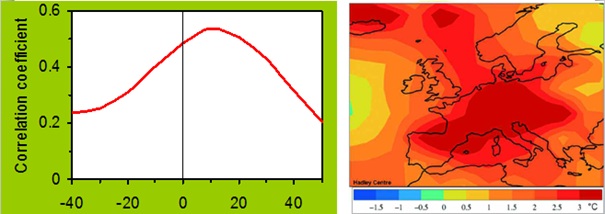

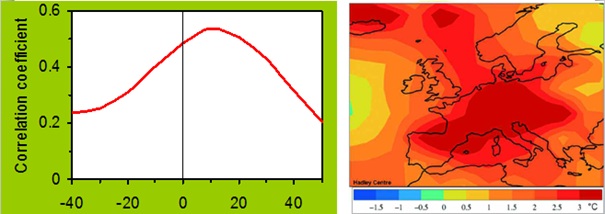

Der Autor ist unseren Lesern noch die Beantwortung einer wichtigen Frage schuldig. Warum die arktische Eisschmelze mit dem Maximum der AMO gerade jetzt so ausgeprägt ist? Die Antwort stammt aus der Untersuchung von Prof. Solanki (Max Planck Institut für Sonnenforschung, MPS) “Solar activity over the last 1150 years: does it correlate with climate”. Er ermittelte, dass das Klimasystem der Erde der solaren Aktivität um 10 Jahre nachläuft – die Sonnenaktivität dem Klima um 10 Jahre vor eilt. Was in erster Linie auf die Trägheit und Wärmekapazität des Wassers zurückzuführen ist.

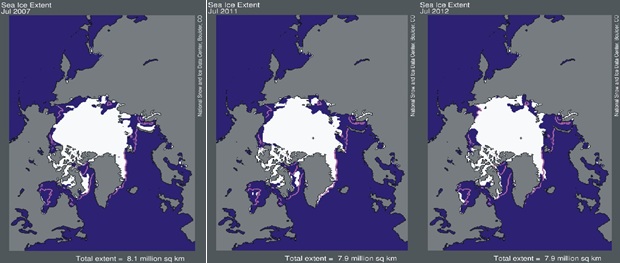

Abbildung 19 links zeigt den Nachlauf des Klimasystems zur Sonnenaktivität (Quelle: Solanki et al.). Die Abbildung rechts, den Hitzesommer von 2003 (Quelle: Hadley Center). Während die solare Aktivität auf die Lufttemperaturen und damit Bodentemperaturen unmittelbar wirkt, wirkt sie auf das die Wassertemperaturen und das Klima verzögert, nach Solanki et al. mit einem Nachlauf von 10 Jahren. Die AMO wechselte 1995 in ihre positive Phase, die ca. 35 Jahre andauert. Daraus ergibt sich, dass sie um 2012/2013 ihr Maximum erreicht, was die Zeitreihen der AMO belegen. Ihr Einfluss auf die Eisschmelze wird anschaulich, wenn im Vergleich die Jahre 2007, 2011 und 2012 betrachtet werden (Abbildung 20).

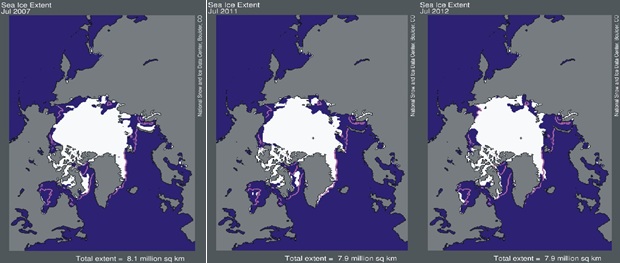

Abbildung 20 zeigt die arktische Sommereisbedeckung (Juli) für 2007 (links), 2011 (Mitte) und 2012 (rechts). Gegenüber dem bisherigen Rekord in 2007 sind in 2012 vor allem die Gebiete östlich und westlich von Grönland betroffen, also die Gebiete, die unmittelbar vor der „Haustür“ der AMO liegen. Was den Unterschied zu 2007 ausmacht.

So wird auch die Aussage der russischen Wissenschaftler Dr. habil. Genrich Alexejew, Forschungsinstituts für Arktis und Antarktis (St. Petersburg) zur arktischen Eisschmelze 2012 verständlich: “Der sommerliche „Rückzug“ der Eisdecke im Nordpolarmeer erfolge außerdem nicht gleichmäßig. Die für Russland transportrelevanten Meeresgebiete seien im laufenden Jahr sogar stärker als gewöhnlich mit Eis bedeckt. In der Kara-, Laptew-, Tschuktschen- und Ostsibirischen See sei die Eisdecke beispielsweise stärker als im Jahr 2007“ (Quelle: http://german.ruvr.ru/2012_08_31/86793871/). Und weiter “Die langjährigen Beobachtungen des Petersburger Arktis-Instituts belegen zyklische Schwankungen im Klimasystem des Planeten: Im Abstand von ungefähr 60 Jahren erleben die atmosphärischen Vorgänge und die damit zusammenhängende ozeanische Zirkulation eine Neugestaltung. Derzeit geht eine Erwärmungsphase laut Forschern zu Ende (der vorhergehende Wärme-Höhepunkt war in den 1930er und 1940er Jahren zu beobachten). Die Natur dieser Zyklen ist vorerst nicht ganz klar – ebenso wie die Gesetze, nach denen das Weltmeer lebt.“ EIKE-Leser ist dies klar und sie können diese Zyklen und ihren Einfluss nun beantworten.

Ergebnis:

Zusammenfassend ist festzuhalten, dass die Rekordeisschmelze 2012 auf eine starke AO, wie in 2007 (Abbildung 8) zurückzuführen ist und ihr Minimum gegenüber 2007 auf die steil ansteigende, positive AMO zurückzuführen ist (Abbildung 17), was bereits in 12/11, bzw. spätestens 05/12 absehbar war.

So viel zu den eingangs geschilderten Meinungen und Aussagen eines PIK-Professors. Aber, dass es sich beim PIK mehr um ein Wiederentstanden des Orakels von Delphi, als um eine Wissenschaftseinrichtung handelt, hatte der Autor bereits in seinem EIKE-Artikel “Prognosen des Meeresspiegelanstiegs und was sie wert sind“ (http://www.eike-klima-energie.eu/klima-anzeige/prognosen-des-meeresspiegelanstiegs-und-was-sie-wert-sind/) gezeigt. Der Autor schloss seinen EIKE-Artikel mit den Worten. “Insofern bewegen sich diverse Regierungen/politische Programme und deren (pseudo)wissenschaftliche Helfer, auf einer Stufe mit der Weltanschauung der Maya-Kultur und die diversen Klimaprognosen auf derselben Ebene wie die Vorhersagen der keltisch/germanischen Druiden oder der antiken Orakel. Unsere Vorfahren benutzten die Innereien von Tieren, um die Zukunft zu ergründen. Gänseleber und Krötenblasen waren sehr beliebt. Heute werden wieder Innereien benutzt, um in die Zukunft zu blicken. Es sind die BYTES und FLOPS der Supercomputer – mit demselben Ergebnis.“ Mit Wissenschaft hat all dies nichts zu tun.

Die Wissenschaft sucht nach Fragen und strebt danach, diese Fragen zu beantworten und zu beweisen. Herr Prof. Rahmstorf weiß davon offensichtlich nichts. Er ist jedoch in einem Alter, in dem es nicht abwegig ist, an den verdienten Ruhestand zu denken. In Anbetracht seiner gezeigten Leistungen im Zeit-online Interview, eine echte Alternative. Bei der Süddeutschen und beim ZDF fällt dem Autor spontan ein, dumm, dümmer, ZDF.

Warum viele deutsche Journalisten so verpicht darauf sind, sich als Halbwissende auszuzeichnen, vermag der Autor nicht zu beantworten. Möglicherweise hat dies etwas mit der Tradition des deutschen Journalismus zu tun. In Deutschland gab es mal Zeiten, in denen die Journalisten von Amts wegen die Dummheit verbreiteten und damit als Verstärker dienten. In Ostdeutschland ist dies noch nicht so lange her, etwas mehr als 20 Jahre. In Westdeutschland, etwas länger – mit dem Unterschied zu heute (wie Heute-Journal), dass sie dies jetzt freiwillig tun wie beim Heute-Journal (Frau Reidt ).

Raimund Leistenschneider – EIKE