Die deutsche Energieratlosigkeit!

Es gibt eine schöne Geschichte in den Abenteuern von Tim und Struppi des belgischen Zeichners Hergé. Beide sind zusammen mit Kapitän Haddock Gefangene auf einem Schiff, das explosives Material geladen hat. Auf hoher See bricht ein Feuer aus. Kapitän, Offiziere und Mannschaft springen voller Panik in die Rettungsboote und rudern mit aller Kraft weg von dem gefährlichen Schiff. In sicherer Entfernung warten sie auf die große Explosion. Doch nichts passiert. Eine große Welle hat das Feuer gelöscht. Die beiden Helden, Haddock und Tim, bringen das Schiff wieder in Fahrt und dampfen davon. Zurück bleibt eine wütende, ungläubige Besatzung mit ihrem hasenfüßigen Kapitän, allein auf dem weiten Ozean. Diese Comicepisode passt zu der Art und Weise, wie Deutschland auf die Ereignisse in Fukushima nach dem zerstörerischen Tsunami im März reagierte. Die Bundesregierung mit Kanzlerin Merkel an der Spitze, Politiker aller Parteien und ein großer Teil des Wählervolks hatten augenblicklich die Hosen voll und warfen alles über Bord, was zuvor in der Kernenergie als verlässlich gegolten hatte. Es herrschte blanke Panik. Jetzt – nach einem halben Jahr – sieht man: Panik ist ein schlechter Ratgeber. Fukushima hat sich nicht zu der atomaren Massenvernichtung ausgewachsen, die so viele in Deutschland erwartet hatten. Frau Merkel und ihr Volk sitzen nun in ihrem kleinen Boot und müssen den anderen – bioenergetisch angetrieben – hinterher hecheln. Zurück geht es nicht, dann müssten die Politiker zugeben, dass sie noch ängstlicher als die Bevölkerung waren, die sie vertreten. Und vorwärts, da ist es ungewiss. Da liegt eine Zukunft, bestimmt von ineffizienten und unzuverlässigen Energiequellen.

Weshalb haben andere Regierungen nicht so panikartig reagiert? Sie waren gelassener und dürften wohl Folgendes bedacht haben:

Die Havarie der Reaktoren von Fukushima 1 war Folge eines Jahrhundertbebens und eines Jahrtausend-Tsunamis. Alle KKW in der betroffenen Region, einschließlich Fukushima 1, haben das starke Beben ohne größere Schäden überstanden. Es war die 14 Meter hohe Tsunamiwelle, welche die Reaktoren von Fukushima 1 ausgeschaltet hat. Auslöser war also ein extremes Naturereignis.

Den Tsunami hätte die Anlage ohne größere Schäden überstehen können, wenn die Betreiber bestimmte Vorkehrungen getroffen hätten. [1] In den deutschen KKWs sind entsprechende Einrichtungen vorhanden, wie die Reaktorsicherheitskommission (RSK) in ihrer von der Bundesregierung initiierten Sicherheitsprüfung feststellte: Alle deutschen Kernkraftwerke weisen gegenüber Fukushima zusätzliche Sicherheitseinrichtungen sowie große Sicherheitsmargen auf, die einen Unfallablauf wie in Japan verhindern würden. Sie verfügen z. B. über verbunkerte, gegen Einwirkungen von außen geschützte Notstromeinrichtungen und sind so robust ausgelegt, dass sie das 100.000-jährige Erdbeben und das 10.000-jährige Hochwasser am jeweiligen Standort überstehen können. Der schwere Unfall in Fukushima 1 war also nicht naturgesetzlich unausweichlich und unvermeidlich. In Fukushima sind vier der sechs Reaktoren von der Katastrophe betroffen; bei drei von ihnen ist die Kernschmelze eingetreten. Für die deutsche Öffentlichkeit war dies der „Supergau“. Tatsache aber ist: Der Atomunfall ist nicht die Megakatastrophe, wie man sie in Deutschland erwartete und wie einige sie vielleicht auch gerne gehabt hätten: „Bis heute liegen keine Berichte vor, dass Menschen gesundheitliche Schäden als Folge von Strahlenbelastungen davongetragen hätten“, schreibt die Internationale Atomenergiebehörde in ihrem vorläufigen Bericht vom Juni des Jahres. [2]

Merkel aber hat nicht abgewartet. Sie legte bereits zwei Tage nach dem Reaktorunfall sieben Reaktoren in Deutschland still – eine absolut unangemessene und nicht begründbare Panikreaktion. Sie hat das Land damit auf einen abenteuerlichen Kurs gebracht, der noch viele Hunderte von Milliarden Euro kosten wird. Alle Parteien und große Teile der Bevölkerung sind bestürzend schnell und willig auf Atomhysterie und Energiewendejubel eingeschwenkt. Ebenso die Medien. Gegenstimmen waren und sind kaum zu hören.

Der Sonderweg

Der deutsche Sonderweg funktioniert nur mit viel Selbsttäuschung. Fukushima habe gezeigt, so der parteiübergreifende Konsens, dass die Kernenergie prinzipiell nicht zu beherrschen sei. Woran macht man das fest? An der Anzahl der havarierten Reaktoren in Fukushima, die trotz Riesenwelle und unzulänglichen Sicherheitseinrichtungen eben nicht „durchgegangen“ sind? Ist Kernenergie tatsächlich „die gefährlichste Technologie aller Zeiten“, wie das Hamburger Abendblatt im Juni schrieb? Was ist dann mit dem Straßenverkehr, der Jahr um Jahr weltweit eine Million Tote fordert? Darf man, wie ein Leitartikler in der Rheinzeitung, von der „menschenverachtenden Atomwirtschaft“ sprechen? Ist das nicht der geistige GAU, der größte anzunehmende Unsinn?

Angela Merkel begründete den Atomausstieg damit, dass im Falle eines Unfalls wie in Fukushima die Folgen „so verheerend und weitreichend [seien], dass sie die Risiken aller anderen Energieträger bei weitem übertreffen.“ Die vielen Toten im Kraftwerk Fukushima kann sie nicht meinen. Die gibt es nicht und wird es auch nicht geben. Meint sie den wirtschaftlichen Schaden durch die Zerstörung des Kraftwerks? Der dürfte sich in der Größenordnung des volkswirtschaftlichen Verlustes bewegen, der durch die Schnellstilllegung der deutschen Reaktoren und den endgültigen Ausstieg entsteht. Oder die Auswirkungen auf die Evakuierungszone um das Kraftwerk? Etwa 80.000 Menschen haben das Gebiet verlassen, Opfer der Strahlenkrankheit gab es nicht. Die frei gesetzten Radionuklide sind sehr ungleich verteilt. Eine beträchtliche Menge konzentriert sich dreißig Kilometer nordwestlich des Kraftwerks, während im größten Teil der evakuierten Zone die Strahlung sich schon im Mai nahe dem Normalwert bewegte. Im Januar nächsten Jahres, so damals die japanische Regierung, könne man vielleicht über eine Rückkehr der evakuierten Menschen entscheiden. [3] In Deutschland sieht man das anders: So war in der FAZ am 11. Juni über Fukushima zu lesen: „Millionen Menschen evakuiert, fast tausend Quadratkilometer Land auf unabsehbare Zeit unbewohnbar.“ [4] Eine derartige Panikmache hatte man bislang den Lobbyisten von Greenpeace überlassen. Das ist schließlich deren Broterwerb.

Inzwischen, Stand vom Juli, setzt die Anlage nur noch den zweimillionstel Teil an radioaktivem Material frei wie auf dem Höhepunkt der Krise am 15. März. Steht man heute direkt an der Kraftwerksgrenze, kann man mit einer maximalen Strahlenbelastung aus der Luft von 1,7 Millisievert pro Jahr (mSv/a) rechnen. Zum Vergleich: Die durchschnittliche Belastung durch die natürliche Hintergrundstrahlung liegt im globalen Mittel bei 2,4 mSv/a. Problematisch sind die Radionuklide, die sich am Boden abgesetzt haben. Etwa 95 Prozent des im März freigesetzten radioaktiven Materials bestanden aus Jod-Isotopen, die aufgrund ihrer geringen Halbwertzeit inzwischen nahezu verschwunden sind. Geblieben ist Cäsium-137, das in vielen Gebieten der evakuierten Zone Jahresdosen von mehr als 20 mSv liefert. 20 mSv ist die Dosis, die Arbeiter in einem Kernkraftwerk pro Jahr erhalten dürfen. Etwa so hoch ist auch die Dosis, die ein Patient bei einer einmaligen Computertomographie erhält. Zudem gibt es eine Reihe von Regionen auf der Erde, wo die natürliche Strahlung aus dem Boden erheblich höher ist – ohne gesundheitliche Schäden für die Bewohner. Soviel zur Unbewohnbarkeit auf unabsehbare Zeit. In Deutschland ist man sehr faktenresistent. Gemessen an den Auswirkungen, die tatsächlich in und um Fukushima zu beobachten sind, sind die hiesigen Katastrophenszenarien grotesk überzeichnet.

Was lässt sich wirklich lernen?

Gibt es etwas Positives an der Reaktorkatastrophe von Fukushima? Ja. Man kann daraus lernen – genauso wie aus Harrisburg und Tschernobyl. Die teilweise Kernschmelze im amerikanischen Kraftwerk TMI bei Harrisburg 1979 gilt als GAU, was eigentlich nur ein Auslegekriterium für den Bau eines Kernkraftwerks darstellt, im Mythenschatz der Kernenergiegegner aber für „größtmögliche Katastrophe“ steht. Und das Ergebnis? Am Reaktor war Totalverlust zu verzeichnen, aber es gab kein Strahlenopfer, kein Mensch wurde geschädigt, weder im Kraftwerk noch außerhalb davon. Vernachlässigbar geringe Mengen an radioaktivem Material gelangten in die Umgebung. Wenn man so will, war das Unglück von TMI ein unfreiwilliges, aber erfolgreiches Experiment, das die Wirksamkeit der Sicherheitseinrichtungen belegte. Wenige Jahre später, im sowjetischen Tschernobyl, kam es zum Supergau, zur „größtgrößtmögliche Katastrophe“. Ein Reaktor explodierte in vollem Betrieb und schleuderte große Mengen an radioaktivem Material in die Atmosphäre. Über die Folgen wird und wurde wüst spekuliert und übertrieben. Lobbyvereine wie Greenpeace sprechen (immer noch) von 100.000en, ja von Millionen Opfern. Tatsächlich liegt die Zahl der Opfer drastisch niedriger, nachzulesen in einer von der UNO veröffentlichten Studie: etwa 50 direkte Tote in der Anlage, einige tausend zusätzliche Krebserkrankungen. Das ist schlimm, liegt aber im unteren Bereich möglicher Zivilisationsrisiken. Und Fukushima? Zeigt dieser Unfall tatsächlich, wie etwa die Grünen meinen, die prinzipielle Unbeherrschbarkeit der Kerntechnik? Bei unaufgeregter Betrachtung lässt sich aus dem „ungewollten Großexperiment“ Fukushima allerdings ein anderer Schluss ziehen: vier havarierte Reaktoren, drei Kernschmelzen – trotzdem, wie gerade bilanziert, kein Megadesaster. Das war keine glückliche Fügung, das lag in der Natur der Dinge: Die Gesetze von Physik und Chemie geben einfach nicht mehr Katastrophe her. [5]

Amerikanische Kernphysiker sind auf diese grundlegende (und beruhigende) Einsicht bereits vor drei Jahrzehnten bei einer Nachbereitung des TMI- Unfalls gestoßen. Sie untersuchten ein „realistisches, aber sehr unwahrscheinliches Ereignis: die gleichzeitige Zerstörung von Systemen außerhalb der Containments, Risse in der Sicherheitshülle; eine Kernschmelze mit ungefilterter Freisetzung von radioaktivem Material“. Das klingt nach Fukushima. Und das Ergebnis dieser Untersuchung? „Selbst ein derartiges Ausnahmeereignis hätte, wenn überhaupt, nur wenige Todesfälle zur Folge. […] Die Freisetzung und die Ausbreitung radioaktiven Materials aus dem beschädigten oder geschmolzenen Brennstoff ist streng durch die physikalischen und chemischen Eigenschaften des Materials beschränkt.“ [6] Wie in Fukushima!

Lebenslüge Atomdesaster

Anfang Juni sagte Bundeskanzlerin Merkel in ihrer Regierungserklärung zur Energiewende, dass Fukushima ihre Haltung zur Kernenergie verändert habe. Ein Restrisiko könne sie nicht mehr akzeptieren. Auch andere haben ihre Haltung geändert, so George Monbiot, einer der prominentesten britischen Umweltschützer. So manchen Leser seiner wöchentlichen Kolumne im Guardian dürfte Monbiots Bekehrung, knapp zwei Wochen nach dem Tsunami, allerdings überrascht haben. „Als Folge des Desasters in Fukushima stehe ich der Kernenergie nicht länger neutral gegenüber. Ich befürworte jetzt diese Technologie.“ [7] Monbiot hat sich nicht aus ideologischen, sondern aus pragmatischen Gründen für die Kernenergie entschieden. Den engagierten Klimaschützer hat vor allem die Aussicht geängstigt, dass die Welt, insbesondere China, nun stärker wieder auf Kohle setzen werde – mit schlimmen Folgen: „In jeder Hinsicht (Klimawandel, Bergbau, lokale Umweltverschmutzung, Unfall- und Todeszahlen, Freisetzung von Radioaktivität)“, bilanziert Monbiot, ist Kohle hundertmal schlechter als Kernenergie.“ In mehreren Kommentaren erläuterte Monbiot seinen Sinneswandel, und er debattierte öffentlich mit Helen Caldicott, der globalen Ikone der Kernkraftgegner. Von ihr verlangte er Belege für die angeblich eine Million Tote durch Tschernobyl und andere gängige Horrorgeschichten. Erhalten hat er sie nicht. [8] Der grünen Bewegung wirft er vor, die Welt über die Gefahren radioaktiver Strahlung in die Irre zu führen. „Ihre Behauptungen […] haben keine wissenschaftliche Grundlage, halten Nachfragen nicht stand und sind fürchterlich falsch.“

Fürchterlich falsch sind auch die Annahmen, die der deutschen Energiewende zugrunde liegen: Es gab keine Strahlenopfer in und um Fukushima, und es wird keine auf immer unbewohnbare Todeszonen geben. Die deutsche Politik ignoriert diese positive Entwicklung, hält stattdessen am Erkenntnisstand vom März, ein paar Tage nach dem Tsunami, fest. Ausgangsniveau der Debatten, in denen Sozialwissenschaftler, Feuilletonisten und Ethiker den Ton angeben, ist immer noch die damals angenommene Megakatastrophe, die selbst die Bevölkerung Tokios dahinraffen könnte. Dass nichts von dem eingetreten ist, wird ausgeblendet. So funktionieren Lebenslügen. Lebenslügen müssen aufrechterhalten werden, damit man weiterleben kann. Bei manchen halten sie ein ganzes Leben, andere zerbrechen daran. Die deutsche Energiewende beruht auf der Lebenslüge „Atomdesaster Fukushima“.

Wie geht’s weiter?

Die Reaktorunfälle in Harrisburg und Tschernobyl hatten einschneidende Wirkung. Danach wurden nur noch wenige Kernkraftwerke gebaut, viele Ausbaupläne wurden auf Eis gelegt. Inzwischen sind allerdings wieder über 60 Reaktoren in Bau. Die Nachwehen von Fukushima sind verhaltener, sieht man einmal von dem „Hals über Kopf“-Ausstieg in Deutschland ab. Die Schweiz baut (vorerst) keine neuen Kernkraftwerke, lässt aber die vorhandenen laufen, Italien, das nie eingestiegen ist, will weiterhin auf Kernenergie verzichten und der vom japanischen Premier Kan vorgeschlagene Ausstieg irgendwann in der Zukunft stellt eine Privatmeinung dar. Andere Staaten haben ihre Ausbaupläne nicht aufgegeben. Im Mai empfahl der Council for Climate Change der britischen Regierung, außer den Erneuerbaren auch die Kernenergie weiter auszubauen. Sie, so der Rat, sei die effizienteste Methode der CO2- Vermeidung. China will bis 2020 60 neue Kernreaktoren in Betrieb nehmen (25 sind derzeit im Bau), Russland plant 35 Anlagen, unsere polnischen Nachbarn zwei Kernkraftwerke, die Niederlande und Litauen je eins. Südkorea wird vier Kernkraftwerke an die Vereinigten Arabischen Emirate liefern und will den eigenen Strombedarf bis 2030 zu über 40 Prozent mit Kernenergie decken. Gegenwärtig sind es 23 Prozent.

Die Liste ließe sich fortsetzen. Offensichtlich ist die Kernenergie kein Auslaufmodell. Analysten der britischen Economist Intelligence Unit, einer zur unabhängigen Economist Group gehörenden Beraterfirma, sehen ein „Jahrzehnt des Wachstums für die Kernenergie voraus, nur geringfügig beeinflusst durch den Fukushima-Unfall.“ Ihr im Juni veröffentlichter Bericht „The Future of Nuclear Energy“ trägt den bezeichnenden Untertitel „Ein Schritt zurück, zwei Schritte vorwärts“.

Deutschlands Energiewende ist emotionsgetrieben, aufgeladen durch die Angst vor Strahlung jeglicher Art. Dabei ist die Furcht größer als die tatsächliche Gefahr. Die Horrorvisionen, die selbst für niedrige Strahlendosen beschworen werden, stammen noch aus den Zeiten des atomaren Wettrüstens. [9] Was damals die Schrecken eines Nuklearkriegs aufzeigen sollte, haben die Grünen in ihren Mythenschatz übernommen und gegen die Kerntechnologie gewendet. Irrationale Ängste lassen sich damit einfach schüren und ausnutzen, wie die vergangenen Monate in Deutschland gezeigt haben. Ist es ethisch vertretbar, dass Politiker und Lobbygruppen zur Verfolgung eigennütziger Ziele weiten Teilen der Bevölkerung Angst einjagen? Merkels Ethikkommission hat dazu leider kein Wort verloren, im Gegensatz zu George Monbiot. Für ihn ist es eine moralische Frage: Darf man Menschen mit vollkommen übertriebenen Aussagen zu den Gefahren radioaktiver Strahlung in Angst und Schrecken versetzen? Man darf es nicht.

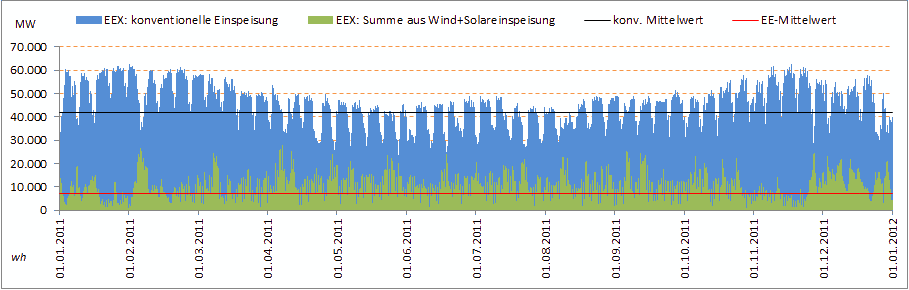

Weltweit arbeiten derzeit rund 450 Kernkraftwerke. Sie haben bislang etwa 64.000 Milliarden Kilowattstunden an Strom erzeugt. Dafür hätten sich, bei einer Lebensdauer von 20 Jahren pro Anlage, einige zehn Millionen Windräder drehen müssen. Durch den Nuklearstrom sind 15 bis 20 Milliarden Tonnen an Kohle in der Erde und einige 10.000 Bergleute am Leben geblieben. Rund 14 Prozent des Stroms werden weltweit durch Kernspaltung erzeugt, zwei Drittel durch Kohle und Gas. Kohle ist bei weitem der wichtigste Brennstoff für die Stromproduktion und wird es in den nächsten Jahrzehnten bleiben. Ohne die einheimische Kohle hätten die Milliardenbevölkerungen von China und Indien keine Aussicht, ihre im Schnitt immer noch ärmlichen Lebensbedingungen dem Niveau der reicheren Länder anzugleichen. Wenn man Kohle bei weltweit wachsendem Energiebedarf überhaupt ersetzen kann, wird dies nur allmählich geschehen, und zwar nicht durch Wind und Sonne. Der Ersatz von Kohlekraftwerken (die zuverlässig, effizient und damit billig Strom produzieren) durch Windräder und Solaranlagen (die teuren, nur unregelmäßig verfügbaren Strom liefern) ist eine Ausgabe, aber keine Investition. Davon profitieren einige wenige, aber die Mehrheit verliert. Diesen Luxus kann man sich in Deutschland (noch) leisten, aber nicht in China, Indien und anderen Ländern. Wohin wird sich also die Welt der Energie, realistisch gesehen, in den kommenden Jahrzehnten entwickeln? Sicher nicht in Richtung deutscher Energiewende. Das ist eine Sackgasse. Sie ist teuer, vernichtet Kapital und verschwendet Rohstoffe. Nur die effiziente Kernenergie kann die effiziente Kohleenergie ersetzen. Das wird dauern, denn die kerntechnische Industrie hat nach dreißig Jahren Auszeit viel an Substanz und Schwung verloren.

In gewissem Sinne beginnt die Kernenergie noch einmal neu – mit neuen Partnern und mit neuen Konzepten. Die Neuen im Geschäft sind China, Südkorea und Indien, sie dürften sich zu treibenden Kräften entwickeln. Korea zum Beispiel hat das Ziel, bis 2030 Kernkraftwerke für 400 Milliarden Euro zu exportieren. Schwer vorstellbar, dass Deutschland vergleichbare Summen mit Windrädern und PV-Anlagen verdienen kann. Nach technologischem Stillstand gibt es wieder Entwürfe und Planungen für neuartige Reaktoren. Es gibt neue Sicherheitskonzepte, passive Systeme, die auch funktionieren, wenn der Strom ausfällt und Reaktoren, die inhärent sicher sind, wo die Physik die Katastrophe von vornherein ausschließt. Inhärent sicher ist etwa der Hochtemperaturreaktor, den man in Deutschland schon einmal bis zum industriellen Prototyp entwickelt hatte. Chinesische Wissenschaftler bauen ihn nun neu. Er liefert nicht nur Strom, sondern auch Hochtemperaturwärme – ideal, um fossile Brennstoffe zu ersetzen. Mit seiner Energiewende hat sich Deutschland von diesen technologischen Entwicklungen und vom größten Teil der Welt abgekoppelt. Für einen solchen Sprung ins Ungewisse müsste es schon sehr, sehr gute Gründe geben. Das Reaktorunglück von Fukushima liefert diese nicht.

Anmerkungen

[1] Siehe Eike Roth: „Fukushima und was wir daraus lernen können. Versuch einer Bewertung nach 80 Tagen“ in: Energie-Fakten.de,, 1. 6.11 und IAEA: „International Fact Finding Expert Mission of the Fukushima Dai-ichi NPP Accident. Following the Great East Japan Earthquake and Tsunami: Mission Report“, 16. 7. 11, pub.iaea.org.

[2] Siehe auch J. Nakosko, T. Lazo: „Fukushima.“ NEA News, 2011, Nr. 29.1, oecd-nea.org. Die Autoren stellen u. a. fest, dass in dem Kraftwerk acht von 2400 Arbeitern eine Strahlendosis von mehr als 250 MilliSievert (mSv) erhalten haben. Und was ist mit der „radioaktiven Wolke“? Im Bezirk Ibaraki, auf halbem Weg zwischen Tokio und Fukushima, lag der Höchstwert bei 0,35 Mikrosievert (μSv) pro Stunde. Erreicht wurde er am 22. März. Hätte diese Belastung ein Jahr lang angedauert, wäre die Bevölkerung mit etwa 3 mSv belastet worden, soviel wie die durchschnittliche natürliche Hintergrundstrahlung, die jeder Mensch erhält.

[3] World Nuclear News: „Cold shutdown a must for Fukushima return“ in: World Nuclear News, 19.5.11 world-nuclear-news.org.

[4] Joachim Müller-Jung: „Atompolitik nach Fukushima. Die nukleare Selbstdemontage“ FAZ 25.6.11, faz.net. Jung leitet übrigens die Wissenschaftsredaktion der FAZ.

[5] Auch dem Chef-Wissenschaftler der britischen Regierung, Sir Beddington, war diese grundlegende Einsicht vertraut. Damit konnte er die versammelten Mitglieder der britischen Botschaft in Tokio davon überzeugen, dass eine Flucht aus der japanischen Hauptstadt unnötig wäre. Da hatten sich die Angehörigen der deutschen Botschaft in Tokio bereits nach Osaka abgesetzt. Siehe: Heinz Horeis: „Fukushima 1: Worst case scenario German angst“ NovoArgumente Online 18.3.2011

[6] radscihealth.org/RSH/Realism/WP-Annex1.htm. An dieser Untersuchung war neben amerikanischen Forschungszentren auch das Kernforschungszentrum Karlsruhe beteiligt. Eine ausführliche Zusammenfassung durch milton levenson und frank rahn erschien 1981 in Nuclear Technology (Vol 53, May 1981). Das Papier wurde in die jeweilige Sprache aller Mitgliedsländer der Internationalen Atomenergiebehörde übersetzt. Ernsthafte Einwände gegen diese Ergebnisse gab es nicht.

[7] George Mobiot: „Going Critical“ The Guardian, 22 03.2011.

[8] monbiot.com/2011/04/04/evidence-meltdown/. Monbiot hat von Caldicott wissenschaftlich fundierte („peer reviewed“) Belege für 14 ihrer Horror-Behauptungen verlangt. Sie konnte keine ihrer Aussagen belegen.

Sehr lesenswert dazu die Korrespondenz.

[9] 1959 hat sich die Internationale Kommission für Strahlenschutz (ICRP) auf das LNT-Modell geeinigt (LNT ist die Abkürzung für „linear no threshold“). Es besagt, kurz gefasst, dass jede noch so geringe Strahlendosis gesundheitsschädlich ist. Die Summe mehrerer kleiner Strahlendosen hätte demnach die gleiche Wirkung wie eine einmalige große Dosis. In den Alltag übersetzt hieße das: An neun Tagen hintereinander jeweils 20 Minuten Sonnenbad zur Mittagszeit hätte die gleichen Folgen wie vier Stunden Sonnenbad am Stück. Namhafte Radiobiologen und Nuklearmediziner lehnen das LNT-Modell ab. Dagegen sprächen etwa Untersuchungen zur natürlichen Strahlenbelastung wie auch Erfahrungen aus der Strahlenmedizin. Siehe dazu zum Beispiel das Buch des britischen Nuklearmediziners wade allison, Radiation and Reason, 2009.

Heinz Horeis

Dieser Artikel ist zuerst in der aktuellen Printausgabe von NovoArgumente (#112 – II/2011) erschienen. Die Online-Version bei NovoArgumente finden Sie hier in drei Teile aufgeteilt.

Heinz Horeis ist freier Wissenschaftsjournalist. Mit dem Thema Energie befasst er sich seit der ersten großen Energiedebatte in den 1980er Jahren. Er ist Mitautor eines Buches über Strahlung und Radioaktivität, das jüngst in einen japanischen Verlag erschienen ist. Heinz Horeis prägte den Begriff “NIEs” für “Neue Ineffziente Energien”