Expertenbegutachtung” des ersten Entwurfs von AR 5, abgeschlossen am 10. [Februar]. Der erste Absatz meiner übermittelten Kritik lautet:

Mein Fachgebiet ist die Wirtschaft, wo wir mit dem, was Statistiker das „ausgelassene Variablen-Problem“ [=das problem nicht berücksichtigter Variablen] (oder wenn es mit Absicht passiert, „Betrug durch Auslassung“), sehr vertraut sind. Immer wenn eine aussagekräftige Variable aus einer statistischen Analyse entfernt wird, ergibt sich ein Missverhältnis zu den korrelierenden Variablen, die analysiert werden. Dieses Problem manifestiert sich auf höchster Ebene beim AR 5 und erscheint in jedem Schritt ihrer Analyse.

Wie jeder andere, der an dieser Begutachtung teilnimmt, habe ich zugestimmt, nichts aus dem Entwurf zu zitieren, zu benennen oder bekannt zu machen. Das IPCC forderte noch etwas, wofür man aber nicht die Zustimmung der Begutachter verlangt hatte, nämlich dass wir „die Inhalte des Entwurfs nicht in öffentlichen Foren wie z. B. Blogs diskutieren“.

Angesichts dessen, was ich gefunden habe – systematischen Betrug – wäre es unmoralisch, dieser Forderung, der ich nicht zugestimmt habe, zu entsprechen, und weil es in meinen Kommentaren darum geht, was ausgelassen worden ist, ist es einfach genug, den Betrug offen zu legen ohne aus dem Entwurf zu zitieren.. Meine gesamte Begutachtung (4700 Wörter) enthält nur ein halbes Dutzend Zitate, die hier ohne Weiteres ersetzt werden können durch Beschreibungen des gemeinten Materials. Zitierte Nummern der Abschnitte kann man ebenfalls leicht durch Beschreibungen der Dinge ersetzen, um die es geht. Hier folgt also mit Erlaubnis von Anthony Watts der Rest meines minimal veränderten Kommentars:Einführung zur Kritik am „Betrug durch Auslassung”

In der untersuchten Periode von 1750 bis 2010 korrelierten zwei Parameter sehr stark mit der beobachteten Erwärmung (und daher auch untereinander). Die magnetische Aktivität der Sonne und der atmosphärische CO2-Gehalt zeigten beide während dieser Periode nach oben, und beide erreichten wesentlich höhere Niveaus in der zweiten Hälfte des 20. Jahrhunderts. Diese beiden Korrelationen mit dem Temperaturanstieg führten zu den zwei wesentlichen, mit einander konkurrierenden Theorien zur Erwärmung im 20. Jahrhundert. Wurde er ausgelöst durch die rapide zunehmende menschliche CO2-Emission oder durch das 80-jährige „Große Maximum“ der Sonnenaktivität, die in den frühen zwanziger Jahren begonnen hat? (“Grand minima and maxima of solar activity: new observational constraints,” Usoskin et al. 2007.)

Die empirischen Beweise zugunsten der Sonne sind überwältigend. Dutzende wissenschaftlich begutachteter Studien haben einen sehr hohen Grad der Korrelation (0,5 bis 0,8) zwischen der solarmagnetischen Aktivität und der globalen Temperatur gefunden, und zwar bis viele tausend Jahre in die Vergangenheit (Bond 2001, Neff 2001, Shaviv 2003, Usoskin 2005 und viele andere, die unten gelistet sind). Mit anderen Worten, die Sonnenaktivität „erklärt“ im statistischen Sinne 50% bis 80% vergangener Temperaturänderungen.

Ein so hoher Korrelationsgrad über so lange Zeiträume impliziert Kausalität, die es nur in eine Richtung geben kann. Die globale Temperatur kann nicht die Sonnenaktivität beeinflussen, also muss es einen Mechanismus geben, wie die Sonnenaktivität globale Temperaturänderungen treibt oder moduliert. Der hohe Korrelationsgrad legt auch nahe, dass die Sonnenaktivität der Haupttreiber der globalen Temperatur in jedem untersuchten Zeitraum ist (was ziemlich genau jedem Zeitscale entspricht außer dem Milankovitch-Zyklus).

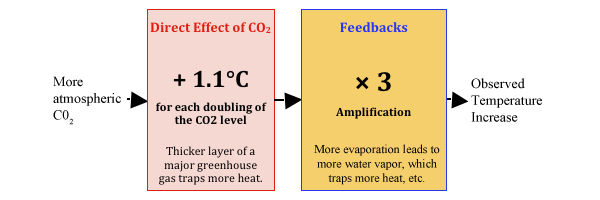

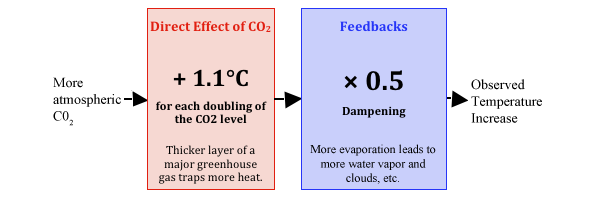

Im Gegensatz dazu zeigen Aufzeichnungen des CO2-Niveaus und der Temperatur keinen erkennbaren Erwärmungseffekt des CO2. Es gibt eine Korrelation zwischen atmosphärischem CO2 und der Temperatur, aber mit Änderungen des CO2-Gehaltes, die einer Temperaturänderung nachfolgen mit einer Zeitverzögerung von im Mittel 800 Jahren (Caillon 2003), was darauf hindeutet, dass es die Temperaturänderung ist, die über den atmosphärischen CO2-Gehalt bestimmt (was logisch erscheint, da sich erwärmende Ozeane weniger CO2 enthalten können). Dies schließt nicht aus, dass das CO2 auch die Temperatur treibt, und in der Theorie sollte eine Verdoppelung des CO2-Gehaltes eine Temperaturerhöhung um etwa 1 °C ergeben, bevor Rückkopplungseffekte einwirken, aber diese Rückkopplungen können auch negativ sein (Dämpfung anstatt Verstärkung eines Antriebs der Temperatur). Also gibt es nur mit dem, was wir über den Treibhausmechanismus wissen, keinen Grund anzunehmen, dass das CO2 ein signifikanter Mitspieler ist. Eines können wir sicher sagen, wie auch immer ein Erwärmungseffekt durch CO2 aussieht, er ist in den Rohdaten CO2 zu Temperatur nicht erkennbar.

Dies ist ein greller Gegensatz zur Sonnenaktivität, welche in den Rohdaten wie eine Neonlampe aufleuchtet. Es gibt buchstäblich Dutzende von Studien, die eine Korrelation von 0,5 bis 0,8 mit der Temperatur finden. Wie kommt es aber dann, dass die gegenwärtige Generation von GCMs des IPCC mit der Hypothese beginnen, dass das CO2 den Planeten seit 1750 40 mal so stark erwärmt hat wie die Sonnenaktivität? Das ist im AR 5 das Verhältnis der Abschätzung des Strahlungsantriebs für Variationen des CO2-Gehaltes und der Variation der gesamten Auswirkung der Sonnenaktivität zwischen 1750 und 2010, gelistet in (der Tabelle der RF-Antriebe im Kapitel über menschliche und natürliche Antriebe der Temperatur). RF für CO2 geht ein mit … W/m², während die RF des gesamtsolaren Effekts mit … W/m² eingeht. (ich werde nicht die aktuellen Zahlen nennen, aber ja, die Rate beträgt erstaunliche 40 zu 1, eine Steigerung von 14 zu 1 aus dem AR 4. Hierin wird der totale solare Antrieb mit 0.12 W/m² angegeben und 1,66 für CO2).

Man vermutet also, dass der 50%-Antrieb der globalen Temperatur, wie er sich aus Bergen von Temperaturkorrelationsdaten ergibt, lediglich zu 1/40 zur Erwärmung beiträgt im Vergleich zu etwas, dessen Erwärmungseffekt in den Temperaturaufzeichnungen nicht einmal ansatzweise erkennbar ist. Dies steht auf der Seite der Eingabe in die GCMs. Die Modelle nutzen ihre Gigaflops an Compuermacht nicht um herauszufinden, dass das CO2 einen viel größeren Erwärmungseffekt hat. Die Erwärmung wird einfach festgelegt. Müll rein – Müll raus [schwer zu übersetzendes Wortspiel: Garbage in – Garbage out].

Das „Wie” ist sehr einfach. Der 40 mal größere Erwärmungseffekt durch das CO2 beruht auf einem eklatanten Betrug durch Auslassung von Variablen. Wie ich vollständig zeigen werde, wird jeder Beweis für einen starken Antrieb der Sonnenaktivität einfach vom AR 5 übergangen. Von den zahlreichen sorgfältigen empirischen Studien, die eine hohe Korrelation zwischen der Sonnenaktivität und dem Klima zeigen, werden nur vage drei Studien erwähnt, und zwar in einem einzigen Satz des gesamten Erstentwurfs. Auf (Seite …, Zeile … im Kapitel über Aerosole und Wolken) gibt es eine kleine Referenz zu drei Studien, die nicht spezifizierte Korrelationen mit einigen Klimavariablen gefunden haben, ohne Erwähnung der dramatischen Größenordnung dieser Korrelationen oder einen Hinweis auf den Bereich und die Wiedergabe der Ergebnisse. Und das war’s! Nicht ein einziger weiterer Hinweis im gesamten Bericht. Jemand, der den AR 5 von vorne bis hinten durchliest, würde nicht einmal einen Hinweis darauf erhalten, dass es seit mehr als zehn Jahren eine veritable Flut von Studien gibt, die ergeben, dass die Sonnenaktivität etwa in der Größenordnung der Hälfte der Temperaturvariation in der Vergangenheit erklären kann, wenn nicht die gesamte Variabilität. Die Auslassung ist nahezu vollständig.

Als Folge wird fast die gesamte Erklärung der solarmagnetischen Aktivität zur korrelierten CO2-Variablen fehlinterpretiert. Diese Fehlinterpretation kann man sowohl in den analytischen Diskussionen im AR 5 finden als auch in den statistischen Abschätzungen und Projektionen, und der Fehler könnte keine größeren Konsequenzen haben. Sollte es die solarmagnetische Aktivität sein, die das Klima treibt, dann enthält das jüngste Abgleiten der Sonne in eine ausgeprägte Ruhephase das Potential einer fortwährenden globalen Abkühlung, möglicherweise rasch und durchgreifend; und anders als eine Erwärmung ist eine Abkühlung tatsächlich gefährlicher und kann sich selbst in eine Abwärtsspirale rückkoppeln.

Nichts könnte unter diesen Umständen perverser sein als die moderne Welt in einen abscheulichen Heiligen Krieg gegen das CO2 zu führen. Der Betrug des IPCC durch Auslassen muss aufhören. Die Fehlinterpretation von AR 5, die die Erwärmung im 20. Jahrhundert auf das CO2 zurückführt, muss aufhören. Die Beweise für die solarmagnetische Theorie sind überwältigend. Die einzige Unterstützung für die CO2-Theorie liegt in der Tatsache, dass die darauf beruhenden Modelle einigermaßen zu den letzten paar Jahrhunderten der Temperaturgeschichte passen, aber nur, weil das CO2 grob mit der Sonnenaktivität während dieser Periode korreliert, während sich die Modelle selbst durch ihren nachweislichen Betrug durch Auslassung selbst ungültig machen. Falls man die Erwärmung ganz auf solarmagnetische Effekte zurückführt, wie es die Beweise nahelegen, dann bleibt für die Erwärmung durch CO2 fast nichts mehr übrig.

Angesichts der fast mit Sicherheit sowohl substantiell größeren als auch in Richtung Abkühlung weisenden Auswirkungen [der Sonnenaktivität] im Gegensatz zu den CO2-Effekten ist er erwartete externe CO2-Wert eindeutig positiv. Wenn überhaupt, sollten wir die Zunahme des CO2-Gehaltes in der Atmosphäre subventionieren und vorantreiben. Das ist genau das Gegenteil dessen, was in der Eingangsbehauptung des AR 5 steht, nämlich dass Entwicklungen seit AR 4 „… (Zusammenfassung: Die Wissenschaftler sind sich sicherer denn je {vielleicht wegen des Fehlens jeglicher Erwärmung im 21. Jahrhundert?}, dass die Auswirkungen menschlicher Aktivitäten die hauptsächliche Klimasorge sind.)“

Als jemand, der die wissenschaftlichen Fehler in diesem katastrophalen Bericht erkennt, kann ich zumindest versichern, dass das Ganze ordnungsgemäß den Autoren des AR 5 unterbreitet wird. Folglich dokumentiere ich so prägnant wie möglich das Weglassen der solaren Magnetaktivität und die daraus resultierenden Irrtümer. Die Diskussion ist substantiell, aber ich bin unter der Grenze der Zeichenanzahl für einen einzelnen Kommentar geblieben. Dieser Kommentar wird als Kommentar auf höchster Ebene an AR 5 als Ganzes übermittelt, und er wird unverändert als Kommentar an die drei Unterkapitel geschickt, in denen der weggelassene solarmagnetische Beweis eigentlich erwähnt werden sollte: …, …, … (je ein Vorwort zu den Kapiteln über Paläodaten, über Wolken und Aerosole und den Strahlungsantrieb).

Ein Beispiel des weg gelassenen Beweises

Hier folgt eine Liste mit einigen der prominentesten und überzeugendsten Studien, die eine starke Korrelation zwischen der Sonnenaktivität und dem Klima gefunden haben, zusammen mit einer unvollständigen Sammlung ähnlicher Ergebnisse; insgesamt zwei Dutzend Erwähnungen. Es wäre einfach, zwei Dutzend weitere zu listen, aber das Ziel hier ist lediglich die Dokumentation eines Beispiels weg gelassener Beweise, um an vorderster Stelle deren Existenz und Gültigkeit zu belegen. Kurze Beschreibungen der Ergebnisse in zehn der Studien sind darin enthalten. Keine der beobachteten Korrelationen wird irgendwo im AR 5 erwähnt. Die ersten vier sind diejenigen, die ich oben angesprochen habe:

Bond et al. 2001, “Persistent Solar Influence on North Atlantic Climate During the Holocene,” Science.

Auszug aus Bond: „während der letzten 12 000 Jahre stand nahezu jede Zunahme des Treibeises im Zeitmaßstab von einem Jahrhundert im Nordatlantik im Zusammenhang mit einem ausgeprägt variablen und alles in allem verringerten solaren Output“.

Neff et al. 2001, “Strong coherence between solar variability and the monsoon in Oman between 9 and 6 kyr ago,” Nature.

Ergebnis von Neff: Korrelationskoeffizienten von 0,55 und 0,60.

Usoskin et. al. 2005, “Solar Activity Over the Last 1150 years: does it Correlate with Climate?” Proc. 13th Cool Stars Workshop.

Auszug aus Usoskin: „Die langzeitlichen Trends der Solardaten und der Temperaturen der Nordhemisphäre haben einen Korrelationskoeffizienten von etwa 0,7 bis 0,8 mit einem Vertrauensbereich zwischen 94% und 98%“.

Shaviv and Veizer, 2003, “Celestial driver of Phanerozoic climate?” GSA Today.

Auszug aus Shaviv: „Wir sehen, dass mindestens 66% des Trends der Paläotemperaturen den Variationen des CRF (Cosmic Ray Flux = kosmischer Strahlungsfluss) zugeordnet werden können, wahrscheinlich wegen des Durchgangs unseres Sonnensystems durch die Spiralarme der Galaxie“. (Nicht strikt wegen der Sonnenaktivität, aber implizit durch GCR oder CRF, die die Sonnenaktivität modulieren).

Viele der Anti-CO2-Alarmisten kennen dieses Zeug. Mike Lockwood und Claus Fröhlich zum Beispiel, die in ihrer Studie aus dem Jahr 2007 mit dem Titel: „Jüngste entgegengesetzte Trends der solaren Klimaantriebe und die globale mittlere Temperatur an der Erdoberfläche“ (Proc. R. Soc. A) mit den Worten beginnen, wie „eine Anzahl von Studien gezeigt hat, dass solare Variationen Auswirkungen auf das präindustrielle Klima während des Holozäns hatten“. Zur Unterstützung verweisen sie auf 17 Studien: den Artikel von Bond und Neff oben plus:

Davis & Shafer 1992; Jirikowic et al. 1993; Davis 1994; vanGeel et al. 1998; Yu&Ito 1999; Hu et al. 2003; Sarnthein et al. 2003; Christla et al. 2004; Prasad et al. 2004; Wei & Wang 2004; Maasch et al. 2005; Mayewski et al. 2005; Wang et al. 2005a; Bard & Frank 2006; und Polissar et al. 2006.

Die Korrelationen in den meisten dieser Studien gelten nicht direkt für die Temperatur. Sie gelten für Temperatur-Proxies, von denen einige eine komplexe Beziehung mit der Temperatur haben, wie Neff (2001), der eine Korrelation zwischen der Sonnenaktivität und der Regenmenge gefunden hat. Selbst dabei tendieren die Korrelationen dazu, stark zu sein, als ob der ganze Kreislauf grob synchron mit der Sonnenaktivität verläuft.

Einige Studien untersuchen wirklich die Korrelationen zwischen Proxies der Sonnenaktivität und direkten Proxies der Temperatur, wie das Verhältnis zwischen Sauerstoff 18 zu Sauerstoff 16 in geologischen Proben. Eine solche Studie (eingehend zitiert von Kirkby 2007) stammt von Mangini et al. 2005 mit dem Titel: „Reconstruction of temperature in the Central Alps during the past 2000 yr from a δ18O stalagmite record“ (etwa: Rekonstruktion der Temperatur in den Zentralalpen während der letzten 2000 Jahre aus dem δ18O-Gehalt eines Stalagmiten).

Auszug aus dieser Studie von Mangini: „…eine hohe Korrelation zwischen δ18O in SPA 12 und D14C (r = 0,61). Die Maxima von δ18O fallen mit solaren Minima zusammen (Dalton, Maunder, Sporer, Wolf ebenso wie Minima um die Jahre 700, 500 und 300). Diese Korrelation zeigt, dass die Variabilität von δ18O durch Veränderungen der Sonnenstrahlung angetrieben wird, was mit früheren Ergebnissen mit Stalagmiten des Holozäns in Oman und Mitteldeutschland übereinstimmt.”.

Und das ist nur älteres Zeug. Hier folgen vier unterstützende Studien jüngeren Datums.

Ogurtsov et al, 2010, “Variations in tree ring stable isotope records from northern Finland and their possible connection to solar activity,” JASTP.

Auszug von Ogurtsov: „Statistische Analysen von Aufzeichnungen der stabilen Kohlenstoff- und Sauerstoffisotope aus Baumringanalysen zeigen Variationen mit zeitlichen Perioden um 100, 11 und 3 Jahre. Eine Verbindung im Zeitmaßstab eines Jahrhunderts zwischen 13C/12C und der Sonnenaktivität ist höchst offensichtlich“.

Di Rita, 2011, “A possible solar pacemaker for Holocene fluctuations of a salt-marsh in southern Italy,” Quaternary International.

Auszug aus DiRita, 2011: „Die chronologische Korrespondenz zwischen Reduktionen der Vegetation in Salzmarschen und minimaler Konzentrationen von 10Be im GISP2-Eisbohrkern stützt die Hypothese, dass wichtige Fluktuationen der Ausdehnung von Salzmarschen in der küstennahen Tavoliere-Ebene (Süditalien) mit Variationen der Sonnenaktivität verknüpft sind“.

Raspopov et al, 2011, “Variations in climate parameters at time intervals from hundreds to tens of millions of years in the past and its relation to solar activity,” JASTP.

Auszug aus Raspopov 2011: „Unsere Analyse von 200 Jahren klimatischer Oszillationen in modernen Zeiten und auch die Daten anderer oben erwähnter Forscher legen nahe, dass diese Klimaoszillationen mit dem solaren Antrieb in Verbindung stehen. Die Ergebnisse unserer Studie hinsichtlich klimatischer Variationen vor Millionen von Jahren zeigen unserer Ansicht nach, dass der solare 200-Jahres-Zyklus einen starken Einfluss auf Klimaparameter auch in jenen Zeitintervallen hatte“.

Tan et al, 2011, “Climate patterns in north central China during the last 1800 yr and their possible driving force,” Clim. Past.

Auszug aus Tan: „Die Sonnenaktivität könnte die dominante Kraft sein, die die gleichphasigen Variationen der Temperatur und des Niederschlags im zentralen Nordchina angetrieben hat”.

Salzmarschen, Niederschlag, „Oszillationen”. Es ist alles so faire Wissenschaft. Wie ist es mit etwas einfach Ängstigendem?

Solheim et al. 2011, “The long sunspot cycle 23 predicts a significant temperature decrease in cycle 24,” submitted astro-ph.

Auszug aus Solheim: Wir finden, dass für die untersuchten norwegischen Stationen 30% bis 90% der Temperaturzunahme in dieser Periode mit der Sonne zusammenhängen kann. Für das Mittel von 60 europäischen Stationen finden wir ≈ 60% und global (HadCRUT3) ≈ 50%. Die gleichen Relationen sagen eine Temperaturabnahme von ≈ 0,9°C global und 1,1 bis 1,7°C für die norwegischen Stationen voraus, untersucht aus den Sonnenzyklen 23 und 24”.

Erster Fehler im Kapitel über Paläoklima: Weglassen aller solaren Variablen außer TSI

Das Kapitel über die Paläo-Beobachtungen ist der richtige Ort für den Beweis eines solar-magnetischen Klimaantriebs, weil das meiste dieses Beweises aus der Ablagerung kosmogener Isotopen in verschiedenen paläologischen Schichten stammt: Eisbohr-, geologische Bohrkerne und Baumringe. Ist die Sonnenaktivität hoch, kann weniger kosmische Hintergrundstrahlung (GCR) gegen den Sonnenwind bis zur Erde durchdringen, was zu Variationen kosmogener Isotope führt, die man in Schichten aus bekannten Zeiträumen findet und die als Proxy für die Sonnenaktivität dienen. Aber an der Stelle des Kapitels, an der es um diese kosmogenen Aufzeichnungen geht, schaut man lediglich darauf, wie man diese nutzen kann, um die solare Gesamtstrahlung TSI zu rekonstruieren. Es gibt nicht einmal einen Hinweis auf die Fülle von Studien, die einen hohen Grad der Korrelation zwischen der Sonnenaktivität und zahlreichen Paläoproxies bzgl. Klima und Temperatur aufweisen!

Dies passiert dann (in dem Anhang, in dem gefragt wird, ob die Sonne ein hauptsächlicher Klimatreiber ist). In diesem Anhang wird die langzeitliche Änderung der TSI erwähnt, die parallel mit der orbitalen Variation läuft (Milankovitch-Zyklen), ein Faktor, der sich seit 1750 nicht genug geändert hat, um für irgendeine signifikante Erwärmung seitdem in Frage zu kommen. Auch können TSI-Änderungen durch Änderungen der von der Sonne ausgehenden elektromagnetischen Strahlung nicht für die jüngste signifikante Erwärmung verantwortlich sein, weil angesichts der Sprünge in der Sonnenaktivität alle 11 Jahre der solare Output bekanntlich bemerkenswert stabil ist und lediglich um 1% bis 2% variiert.

Daher, lautet das Fazit in dem Anhang, kann die Sonne nicht für irgendeine signifikante Erwärmung seit 1750 in Frage kommen. Aber diese Schlussfolgerung kann man nur ziehen, wenn man jede Berücksichtigung jener solaren Variablen außer der TSI außen vor lässt, die die globale Temperatur beeinflussen könnten. Anders als die TSI variieren der Sonnenwind und der Druck deutlich während und zwischen den Zyklen. Das gilt für den AP-Index und den Fluss der F10,7cm–Radiowellen, während die vom Sonnenwind modulierte GCR (gemessen durch Neutronenzählungen in Climax, Oulu und anderen Orten) sich um eine ganze Größenordnung über den Sonnenzyklus verändern kann. Im Gegensatz dazu variiert die TSI so wenig, dass man sie die „Solarkonstante“ nennt. Falls es einen Mechanismus gibt, durch den solare Variationen die Temperatur der Erde steuern, geschieht dies höchst wahrscheinlich durch jene solaren Variablen, die tatsächlich stark mit der Sonnenaktivität schwanken. Und doch wird in der Diskussion in dem Anhang so getan, als würden diese solaren Variablen gar nicht existieren.

Das ist also der erste Fehler im Anhang des Paläo-Kapitels: es wird so getan, als ob die ganze Bandbreite möglicher solaren Effekte behandelt worden ist, während es mit Hingabe abgelehnt wird zu erwähnen, dass es eine ganze Reihe solarer Variablen gibt, die sich anders als die TSI erheblich während eines Sonnenzyklus‘ verändern und die unser Klima auf eine Weise beeinflussen, die wir noch nicht verstehen. Im Endeffekt leben wir innerhalb der „Atmosphäre“ der Sonne, der erweiterten Korona, erzeugt durch das Magnetfeld der Sonne und den Sonnenwind. AR 5 nimmt einfach an, dass diese solare Umgebung keine Auswirkung auf das globale Klima hat, und sie treffen diese Annahme durch das hingebungsvolle Weglassen der relevanten Variablen. Das Problem der ausgelassenen Variablen ist kein Zufall. Es ist Betrug durch absichtliches Auslassen.

Zweiter Fehler im Paläo-Kapitel: die höchst irrationale Hypothese, dass die Temperatur eher durch den Trend der Sonnenaktivität anstatt durch dessen Niveau getrieben wird

Vielleicht in einem Versuch, das Ignorieren aller Solarparameter außer TSI zu rechtfertigen, endet der Anhang zum Paläo-Kapitel mit einer Aussage, die als genereller Grund dafür präsentiert wird, die Möglichkeit auszuschließen, dass die solare Variation durch IRGENDEINEN Mechanismus einen signifikanten Beitrag zur Erwärmung im 20. Jahrhundert geleistet hat.

(Die hier folgende Feststellung ist die bekannte Behauptung, dass die Sonnenaktivität nicht für die Erwärmung zum Ende des 20. Jahrhunderts verantwortlich sein kann, weil sie in der zweiten Hälfte des 20. Jahrhunderts nicht zugenommen hat. Im vorigen Jahr habe ich mehrere Beiträge geschrieben, in denen ich die Anzahl der Anti-CO2-Alarmisten dokumentiert habe, die diese erstaunliche Bemerkung gemacht haben, dass es nämlich nicht die Stärke des Antriebs ist, die Erwärmung erzeugt, sondern die Änderungsrate des Antriebs. Siehe zum Beispiel "Solar warming and ocean equilibrium Part 3: Solanki and Schuessler respond.")

Die TSI ist zum Höhepunkt des Sonnenzyklus’ am höchsten, ebenso wie alle anderen Parameter auch. Folglich spielt es gar keine Rolle, welchen Parameter man sich anschaut, er kann keine Rolle bei der jüngsten Erwärmung gespielt haben, weil keiner dieser Variablen irgendeinen Aufwärtstrend während dieser Zeit gezeigt hat, richtig? Falsch! Das ist so, als wenn man sagt, dass man einen Topf mit Wasser nicht erwärmen kann, indem man die Flamme auf Maximum stellt und sie dort belässt, sondern das man die Flamme laaaangsam höher stellen muss, wenn man das Wasser erwärmen will. Es ist unglaublich, das etwas so komplett Unwissenschaftliches im AR 5 auftaucht und als höchst eingehend geprüfte Wissenschaft durchgeht.

Und die „Flamme” ist auf Maximum geblieben. Noch einmal, es gab ein 80-jähriges „Großes Maximum“ der Sonnenaktivität, das in den frühen zwanziger Jahren begonnen hatte (Usoskin 2007).

(Einschub von WUWT für Leif und andere, die bestreiten, dass es ein solches Großes Maximum im 20. Jahrhundert gegeben hat: Falls die Sonnenaktivität im 20. Jahrhundert lediglich „hoch anstatt außerordentlich hoch“ war (Muscheler 2007), macht das keinen Unterschied für das Argument hier, wie ich in einem Nachtrag am Ende erkläre)

Mit der Behauptung, dass die Sonnenaktivität immer weiter zunehmen müsste, um die Erwärmung Ende des 20. Jahrhunderts zu verursachen, nimmt AR 5 im Endeffekt an, dass sich die Ozeane Ende der siebziger Jahre bereits im Gleichgewicht befanden, egal welchen Antriebseffekt das hohe Niveau der Sonnenaktivität im 20. Jahrhundert hatte. Anderenfalls würde das weiterhin hohe Niveau der Sonnenaktivität weitere Erwärmung erzeugt haben.

Behauptungen über die rasche Angleichung der Ozeane wurden aufgestellt (Schwartz 2007), aber sie halten einer genauen Überprüfung nicht stand. Um sein Ergebnis zu erhalten, benutzte Schwartz ein Energiebilanzmodell, in dem die Ozeane durch eine einzige Wärmesenke repräsentiert worden sind. Das heißt, er nahm an, dass sich die Temperatur im gesamten Ozean sofort verändert hat! Verwendet man ein Modell mit 2 Wärmesenken, wo die Wärme Zeit braucht, sich von einer Ozeanschicht in eine andere zu verlagern (Kirk-Davidoff 2009), sagt uns eine rasche Temperaturanpassung der oberen Ozeanschicht fast nichts über die Dauer, sich bei einem langzeitlichen Antrieb anzupassen. (Für einen tiefer gehenden Vergleich der Energiebilanzmodelle mit einer und mit zwei Wärmesenken siehe Teil 2 meiner Reihe über Gleichgewicht im Ozean).

Die Aufzeichnung der Paläotemperatur wird gekennzeichnet durch Erwärmungs- und Abkühlungsphasen, jeweils im Zeitraum von Jahrhunderten, was nahe legt, dass der Ausgleich leicht Jahrhunderte lang erfolgen kann. Das macht es lächerlich zu vermuten, dass sich der Erwärmungseffekt eines Großen Maximums, das Anfang der zwanziger Jahre begonnen hat, bis 1970 oder 1980 oder bis zu irgendeinem speziellen Zeitpunkt ausgewirkt hat.

Nein, es gibt keinen Weg, das schlichtweg inkompetente Argument im Anhang zum Paläo-Kapitel aufrecht zu erhalten, dass ein solarer Treiber der Temperatur nur dann Erwärmung bewirken kann, wenn er zunimmt. Wenn der Druck des Sonnenwindes oder GCR irgendwie die globale Temperatur treibt, gibt es alle Gründe anzunehmen, dass sich der Planet so lange weiter erwärmt, solange sich die Sonnenaktivität auf dem Niveau eines Großen Maximums bewegt. Es gibt keine Entschuldigung für das IPCC, diese Variablen wegzulassen, die viel mehr als TSI für den beobachteten hohen Grad der Korrelation zwischen Sonnenaktivität und Klima verantwortlich sind. Um das Paläo-Kapitel noch halbwegs zu retten, müssen alle der inzwischen massiven Beweise, dass es irgendeinen Mechanismus gibt, durch den die Sonnenaktivität den größten Teil der Temperaturänderung treibt, in vollem Umfang dargelegt werden.

Technischer Hinweis: die falsche Zuordnung wird manuell im AR 5 bestimmt, aber das Konzept ist das gleiche wie ein rein statistischer Betrug durch Auslassung.

Wenn die TSI und die anderen solaren Variablen grob zusammen wirken, würde dann nicht das Auslassen dieser Variablen außer TSI die Aussagekraft mehr auf die TSI als auf das CO2 übergehen, zumal sie enger mit der TSI als mit CO2 korrelieren?

In einem rein statistischen Schema ja, aber das IPCC verwendet eine Kombination parametrisierter und geschätzter Elemente, und unter den parametrisierten Elementen sind die Strahlungsantriebe von CO2 und TSI, was bedeutet, dass deren Erwärmungswirkung ebenfalls parametrisiert ist, wobei das CO2 einen 40 mal größeren Erwärmungseffekt hat als die TSI in der Periode von 1750 bis 2010.

Diese Parametrisierung bedeutet, dass die Aussagekraft der ausgelassenen solaren Magnetfeldvariablen vierzig Teile CO2 für jeden Teil der TSI zugeordnet wird. Diese Struktur führt zu der falschen Zuordnung zu CO2. Man kann sich das als manuelle Anpassung an die falsche Zuordnung vorstellen.

Das Generalkonzept der ausgelassenen Variablen bleibt das Gleiche. Es gibt nur einen Beitrag zur Erwärmung (100%). Falls man dem Beitrag der solarmagnetischen Variablen gemäß den Beweisen aus historischen Aufzeichnungen mindestens 50% zuschreibt, können logischerweise weniger als 50% anderen Gründen zugeordnet werden.

Was erneut die wissenschaftliche Kompetenz des IPCC in Frage stellt. Falls das CO2 den vierzigfachen Erwärmungseffekt auf die 50%-Antriebe der globalen Temperatur hat (gesamtsolare Auswirkung), dann ergibt sich – was? Den 2000-prozentigen Treiber der globalen Temperatur?

Das Kapitel über Aerosole und Wolken kehrt die wissenschaftliche Methode in ihr Gegenteil, indem die Theorie benutzt wird, um die Beweise zu widerlegen

Während das Paläo-Kapitel einfach nur so tut, als gäbe es außer der TSI keine weitere solare Variable, enthält das Kapitel über Aerosole und Wolken diese Option nicht. Seine Aufgabe ist es, direkt die Möglichkeit anzusprechen, dass Variable wie der Sonnenwind und GCR das Klima beeinflussen könnten. Aber auch dieses Kapitel wartet mit einem Weg auf, jeden Hinweis auf die massiven Beweise zu vermeiden, dass es irgendeinen Mechanismus geben muss, durch den die Sonnenaktivität das Klima treibt. Kaum wird das Thema angesprochen, geht man stattdessen sogleich dazu über, die Haltbarkeit der speziellen Theorien über diesen Mechanismus zu untersuchen, durch den die Sonnenaktivität das Klima treiben könnte.

Dies geschieht genau am Anfang des (Abschnitts, der die mögliche Wechselwirkung zwischen kosmischer Strahlung, Aerosolen und Wolken diskutiert):

(Die hier folgende Passage besteht aus den ersten beiden Sätzen hinter der Überschrift dieses Unterkapitels. Der erste listet drei Studien, die nichtspezifische Korrelationen zwischen kosmogenen Isotopen und verschiedenen Klimavariablen finden. Im zweiten Satz erfolgt der unmittelbare Übergang zu einer Diskussion der Beweise für spezielle Mechanismen, durch die die Sonnenaktivität die globale Temperatur treiben könnte.)

Der erste Satz dieser Passage kommt Hinweisen auf die überwältigenden Beweise nicht näher als der gesamte AR 5, dass es IRGENDEINEN Mechanismus gibt, durch den die Sonnenaktivität die globale Temperatur treibt. Es werden einige Korrelationen zwischen Sonnenaktivität und Klima angesprochen, aber die Stärke dieser Korrelationen und wie gut sie belegt sind, wird komplett verschleiert, und das war es. Der zweite Satz enthält den Übergang zur Erwähnung bestimmter Theorien möglicher Mechanismen, durch die die Sonnenaktivität das Klima beeinflussen könnte. Nach einer kurzen Diskussion wird dem Beweis für diese speziellen Mechanismen Geltung verschafft (ziemlich tendenziös), dass sie „(nicht stark genug)“ seien, um eine „(signifikante Auswirkung auf das Klima)“ zu haben (Seite …, Zeile …). Mit dieser proklamierten Schwäche wiederum wird das Auslassen der angesprochenen Mechanismen aus den GCMs des IPCC begründet, die folglich auch nicht in die aus diesen Modellen abgeleiteten Projektionen eingehen.

Was machen die Autoren des AR 5 mit den überwältigenden Beweisen, dass es IRGENDEINEN Mechanismus gibt, der das solare Magnetfeld zum Haupttreiber der globalen Temperatur macht? Sie mögen die bekannten speziellen Theorien nicht, aber sie müssen doch anerkennen, dass IRGENDEIN solcher Mechanismus wirkt, oder? Aber die Leser wissen nichts von diesem Beweis. Er wurde einfach durch diesen einen ersten Satz übersprungen, in dem ein obligatorischer Hinweis auf einige Studien mit unidentifizierten Ergebnissen erwähnt worden ist, was es dem AR 5 gestattet, so weiterzumachen, als würde dieser Beweis nicht existieren. Sie erwähnen ihn kein zweites Mal. Niemals berücksichtigen sie ihn in irgendeiner Weise. Er ist aus dem AR 5 VERSCHWUNDEN. Die Autoren erklären ihre Unzufriedenheit mit den verfügbaren Theorien, wie die Sonnenaktivität das Klima treiben könnte, und nutzen dies als Entschuldigung dafür, die massiven Beweise, dass irgendein Mechanismus wirkt, vollständig zu ignorieren.

Dies ist eine exakte Umkehrung der wissenschaftlichen Methode, nach der die Beweise immer die Theorie widerlegen. Das IPCC wirft den Beweis für einen solarmagnetischen Treiber des Klimas beiseite, weil es mit den vorgeschlagenen Theorien hierzu nicht befriedigt ist. Dies ist die Definition von Anti-Wissenschaft: dass man die Theorie (oder die Ideologie oder irgendwas) über die Beweise stellt. Der Beweis muss die Trumpfkarte sein, oder es handelt sich nicht um Wissenschaft. Das IPCC engagiert sich im reinen Tatbestand von Anti-Wissenschaft, die die wissenschaftliche Methode buchstäblich auf den Kopf stellt.

Das ist so, als würde ein „vor-Newton-Wissenschaftler“ vorhersagen, dass sich ein in die Luft geworfener Stein auf dem Luftzug fortbewegen wird, weil wir die Kraft verstehen, die der Luftzug auf den Stein ausübt, aber es gibt keine gute Theorie des Mechanismus’, mit dem schwere Objekte auf den Boden gezogen werden. Wir sollten daher den überwältigenden Beweis, dass es irgendeinen solchen Mechanismus geben muss, der schwere Objekte zu Boden fallen lässt, ignorieren; und bis zu der Zeit, zu der wir diesen Mechanismus definieren können, machen wir so weiter, als ob ein solcher Mechanismus nicht existiere. Das ist es, was das IPCC tatsächlich mit dem Sonne-Klima-Beweis macht. Ihr seid alle keine Wissenschaftler. Ihr seid in Wirklichkeit lupenreine Antiwissenschaftler.

Noch mehr Anti-Wissenschaft: Im Kapitel über Aerosole und Wolken wird der Fehler wiederholt

Sie wissen, wovon ich rede: über den Gedanken, dass ein Klimatreiber nur dann eine fortgesetzte Erwärmung bewirken kann, wenn sein eigenes Niveau fortwährend steigt. Im Kapitel über Wolken und Aerosole heißt es erneut, dass das bloße Verbleiben eines Klimatreibers auf seinem Maximum unmöglich eine Erwärmung bewirken kann (Seite …, Zeile …):

„… … … … …“

Und das ist das Ende des Abschnitts, das Satzzeichen des IPCC dazu, warum die Sonnenaktivität und GCR als Erklärung der Erwärmung des späten 20. Jahrhunderts verworfen werden sollte.

Dies ist Antiwissenschaft auf ihre eigene Weise. Von Wissenschaftlern nimmt man an, dass sie smart sind. Es ist nicht vorgesehen, dass sie denken, dass man die Flamme unter dem Wassertopf langsam aufdrehen muss, um ihn zu erwärmen. Man kann jeden Schwachkopf der Welt zusammen bringen, und nicht einer von ihnen würde überhaupt auf den Gedanken kommen, dass man die Wärmezufuhr langsam erhöhen muss. Das wäre mehr als dumm. Es ist krankhaft dumm! Und viele Kapitel schreibende Teams proklamieren alle den gleichen Unsinn? Quatsch!

Okay, ich glaube, damit kann ich zur Zusammenfassung kommen. Ihr habt alle diese zehner-Milliarden an Forschungsgeldern eingesteckt und es benutzt, um einen Betrug zu begehen. Wie ich oben dokumentiert habe, habt ihr den größten und krassesten Betrug aller Zeiten durch Auslassen von Variablen begangen, aber bisher weiß das nur die skeptische Hälfte der Welt. Ihr habt noch eine letzte Chance, bevor die globale Abkühlung eine etablierte Tatsache ist, eine rasche Umkehr zu vollführen und noch einige Scherben eurer Reputation zu bewahren. Aber wenn der AR 5 erscheint und ihr immer noch darauf besteht, dass das CO2 den dominanten Einfluss auf die Erwärmung ausübt, zu einer Zeit, in der die globale Abkühlung beweist, dass die inzwischen deutlich ruhigere Sonne der Hauptklimatreiber ist, dann könnt ihr alle sofort einpacken. Ihr habt immer noch eure schmutzige Geldgier, aber der Hahn wird zugedreht werden, und eure Reputation wird für immer zerstört sein.

Kann man sich eine schlimmere Kombination vorstellen? Immer noch dem CO2 den Krieg erklären, obwohl die Sonne schon jetzt beweist, dass das CO2 ausschließlich Vorteile hat? Und das ist es, was den Beweisen, allen Beweisen zufolge geschehen wird, die ihr so eifrig außen vor gelassen habt. Ich bin gespannt auf eure Verlegenheit, aber viel lieber würde ich sehen, wenn ihr euch rettet, so dass die erforderlichen politischen Umkehrmaßnahmen schneller kommen können*. Die Anti-CO2-Politik, die eure betrügerische „Wissenschaft“ unterstützt hat, zerstört gerade die Weltwirtschaft. Ihr Idioten tötet unsere Zukunft! Bitte wacht auf und versucht, euren eigenen Ruf zu retten, bevor eure verrückte Antiwissenschaft uns alle ruiniert!

Ende der Begutachtung!

*[Im Original lautet dieser Nebensatz: „…so that the needed policy reversals can some that much sooner.” Der Satz macht so keinen Sinn. Vermutlich liegt irgendwo ein Schreibfehler des Autors vor, aber ich konnte ihn nicht finden. A. d. Übers.]

“Betrug durch Auslassung” ist die fundamentalere Kritik

Allen, die vom Beweis der Sonne als Klimatreiber beeinflusst sind, ist gemeinsam, ihren Protest gegen das Verwerfen der Beweise seitens des IPCC durch den Widerspruch zu dem kurzen Prozess zu machen, den das IPCC mit den Theorien über die mögliche Wirkungsweise dieser Effekte macht. Beispielhaft folgt hier die Kritik von Tim Ball zum AR 4 aus dem Jahr 2008:

…sie sind eifrig jeder Diskussion der klaren Beziehung zwischen der Aktivität von Sonnenflecken und der Temperatur aus dem Weg gegangen. Sie haben behauptet, dass es keine Erklärung für die Korrelation gibt, aber das stimmt nicht. Ein sehr wirksamer Mechanismus, bekannt unter der Bezeichnung Kosmische Theorie (Svensmark und Calder, „The Chilling Stars“) zieht sich seit 1991 zunehmend detailliert durch die Literatur. Das Datum ist wichtig, weil das IPCC behauptete, dass diese Theorie nur deswegen außen vor geblieben war, weil sie nicht rechtzeitig veröffentlicht worden war, um noch berücksichtigt werden zu können.

Mit anderen Worten, beim AR 4 war genau das gleiche der Fall wie beim AR 5. Sie benutzten das vermeintliche Fehlen einer zufriedenstellenden Theorie, wie ein solarmagnetischer Treiber funktionierte, als Entschuldigung, den überwältigenden Beweis nicht zu erwähnen, wie ein solcher Mechanismus als potenter Treiber des globalen Klimas agieren könnte (ein Kniff, den ich in meinen Kommentaren zum zweiten Entwurf des AR 4 dokumentiert habe, und TAR wandte den gleichen Trick ebenfalls an).

Balls Antwort – nämlich dass es doch eine ziemlich gute Theorie gibt – ist perfekt richtig, aber sie erwähnt nicht den tieferen Punkt: Dass es nämlich niemals irgendeine Entschuldigung dafür geben kann, „eifrig jede Diskussion der klaren Beziehung zwischen Sonnenflecken und Temperatur (zu vermeiden)“. Die Kritik an dem „Betrug durch Auslassen“ greift diese Entschuldigung direkt an und stellt sie bloß. Empirische beweise, die Rohdaten, sind die ultimativen Schiedsrichter. Falls man irgendeine Entschuldigung vorbringt, die Beweise beiseite zu schieben, handelt es sich nicht länger um Wissenschaft.

Wir kennen auch die Konsequenzen dieser betrügerischen Antiwissenschaft. Das Auslassen irgendeiner Variablen mit bekannter Aussagekraft (egal ob der Mechanismus verstanden ist oder nicht) erzeugt eine fehlerhafte Zuordnung gleicher Größenordnung. Es ist ein Fehler erster Güte.

Im Gegensatz dazu ist es ein geringeres Problem, mit der GCR-Wolken-Theorie kurzen Prozess zu machen. So lange wie das Vorhersageschema des IPCC die jüngste Erwärmung mit der Sonnenaktivität verbindet in Übereinstimmung mit Verteilungen in der Vergangenheit ist es keine große Sache, ob ein spezieller Sonne-Temperatur-Mechanismus modelliert wird oder nicht. Zumindest die bekannten aussagekräftigen Variablen werden nicht ausgelassen, und wir befinden uns auf der Ebene zweitrangiger Fehler anstatt Fehlern erster Güte.

Man beachte, dass es nicht notwendig ist, irgendeine Theorie zu aktivieren. Vorhersagen der künftigen Sonnenaktivität zum Beispiel basieren nicht auf physikalischen Modellen, sondern sind einzig und allein eine Projektion von Verteilungen in der Vergangenheit, und dies ist ausreichend, um Fehler erster Güte zu vermeiden. Man vermeide den Betrug durch Auslassung von Variablen, ziehe die bekannte Aussagekraft der solarmagnetischen Variablen in Betracht in irgendeiner vernünftigen Weise, und große Fehler werden vermieden.

Für die Betrüger sind große Fehler der zentrale Punkt. Nur mit großen Fehlern können unsere ökolinken „Wissenschaftler“ ihren Krieg gegen den industriellen Kapitalismus aufrecht erhalten. Nur große Fehler kann den Mainstream-Links-Politikern erlauben, die riesigen Energiesteuern zu erheben, die sie als eine Schatztruhe betrachten und die sie hunderte Milliarden Dollar an Wind- und Solarsubventionen an ihre Freunde und Unterstützer kanalisieren lässt.

Aber der Betrug ist leicht zu entlarven. Nahezu jeder, der einmal Anfängerkurse in Statistik besucht hat, kennt das Problem der ausgelassenen Variablen. Das gilt für jeden Absolventen noch ohne Abschluss, jeden Wirtschaftsabsolventen, jeden Wissenschaftsabsolventen und die meisten anderen Absolventen sozialer Wissenschaften. Derzeit glauben es die meisten dieser Leute, wenn man ihnen sagt, dass sie die Fakten nicht für sich selbst checken können, und das sie den hoch gelobten Wissenschaftlern einfach vertrauen müssen (oder nicht). Aber das stimmt nicht. Nicht nur, dass jeder doch für sich die Fakten checken kann, sondern es ist auch trivial einfach.

Alles was sie tun müssen ist ein Scannen der vielen empirischen Ergebnisse, dass die solarmagnetische Aktivität im statistischen Sinne Dinge wie die Hälfte der vergangenen Temperaturänderung „erklärt“. Dann müssen sie beobachten, dass alle solarmagnetischen Variablen in Wirklichkeit aus den Modellen des IPCC entfernt worden sind. Es gibt die RF-Tabelle für jeden Gebietsbericht, in dem die gesamten solaren Effekte mit lediglich einem kleinen Anteil des Erwärmungseffektes von CO2 parametrisiert werden. Dann bingo! Sie wissen, dass starke Erwärmungseffekte durch die Sonne falsch zugeordnet werden durch die zufällige Korrelation mit CO2. Sie haben die Fakten für sich selbst gecheckt, und an diesem Punkt werden die Stimmen der Autorität, die darauf bestehen, dass sie die Fakten nicht für sich selbst checken können, so werden wie beim Zauberer von Oz [The Wizard of Oz, ein populärer amerikanischer Roman, A. d. Übers.], der ihnen befahl, den Mann hinter dem Vorhang zu ignorieren. Nicht einmal die kleine vertrauensselige Dorothy ist darauf hereingefallen.

Fundamental und durchführbar. Das ist der Grund, warum ich versucht habe, die Kritik am “Betrug durch Auslassen” so viele Jahre lang voranzutreiben. Anthony Watts hat ein größeres Füllhorn als ich, also wird es vielleicht diesmal in die Welt gehen.

Wenn Leif recht hat, dass die Anzahl der Sonnenflecken seit 1945 um 20% reduziert werden sollte, beeinträchtigt dies die obige Analyse in keiner signifikanten Weise

Meine Begutachtung zitiert die Behauptung von Usoskin, dass sich die Sonnenaktivität auf dem Niveau eines „großen Maximums“ befand, und zwar von 1920 bis 2000. Leif Svalsgaard, der häufig Beiträge auf WUWT postet, verneint, dass die jüngste Spitze der Sonnenaktivität ein „großes Maximum“ war. Er führt an, dass das Zählschema der Sonnenflecken von Max Waldmeier nach 1945 Zahlen enthält, die um etwa 20% zu hoch liegen.

Sollte die Sonnenaktivität von 1945 bis 2000 nur „nur hoch anstatt außerordentlich hoch“ gewesen sein (Muscheler 2007, dessen kosmogene Proxies für die Sonnenaktivität bis durch das Jahr 2001 reichen), ändert sich die hier getroffene Aussage nicht signifikant. Wie meine Begutachtung wiederholt, muss man die Flamme unter dem Wassertopf nicht auf hohem Niveau halten, um ihn zu erwärmen. Ausgangs des Maunder-Minimums und der Kleinen Eiszeit – falls den Paläodaten zufolge der hauptsächliche Treiber der globalen Temperatur die meiste Zeit während einiger Jahrhunderte auf hohem Niveau verbleibt, sollte es zu einer fortgesetzten Erwärmung kommen. Tatsächlich aber zu argumentieren, dass der solare Antrieb weiter steigen muss, um eine fortgesetzte Erwärmung zu bekommen (das IPCC behauptet genau das), muss man argumentieren, dass die Ozeane bereits im Gleichgewicht mit dem Antrieb sind, aber es gibt dafür keinen Beweis, während die Geschichte der planetaren Temperatur nahe legt, dass das Gleichgewicht zu erreichen mehrere Jahrhunderte dauern kann.

Es stimmt, dass einige der stärksten Korrelationen zwischen der Sonnenaktivität und der Temperatur kurze Verzögerungen aufweisen, größenordnungsmäßig etwa zehn Jahre, aber rasche Reaktionen auf kurzfristige Änderungen der magnetischen Aktivität der Sonne stören nicht längerfristige Reaktionen auf längerfristige Antriebe. Im Gegenteil, kürzerfristige Reaktionen implizieren längerfristige Reaktionen, genau wie die rapide Reaktion der Tagestemperatur auf den Sonnenaufgang impliziert, dass die längerfristige Zunahme der Einstrahlung, wenn es in Richtung Sommer geht, zu jahreszeitlichen Temperaturänderungen führt (was natürlich der Fall ist).

Für gegenwärtige Zwecke spielt es keine Rolle, ob die Sonnenaktivität nach dem Maunder-Minimum rasch auf ein hohes Niveau gesprungen ist und bis zum Ende des 20. Jahrhunderts zumeist auf diesem Niveau verblieben ist (mit ausgeprägten Ausnahmen zum Dalton Minimum und dem Minimum des 19. Jahrhunderts), oder ob die Sonnenaktivität während der zweiten Hälfte des 20. Jahrhunderts wirklich auf das höchste Niveau seit 9000 vor Christus gestiegen ist (Usoskin). So weit wir wissen, können beide Szenarien für die moderate Erwärmung, um die es hier geht, in Frage kommen.

Das wären 0,7°C von 1600 bis zum Mittel von 1961 bis 1990 nach Moberg 2005, oder 0,5°C zwischen 1750 und 1961 bis 1990. Dieses Temperaturmittel von 1961 bis 1990 ist der HadCRUT3-Nullpunkt. HadCRUT3 erreichte eine Spitze von 0,548°C im Jahre 1998 und ist seitdem um einige Zehntelgrad zurück gegangen, so dass es insgesamt eine Erwärmung von etwa 1°C während der vom IPCC untersuchten Periode von 260 Jahren gegeben hat (inzwischen nur noch 0,8°C). Das ist nichts Ungewöhnliches im Auf und Ab der globalen Temperatur.

Es gibt keinen Grund anzunehmen, dass die Sonne allein für diesen nicht ungewöhnlichen Temperaturanstieg verantwortlich ist, wenn es 50 Jahre lang die höchste Sonnenaktivität seit 9000 vor Christus gegeben hat. Natürlich glaubt das IPCC, dass irgendein konstantes Niveau der Sonnenaktivität während der zweiten Hälfte des 20. Jahrhunderts eine solare Erklärung für die geringe Erwärmung ausschließt, weil die Sonnenaktivität nicht noch weiter zugenommen hat auf ein noch extremeres Niveau, aber das IPCC besteht ja auch nur aus einem Haufen dummer Antiwissenschaftler.

Meine eingereichte Begutachtung enthält eine Ungenauigkeit, die ich in dieser Begutachtung korrigiert habe

In meiner eingereichten Begutachtung habe ich behauptet, dass der einzige Hinweis auf die umfangreichen Beweise für die Sonne als Klimatreiber nur in einem einzigen Satz steht, der eine einzige Erwähnung einer einzelnen Forschungsstudie enthält. In der korrigierten Fassung oben wird daraus: …der eine einzige Erwähnung auf drei Forschungsstudien enthält.

Zwei dieser Studien betrachten lediglich die Korrelation zwischen Sonne und Klima in der zweiten Hälfte des 20. Jahrhunderts und sind daher inhärent unfähig, belastbare Schlussfolgerungen zu ziehen. Ich glaube, ich habe gedacht, dass der einzige „wirkliche“ Hinweis einer Übersichtsstudie gegolten hat, die sich tatsächlich mit den Paläodaten befasst. Aber solche Details sind irrelevant bis zu dem Punkt, den ich herausarbeiten wollte – dass ein Leser des AR 5 keinen Hinweis bekommt, was in irgendeiner dieser Studien steht – und keine Ahnung hat, dass zahlreiche Studien auf die Sonne als den Haupttreiber der globalen Temperatur hinweisen. Die eingereichte Begutachtung zitiert den gesamten Satz, so dass sie nichts verschleiert, aber nicht vollständig akkurat ist.

Das also ist der Preis der Verzögerung. Es war unmittelbar vor dem Ultimatum der Einreichung, und ich musste zu einem wichtigen Treffen eilen, so dass ich nicht so gründlich alles überprüfen konnte, wie ich es gerne getan hätte. Dennoch ist Folgendes die einzige Stelle, an der ich durcheinander gekommen war: es ist keine Referenz zu einer einzelnen Studie, sondern ein Satz, in dem drei Studien erwähnt werden. Da der Entwurf den Lesern von WUWT nicht zugänglich ist, möchte ich irgendwelche Fehlcharakterisierungen nicht weiter ausführen, also merke ich diese Korrektur hier als Fußnote an.

Dieser Beitrag beseitigt auch einige Tippfehler, fügt Links zu einigen der genannten Studien ein und fügt einige Formatierungen hinzu, die in der Excel-Form nicht verfügbar waren. Außerdem wird die Präsentationen an manchen Stellen verbessert.

Alec Rawls Original hier

Weiterführende Links

z.B. hier

Übersetzt von Chris Frey